Human Perception of Visual Information (1)

There is one thing the photograph must contain, the humanity of the moment.

—Robert Frank照片必须包含一件事,那就是这一刻的人性。

罗伯特。弗兰克

perface

利用机器学习和大规模数据收集的最新成果,客观视觉属性(如语义内容和几何关系)的计算模型取得了重大突破。利用这些突破来改进主观视觉属性(如趣味性、情感价值和情感、审美价值、可记忆性、新颖性、复杂性、视觉构成和风格属性以及创造力)的计算建模也有一些有限但重要的工作。应用机器学习对这些主观属性进行建模的研究人员通常受到这些模型的广泛潜在应用的激励,包括内容检索和搜索、讲故事、定向广告、教育和学习以及内容过滤。这种基于机器学习的模型的性能留下了很大的改进空间,并表明我们需要在理解这种高度复杂现象的方法上取得根本性的突破。?

在机器学习社区的这些努力的同时,近年来我们对视觉刺激的这些相同主观属性的心理基础的理解取得了重要进展。视觉科学早期的重点是处理简单的视觉特征,如方向、偏心率和边缘。然而,利用功能性磁共振成像等新的神经成像技术,20世纪90年代和21世纪初的突破揭示了大脑对高级视觉信息的专门处理,如图像类别(如面孔、场景、工具、物体)和更复杂的图像属性(如现实世界物体大小、情感、美学)。

过去十年的最新工作利用机器学习技术,使研究人员能够探测大脑中视觉表征的具体内容。与此同时,互联网的广泛出现使得大规模的群众实验成为可能,这使得心理学家能够超越有限的、可控的刺激集的小样本,以大规模的方式研究图像。随着这些进步的结合,心理学现在能够从新的角度来看待

一些古老的问题,比如我们觉得什么有趣,什么美丽,什么驱动我们的情绪,我们如何感知空间,或者我们记得什么。

机器学习领域,以及更广泛的人工智能领域,有着从人类和非人类智能的心理学和神经科学研究中寻求灵感的悠久传统。例如,计算机视觉中的深度学习神经网络最初受到人类视觉系统架构的启发,其多层神经元被认为在每个阶段应用过滤器。心理学和神经科学也在很大程度上依赖于人工智能的发展,无论是分析从大脑和行为中收集的大数据,还是理解其潜在机制。例如,现在,像VGG-16这样的对象分类深度神经网络经常被用作人类视觉系统的替代品,以预测大脑中的行为甚至活动。鉴于机器学习和心理学在更成功地模拟主观视觉属性方面取得的进展,我们认为探索这些进步如何相互丰富并导致进一步发展的时机已经成熟。

为此,本书展示了心理学和机器学习对图像和视频的高级感知的互补观点。这是一本跨学科的书,汇集了心理学和机器学习的专家,试图将这两个乍一看不同的领域带入对话,同时提供了这两个领域的艺术现状的概述。这本书包含10章,分为5对,每对描述最先进的心理学和计算方法来描述和建模一个特定的主观感知现象。

在章节1中,劳尔和V?回顾了最近的研究,这些研究使用了不同的方法,如心理物理学、眼动追踪和神经生理学,以帮助更好地捕捉人类在现实世界场景和物体感知中的效率。本章特别关注人类在什么时候最能利用哪些上下文信息。此外,他们探讨了这些发现如何在推进计算机视觉方面有用,以及计算机视觉如何能够相互进一步理解人类视觉感知。

在章节2中,Constantin等人从计算的角度考虑了兴趣度预测的相关现象,并概述了传统的融合机制,如统计融合、加权方法、增强、随机森林和随机树。他们还研究了一种新的、基于深度学习的系统融合方法,用于增强兴趣预测系统的性能。

在章节3中,布拉德利等人回顾了最近与描绘情感参与事件的摄影图像相关的研究,目的是评估特定图片在多大程度上可靠地吸引了个体的情感反应。特别是,他们提供了初步的分析,鼓励未来的研究,旨在建立规范的生物图像数据库,除了评估报告,提供身体和大脑中情绪反应的估计,用于情绪和情绪功能障碍的研究。

在计算方面,在章节4中、Zhao等人从计算的角度介绍了图像情感分析,重点总结了最近的进展。他们回顾了情感分析的关键计算问题,并详细介绍了情感特征提取、监督分类器学习和领域适应等方面。他们的讨论以评估和确定开放研究方向的相关数据集的介绍结束。

在章节5中,张伯伦阐述了经验美学在认知科学中的历史和目前的研究现状。本章概述了最近关于审美偏好的观察者间协议的工作,然后提出了实证工作,认为客观(刺激特征)和主观(背景特征)因素在塑造审美偏好方面的重要性。Valenzise等人探索了机器学习方法来模拟计算图像美学,,张伯伦阐述了经验美学在认知科学中的历史和目前的研究现状。本章概述了最近关于审美偏好的观察者间协议的工作,然后提出了实证工作,认为客观(刺激特征)和主观(背景特征)因素在塑造审美偏好方面的重要性。Valenzise等人探索了机器学习方法来模拟计算图像美学.

在章节6中。他们概述了美学随着时间的推移所接受的几种解释,并介绍了美学的分类。他们讨论了美学预测的计算进展,从早期的方法到深度神经网络,并概述了最流行的图像数据集。公开的挑战被识别和讨论,包括处理美学分数的内在主观性和提供可解释的美学预测。

在章节7中。他们概述了美学随着时间的推移所接受的几种解释,并介绍了美学的分类。他们讨论了美学预测的计算进展,从早期的方法到深度神经网络,并概述了最流行的图像数据集。公开的挑战被识别和讨论,包括处理美学分数的内在主观性和提供可解释的美学预测。

在章节8中,Bylinskii等人用计算镜头研究了可记忆性的概念,详细介绍了最先进的算法,这些算法可以准确预测相对于人类行为数据的图像可记忆性,使用从原始像素到语义标签的不同尺度的图像特征。除了预测之外,他们还展示了最近的人工智能方法如何用于创建和修改视觉可记忆性,并预览了可记忆性可以驱动的计算应用,从过滤视觉流到增强增强现实界面。

在章节9中,Akcelik等人回顾了最近的研究,旨在量化建筑环境的视觉特征和设计质量,以便将城市空间中更抽象的方面与可量化的设计特征联系起来。揭示这些关系可能为建立设计特征与心理感受(如可步行性、偏好、视觉复杂性和无序性)之间的因果关系提供机会。

最后,在章节10中,麦地那,Ríos等人回顾了使用机器学习方法研究人们如何根据主观维度(如美丽和危险)感知城市环境的研究。然后,他们特别关注全球南方城市,提出了一项关于人和机器对城市场景感知的研究。他们利用这项研究的发现来讨论使用众包主观标签进行机器学习和城市环境推理的系统设计的影响。

我们编辑这本书是为了吸引本科生和研究生,学术和工业研究人员,以及对主观视觉体验的认知基础广泛感兴趣的实践者,以及建模和预测它们的计算方法。这本书的作者提供了八序概述在各自的研究领域的艺术现状;因此,对于那些可能不熟悉主流计算,特别是机器学习,实践或认知科学研究实践的研究人员来说,章节很大程度上是可以访问的。因此,我们相信来自两个世界的研究人员将从这些章节中学到很多东西。

我们感谢所有作者的贡献,并希望这本书的读者能像我们一样享受他们辛勤工作的成果。

最后,我们要感谢我们的编辑斯普林格,是他给了我们这个项目的机会。

Chap1 The Ingredients of Scenes that Affect Object Search and Perception

1 Introduction

在一个视觉丰富的环境中,是什么决定了我们参加的地点和我们的感知?由于我们通常无法同时处理视野中的所有信息,因此需要选择某些信息进行进一步处理。注意控制模型通常区分两个方面:自下而上的注意(有时被称为“外源性注意”)关注的是我们可能注意到的刺激特征,而自上而下(或“内源性”)的注意关注的是目标驱动的影响和观察者的知识(例如,Henderson等人,2009;Itti & Koch, 2001)。在本章中,我们重点研究了场景情境下自上而下的注意力引导和对象感知;特别是,自上而下的指导根植于通用场景知识或场景语法,我们将在后面详细说明,并从特定的场景遭遇中抽象出来,但存储在长期记忆中。

假设你在租来的房子里找餐具。你可能会在厨房或客厅里找,但肯定不会在浴室里找。一旦进入厨房,你可能会很容易地把注意力转移到橱柜上——检查冰箱或烤箱是不值得的。尽管有一个明确的目标,但某些东西可能会吸引你的注意力,比如厨房柜台上的一碗水果或五颜六色的花。如果你找到了叉子,你可能会在附近找到刀。在看厨房的时候,你可能不会很难识别出各种各样的厨房用具,即使它们看起来很小,被遮挡或难以识别。在这个例子中,一个人可以从上下文信息中获益,从之前对各种厨房的经验中获益。

也就是说,在现实世界中,物体很少被孤立地看到,而通常是在相似的、重复的环境中,这使我们能够在感知和目标导向行为方面做出近乎最佳的预测(Bar, 2004;Oliva & Torralba, 2007;V? et al, 2019)。图1提供了一个说明:虽然很难识别左边面板中孤立的物体,但场景上下文(右边面板)的可用性可能有助于确定物体的身份(这里是一个电水壶)。

在本章中,我们将首先从刺激驱动的角度回顾现实世界中注意力是如何分配的。然后,我们将概述视觉搜索过程中注意力引导的重要方面,然后是上下文对目标识别的影响-搜索的一个组成部分。特别是,我们关注视觉系统利用什么类型的上下文信息或“成分”进行对象搜索和识别,这是一个直到最近才被广泛探索的问题。为此,我们参考了不同的方法(如心理物理学、眼动追踪、神经生理学和计算建模),用于不同程度的现实主义(从屏幕上的实验,通过虚拟现实到现实世界的研究)。最后,我们将把这些发现结合起来,讨论各种上下文成分对目标搜索和识别的相对贡献,以及人类和计算机视觉研究的未来方向和相互利益。

2 Attentional Allocation in Real-World Scenes

2.1 The Role of Low-Level Features

在我们的介绍性示例(见图1)中,水果碗将基于语义场景上下文,但最初可能会在与周围环境(例如白色厨柜)不同的低级特征(例如颜色)方面对我们脱颖而出

在过去的二十年里,已经提出了几个自下而上的、刺激驱动的注意力计算模型(有关评论,见Borji, 2019;[j] & Itti, 2013;Krasovskaya & machines, 2019)。Itti和Koch(2000,2001)提出的显著性模型是一个影响深远的早期注意力模型,它启发了许多其他模型。视觉显著性被定义为“独特的主观感知品质,它使世界上的一些物品从它们的邻居中脱颖而出,并立即抓住我们的注意力”(Itti, 2007)。该模型基于低水平的特征对比(在强度、方向和颜色上)计算观察者可能参与的区域的显著性地图,这是由人类视觉系统的接受域驱动的。

请注意,作为显性视觉注意力的代表,研究人员经常测量注视,并将经验分布与模型预测进行比较。然而,视觉注意原则上并不局限于注视点,可以指向中央凹以外的区域(通常称为隐蔽注意)。低水平显著性模型已被证明在自由观看条件下(即,在没有特定任务的情况下)预测显性注意高于偶然,在第一次注视时发现了最高的可预测性(例如,Parkhurst等人,2002)。有趣的是,这些模型仅仅基于低水平的特征对比,也就是说,在不知道图像内容或含义的情况下(例如,不知道厨房里的突出点是一碗水果或鲜花),就能捕捉到我们的视线指向哪里。?

2.2 The Role of Mid-Level Features and Objects’

虽然低层次的图像特征在注意力分配中确实起着决定性的作用,但人们一直质疑,这些低层次的特征或未被纳入低层次显著性模型的更高层次的特征或物体是否能有效地吸引注意力(Einh?user等人,2008;Nuthmann & Henderson, 2010;Pajak & Nuthmann, 2013;Stoll et al, 2015)。

物体经常出现在突出的位置(Spain & Perona, 2011)——它们通常首先使位置突出——因此可能是注意力部署的驱动力(sch等人,2019)。Stoll等人(2015)发现,最先进的低水平显著性模型和对象模型同样能很好地预测注视;然而,当在与对象内容相关的区域降低显著性时,对象模型的表现优于显著性模型。

Nuthmann和Einh?user(2015)引入了一种新的方法来研究哪些图像特征会影响凝视:使用混合效应模型,他们表明中级特征(例如边缘密度)和高级特征(例如图像杂波和分割)与低级特征相比,在凝视预测中有明显的贡献。因此,许多最新的模型除了包含低级特征外,还包含中级到高级特征,以更好地预测场景感知中的注视分布。

为此,深度神经网络(dnn)越来越受欢迎,并在注视预测中取得了基准性能(Borji, 2019)。目前最优秀网络之一,DeepGazeII利用了经过对象识别训练的深度神经网络的高级特征(k?mmerer等,2016)。

2.3 The Role of Meaning

在观看真实场景时,场景意义(或语义信息性)在注意力部署中的作用已经研究了几十年,最近由Henderson及其同事进行了系统评估(Henderson等人,2018,2019;Peacock et al ., 2019a, 2019b)。

对于来自场景图像的大量局部场景补丁,他们根据补丁对观察者的信息量或可识别性来收集有意义的评级。然后,作者生成了表示语义特征在场景中的空间分布的意义地图,类似于显著性地图(尽管不是基于图像可计算的特征)。意义被证明可以成功地预测凝视,低水平的显著性也是如此,但在控制其与意义的相关性时,显著性并没有独特的贡献(Henderson & Hayes, 2017)。这一发现在预测注视持续时间而不是注视分布时得到了重复(Henderson & Hayes, 2018),并且在不同的任务中也适用(Henderson等人,2018;Rehrig等人,2020),即使低水平的图像显著性与任务高度相关,而意义与任务无关(Peacock等人,2019a)。

然而,有人认为意义地图方法的成功可能是由于经典显著性模型中未捕获的高级图像特征,并且可能强烈影响观察者对意义的评级:包含高级对象特征的DeepGazeII能够在预测注视方面优于意义地图(Pedziwiatr等人,2019)。

此外,从场景中的物体中获得意义已经被证明可以引导注意力,如果这些物体是语义相关的,那么凝视倾向于从一个物体转移到另一个物体(Hwang等人,2011;Wu等,2014a;在此基础上,提出了一种新的方法,并对其进行了分析。另见De Groot et al, 2016)。

违反场景整体意义的对象(例如,浴室里的搅拌器)会强烈吸引注意力;它们通常比一致的物体被观察的时间更长,更频繁(例如,Cornelissen & V ?, 2017;De Graef et al, 1990;弗里德曼,1979;Henderson等人,1999;L - o - u - s & Mackworth, 1978;V? & Henderson, 2009b)。

虽然已经确定,一旦发现这些不一致之处,即使它们与当前目标无关(Cornelissen & V?, 2017, p.1),注意力也会“卡”在这些不一致之处上,这是一个争论的问题,即它们是否在被关注之前吸引了注意力。一些研究发现,语义不一致会影响最初的眼球运动(例如,关键物体比一致物体更早被注视)(Becker et al, 2007;Bonitz & Gordon, 2008;Coco等人,2019;洛夫特斯和麦克沃斯,1978;Nuthmann et al, 2019;Underwood et al ., 2007, 2008;Underwood & Foulsham, 2006),但其他研究没有发现不一致性引起注意的迹象(Cornelissen & V?, 2017;De Graef et al, 1990;Furtak et al, 2020;Henderson等人,1999;V ? & Henderson, 2009b, 2011)。

这些混合结果可能与场景刺激的特征(例如,线条图、照片或3d渲染的场景,这些场景的成分会影响对象搜索和感知5不同程度的混乱)和/或关键对象或多或少受控制的特征(例如,大小、偏心、显著性)有关。

随着LabelMe等完全标记图像数据库的兴起(Russell et al ., 2008),评估对象及其场景上下文之间的语义相关性以及对象间的相关性变得更加容易。例如,通过将对象视为节点并为其连接分配不同权重的图论,为确定场景中语义相关对象的集群(我们已经开始称之为“短语”)或其中的突出对象(锚定附近其他对象的位置和身份的预测)提供了新的途径(更多细节,参见第4.3节;Boettcher et al, 2018;有关评论,请参阅V?, 2021;V? et al, 2019)。不符合环境的物体往往会被认为是令人惊讶或有趣的,并会影响我们在场景中的注意力。

2.4 The Role of Interestingness and Surprise

虽然图像特征的作用已经得到了广泛的研究(有关评论,请参阅Borji, 2019;Borji & Itti, 2013;Krasovskaya & machines, 2019),对于趣味性或惊喜等其他因素如何调节注意力部署,我们所知相对较少。Elazary和Itti(2008)提出,有趣的对象实际上在视觉上是显著的:为LabelMe数据库(一个带有对象注释的大型场景集合)做出贡献的观察者(Russell et al, 2008)倾向于标记那些显著的对象,即使他们可以自由选择要标记的对象。在另一项研究中,当明确询问哪些场景位置有趣时,观察者对位置的选择在很大程度上是相似的,并且与其他观察者的注视分布相关(Masciocchi et al, 2009)。

行为判断和眼球运动也与显著性模型的预测相关,但如果显著性是兴趣的唯一驱动因素,那么就没有人们所期望的那么高。作者得出的结论是,对于我们认为有趣的东西以及我们在图像中关注的位置,自下而上和自上而下都有影响(另见Borji等人,2013;Onat et al ., 2014)。其他研究表明,除了低水平显著性的影响外,注意力分配还受到物体的情感动机影响或其对场景的重要性的调节(' t Hart et al, 2013;Schomaker等人,2017),并且注意力被贝叶斯框架中令人惊讶的图像位置所吸引(例如,Itti & Baldi, 2005)。此外,某些类型的对象具有特殊的地位:例如文本和面孔,已被证明在场景中极大地吸引了注意力(见Wu et al ., 2014)。

综上所述,受早期低水平显著性模型的启发,最近的研究强调了高水平特征的重要性,并表明场景中的注意力主要是基于对象的——一些对象比其他对象更能吸引和/或吸引注意力。虽然dnn目前在各种任务中取得了基准性能,并且在注视预测中越来越受欢迎,但还需要更多的研究来了解它们如何进一步加深我们对人类注意力机制的理解。

此外,更多地了解在观看场景时,各种特征对注意力分配产生影响,将是至关重要的。sch等人(2019)解开了低水平和高水平特征对注视分布随时间变化的贡献,表明低水平特征的影响主要局限于第一次注视,而DeepGazeII中纳入的高水平特征在刺激开始200 ms后更好地预测注视。尽管dnn很受欢迎,但数据驱动方法的一个缺点是它们不能捕捉到人类视觉注意的某些方面,例如人工刺激中的单例(或“奇数”)检测(即使在调整训练数据时,例如Kotseruba等人,2020)。

3 Guidance of Attention during Real-World Search

虽然图像特征的处理当然可以在我们参加的地方发挥作用,特别是在自由观看场景时,我们很少会无意识地环顾四周。

相反,我们倾向于被各种议程和任务需求所驱动,其中之一就是需要找到某物或某人。在搜索过程中,自下而上的图像特征和更基于认知的自上而下的影响的相互作用是复杂的。

正如Henderson(2007)所说:“从某种意义上说,我们可以把注视看作是被那个地点的视觉属性‘拉’到一个特定的场景地点,或者被与我们所知道的和我们试图完成的事情相关的认知因素‘推’到一个特定的地点”(第219页)。然而,应该注意的是,严格区分自下而上和自上而下的影响并不总是直截了当的(Awh等人,2012;另见Teufel & Fletcher, 2020);我们当然不是说这里提出的各方面不是其中之一就是另一个。

传统上,视觉搜索是通过简单的人工显示随机安排的目标和干扰物来研究的(例如,“在几个字母L的实例中找到字母T”)。主要的测量方法是——现在仍然是——反应时间(RT)作为设定尺寸的函数(即显示中的项目数量)。随着集合大小的增加,在这样的任务中,RT的时间总是更长,步骤相同,这表明注意力是连续地部署到一个又一个项目上的(见Wolfe, 2020;Wolfe & Horowitz, 2017)。

然而,在某些情况下,没有必要检查显示中的所有项目:在“经典引导搜索”理论中,一组有限的目标特征(例如,颜色,运动,方向,大小)可以以自上而下的方式引导注意力,缩小可能项目的数量(关于评论,见Wolfe, 2020;Wolfe et al ., 2011b;W . f . & Horowitz, 2017)。例如,当在一些红色和黑色的“L”中寻找红色的“T”时,可以忽略所有黑色的项目。为此,发生了“特征绑定”:将目标的形状和颜色绑定在一起,以排除干扰并识别目标。虽然该领域已经从这些主要使用无意义刺激的实验中学到了很多东西,但现实场景中的搜索似乎受到其他指导因素的强烈影响。

场景不是特征的随机集合,而是结构化和有意义的,这使我们能够以显着的效率执行搜索。例如,当在卧室里寻找泰迪熊时,注意力往往集中在影响物体搜索和感知的场景成分周围,即使目标不存在,也不能通过其特征来引导注意力(见V?等人,2019)。在场景中搜索对象似乎比在随机数组中搜索孤立对象要有效得多,尽管要充分定义场景的集合大小可能具有挑战性(参见Wolfe et al, 2011)。认知关联框架提出,场景中的搜索主要由先验知识和当前目标等认知因素引导(Henderson et al, 2009;有关综述,请参见Wolfe et al, 2011b)。

是什么使得现实世界中的搜索如此高效,尽管视觉输入中包含了丰富而复杂的信息?虽然没有人会怀疑场景上下文有助于对象搜索,但对于现实世界场景的哪些“成分”有效地引导注意力,它们的相对贡献是什么,以及它们在搜索过程中的贡献是什么,我们知之甚少。在接下来的文章中,我们试图更多地阐明这些成分。

3.1 The Role of Scene Gist

其中一项研究解决的问题是,最初对场景的短暂一瞥是否会影响注意力分配。在几分之一秒内,观察者可以获得场景的“要点”,即不需要选择单个对象的空间属性和意义的粗略表示(Greene & Oliva, 2009a, 2009b;Rousselet et al, 2005)。虽然没有关于场景主旨的通用描述,但许多定义(包括我们的定义)都认为主旨允许在基本层面上对场景进行分类。例如,人们可以将一个场景归类为厨房,并告诉它包括类似厨房柜台的东西,但还没有理解在任何表面上都有一个烤面包机和搅拌器。也就是说,一个人可以“看到森林而不代表树木”(Greene & Oliva, 2009a)。

毫秒范围内的短暂一瞥太短,无法进行扫视,因此无法聚焦场景的选定部分,以便以精细的细节感知它们。事实上,场景主旨识别并不依赖于中央凹的高视觉敏锐度;即使在场景模糊或只有外围信息可用的情况下也可以实现(例如,Loschky等人,2019)。场景要点的一个基本方面是空间布局信息。正如空间包络模型所证明的,并得到行为研究的支持,场景可以根据其全局属性(如全局形状)进行分类,而无需识别场景中的任何物体(Oliva & Torralba, 2001,2006)。

这种处理场景的方式被认为在很大程度上是前馈的,就搜索指导而言,假定发生在“非选择性路径”上,该路径与“选择性路径”平行,后者绑定特征并识别单个对象(Wolfe et al, 2011b)。请注意,对象也可以是场景分类的重要信息来源(MacEvoy & Epstein, 2011),特别是对于在其全局属性方面并不总是容易区分的室内场景。

为了研究对场景的短暂一瞥是如何引导搜索行为的,研究人员使用了快速预览移动窗口范式(Castelhano & Henderson, 2007;V? & Henderson, 2010, 2011;V? & Schneider, 2010;V ? & W ol f, 2015):它首先是一个场景的简短预览,然后是一个目标单词和一个搜索阶段,在这个阶段,观察者在原始场景中寻找目标物体,但通过一个凝视窗口,该窗口只显示当前注视点场景的一小部分区域。

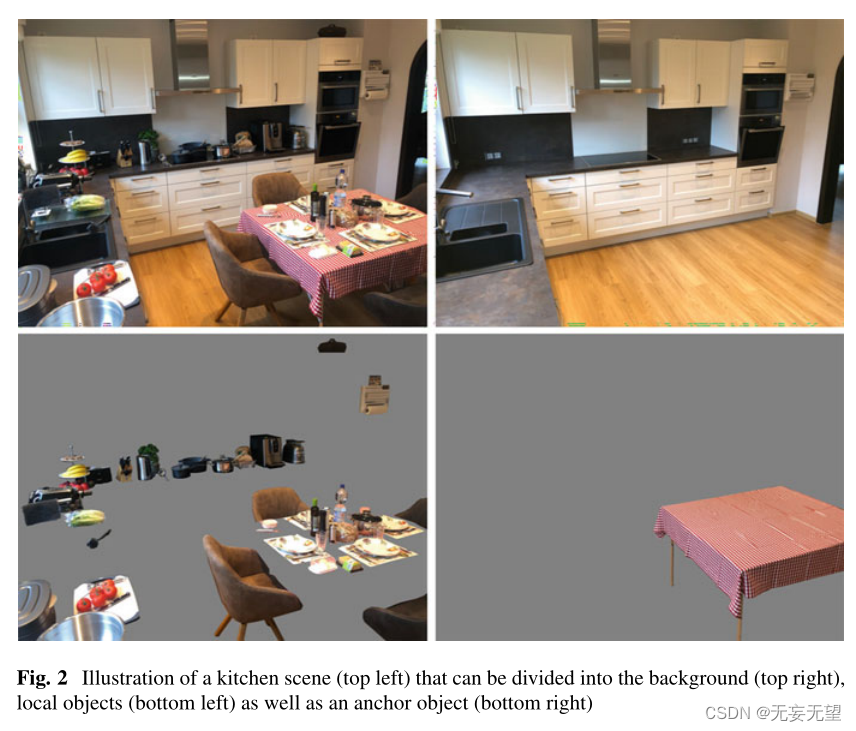

考虑到在搜索阶段,场景作为一个整体并没有被感知,这个范式允许实验者评估场景的初始全局感知对视觉搜索的贡献。然而,请注意,在更自然的搜索条件下,这种贡献可能更弱,在这种条件下,整个场景也可以在搜索过程中在线处理(参见V? & Wolfe, 2015)。在这些研究中,场景预览已经显示出对视觉搜索的持续影响,即使它只有50毫秒(V? & Henderson, 2010)。V?和Schneider(2010)操纵场景预览中可用的上下文信息类型,有选择地保留全局场景背景或局部对象(举例说明,见图2)。

场景背景的可用性传达了场景的空间布局,与控制条件相比,可以更快地检测到目标,并且需要更少的注视,而局部对象的预览则不利于搜索。因此,场景结构和意义的粗略表示似乎已经有效地指导了视觉搜索。有趣的是,只知道场景的类别似乎是不够的,正如在搜索场景时所显示的那样由同一类别的不同场景范例或类别的单词标签启动。例如,一个与目标在语义上不一致的场景(例如,卧室里的一大杯油漆刷)可以促进搜索,因为对象出现在一个合理的位置(Castelhano & Heaven, 2011,关于评论,请参见Castelhano & Krzy, 2020)。

场景的空间布局可以为我们提供关于物体位置的重要约束。例如,物体的出现受到物理定律的限制,物体停留在表面上,而不是在空中盘旋。

即使我们不能完全掌握场景的意义,我们也可以分辨出它的主要表面在哪里(例如,厨房柜台,桌子等)(见图2)和/或天空和地平线的位置。此外,两个物体通常不会占据相同的物理空间(Biederman等人,1982),我们知道某些物体通常出现在哪里(例如,地毯经常位于地板上)(Kaiser & Cichy, 2018;Neider & Zelinsky, 2006)。在低水平显著性模型中纳入可能的垂直物体位置可以显著提高凝视预测,正如上下文引导模型所证明的那样(参见Oliva和Torralba, 2006)。最近,引入了表面引导框架,建议将注意力分配到场景中与目标物体相关的表面(Castelhano & Heaven, 2011;Pereira & Castelhano, 2014、2019;有关审查,请参阅Castelhano & Krzy ' s, 2020)。

3.2 The Role of Local Objects

另一项研究调查了选定的场景部分,特别是物体,对注意力分配的影响。在一个自然搜索任务中,Mack和Eckstein(2011)要求参与者戴着移动眼动追踪眼镜搜索桌子上的物体。目标物体(例如,叉子)要么位于所谓的线索物体附近,它可能在自然场景中与之共同出现(例如,盘子),要么位于其他地方(靠近其他物体)。如果目标位于线索物体附近,那么它们被找到的速度会更快,而且线索物体比目标周围的其他物体更容易被固定,这表明现实世界中的物体共存可以提高搜索性能。在另一项研究中,参与者检查场景图像或搜索其中的目标,使用带有对象注释的场景LabelMe数据库来确定当前注视的对象与场景中其他对象或搜索目标的语义相关性(Hwang et al, 2011)。

研究表明,目光更有可能转移到与当前注视的物体在语义上相关的物体上,即使这些物体离得不是很近。此外,搜索数据显示,在整个试验过程中,基于目标的语义引导的影响有所增加。

即使从场景中裁剪(删除)对象,也可以复制相关对象之间可能过渡的发现,但当通过重新排列裁剪对象而丢弃裁剪对象之间的空间依赖关系时则不会(Wu等人,2014a)。

当为了提供要点信息而添加原始场景的预览时,没有迹象表明语义引导增加了。此外,有证据表明,在没有场景背景的情况下,物体的功能排列会影响凝视方向(例如,钥匙的排列方式使得它可以或不能插入锁中)(Clement等人,2019)。在对象数组中,语义信息可以在整体外提取,甚至可以指导搜索过程中的第一眼运动(Nuthmann et al, 2019)。综上所述,对象的语义关系及其空间依赖关系似乎都与搜索过程中的注意力分配有关。

3.3 The Role of Anchor Objects

似乎有些物体不仅能预测事件的发生,还能预测场景中其他物体的位置。Boettcher等人(2018)探讨了空间预测在基于对象的搜索引导中的作用,引入了锚定对象的概念。锚点通常是大型的静态对象(即,它们很少移动),它们可以对周围聚集的局部对象的身份和位置产生强烈的预测(例如,桌子可以预测椅子、一杯水和盐的位置)。相比之下,局部物体不一定能预测其他局部物体的位置(例如,在搜索盐时,玻璃杯的位置可能没有那么多信息)(见图2)。使用LabelMe数据库,锚定物体的概念通过四个因素进行操作:空间位置的方差、共出现的频率、物体到物体的距离和物体的聚类(见Boettcher等人,2018;c.f. V? et al ., 2019)。

在一系列眼动追踪实验中,观察者在3d渲染场景(如浴室)的图像中搜索目标物体,这些图像被操纵为包含与目标相关的锚点(如淋浴)或选择与场景语义一致且大小相似的替代物体(如橱柜)。与替代对象相比,相关锚会影响搜索性能,从而减少反应时间、场景覆盖率以及从锚到目标的转换时间。与此相一致,在最近的一项虚拟现实实验中,当锚点被相似尺寸的灰色长方体隐藏时,与完全可见时相比,参与者定位目标物体的速度更慢(Helbing et al, 2020)。

随机重新排列锚点(或长方体)会产生相反的效果,即在长方体条件下,目标被更快地定位,这表明锚点的身份和空间预测对它们指导搜索的能力至关重要。请注意,这些固有的空间预测将锚定对象与诊断对象的概念区分开来(例如,MacEvoy和Epstein, 2011),这对于传达场景意义和促进场景分类可能很重要,但不需要对其他对象的发生进行精确预测(V?等人,2019)。锚点对象似乎甚至可以在外围被识别(参见Koehler & Eckstein, 2017b,关于物体线索的外围提取的演示),因此它们可能提供一种有效的方法来定位较小的目标,在全局场景和局部物体之间建立一座桥梁。

3.4 Scene Grammar

综上所述,虽然场景主旨产生了场景结构和意义的初始粗略表示,可以有效地缩小搜索空间,但选定的对象允许更细粒度的指导类型(参见Wolfe et al, 2011b)。最近关于锚对象作用的研究表明,锚对象在引导搜索的能力上并不都是平等的。相反,场景似乎是分层组织的,锚点是构成场景中有意义的子单元的所谓“短语”的核心(例如,“淋浴短语”与“厕所短语”)。在这些短语中,锚点对其中的其他局部物体有更强的预测(例如,洗发香波在淋浴间里,马桶刷在马桶旁边)。当在浴室里搜索卫生纸时,你可以通过完全避免搜索与淋浴和水槽无关的短语来大大减少搜索时间(和压力!)。

虽然场景中固有的一些规律在几十年前就已经被描述过了(例如,Biederman et al, 1982;Boyce & Pollatsek, 1992;P a me r, 1975),它们现在可以使用大规模注释数据库和描述性统计直接测量(Greene, 2013, 2016;Russell et al, 2008)。与语言领域类似,我们一直在参考场景中隐式获得的关于对象倾向于在哪里的各种规律的知识作为场景语法(有关评论,请参阅V?, 2021;V?等人,2019;V ? & W o l f, 2015)。在语言中,语义是指词与词之间的概念关系,而句法是指句子结构的规则。

因此,我们分别使用场景语义和句法术语来描述对象-场景关系的意义(例如,一个锅属于厨房,而不是浴室)或这些关系的结构性质(锅属于炉子顶部,而不是地板上)(V? & Henderson, 2009b)。违反场景语法已被证明会阻碍搜索性能并强烈影响眼球运动(例如,V? & Henderson, 2011)。例如,语义和语法违规通常比它们一致的对偶更持久、更频繁(例如,V? & Henderson, 2009a)。当物体在场景中定位不一致时,一旦物体被固定,就需要更长的时间来确定它是否是目标(例如,V? & Wolfe, 2013)。因此,上下文规律不仅会影响搜索引导,还会影响搜索各个阶段的目标识别。

4 Object Recognition in Scene Context

目标识别是搜索中不可或缺的一部分:需要评估干扰物是否为目标候选物,最终需要识别目标并将其与搜索模板进行匹配(详细信息请参见第2节)。

在下面,我们将概述场景背景如何影响对象感知。情境对客体知觉的影响已经被广泛研究了几十年。V ?虽然主要是从视觉搜索中分离出来的——使用行为测量,最近也使用神经生理学方法。这条线的核心问题之一

4.1 Behavioral Work

传统上,场景上下文对物体处理的影响是通过线条图来研究的(Biederman et al ., 1982;Boyce et al, 1989;Boyce & Pollatsek, 1992;Hollingworth & Henderson, 1998,1999;P . a . m . r ., 1975)。在Biederman等人(1982)的有影响力的对象检测范式中,观察者被展示了一个目标词(例如,消防栓),随后是一个简短的场景线条图和一个带有位置线索的图案面具。观察人员被问及是否在提示位置看到过目标物体。与场景上下文一致的目标对象(例如,街道上的消防栓)比语义或语法不一致的对象(例如,厨房里的消防栓或街道上方的空中消防栓)(另见Boyce等人,1989)或其他形式的违规(不太可能而不是不可能的位置的对象,或尺寸异常的对象)被检测得更快、更准确。然而,当考虑到反应偏差时,一致性优势并没有被复制(Hollingworth & Henderson, 1998,1999),这为功能隔离模型提供了支持,提出场景和对象处理在感知层面上没有相互作用。

最近,研究人员使用场景的彩色或灰度照片和物体命名任务来探索背景在物体识别中的作用(Davenport & Potter, 2004;Lauer et al, 2018;Lauer等,2020a;Munneke et al, 2013;Sastyin et al, 2015)。观察者被简单地呈现在一个场景中,在前景中包含一个一致或不一致的物体切割(或一个孤立的物体叠加在场景上;Lauer等人,2018,2020a, 2020b),然后是一个感知遮罩和一个响应窗口,在那里他们输入对象的名称。在这种范式中,不容易产生反应偏差,克服了早期行为研究的一些局限性(见Davenport & Potter, 2004),在研究中,一致的对象比不一致的对象命名更准确。

在这里,我们将这种效应称为场景-对象一致性效应。此外,如果场景在前景中包含一致或不一致的对象(对象-场景一致性效应),则场景的命名会更准确,这表明对象和场景是交互处理的(Davenport & Potter, 2004;参见达文波特,2007;Leroy et al, 2020)。场景-对象一致性效应不能仅仅通过上下文和目标之间的低水平特征重叠来解释,也不依赖于对对象的明显注意(Leroy et al, 2020;Munneke et al, 2013)。有趣的是,场景-对象一致性效应的大小是由视点调节的:从标准(容易)角度观察的对象比从非标准(困难)角度观察的对象产生的效果更弱(Sastyin et al, 2015)。上下文调制还取决于目标的显示大小,对于更难解释的较小对象具有更强的效果(Zhang et al, 2020)。

在情境促进模型(Bar, 2004)中,场景的要点迅速激活场景图式,并产生与目标传入信息相匹配的相关对象的预测,从而提高其识别能力。

我们最近通过对比叠加在场景上的孤立物体的精度与无法识别的混乱场景(基线)上物体的精度,探讨了场景-对象一致性效应是否反映了感知层面上物体处理的便利性(Lauer et al, 2020a)。场景中一致的物体比混乱场景中一致的物体命名更准确,这表明场景背景确实促进了物体识别。

此外,场景中不一致的对象的命名比混乱场景中不一致的对象的命名更不准确,这表明一致性操作也会干扰性能,无论是在感知阶段(例如,通过产生误导性的预测)还是在后感知阶段(例如,通过干扰性能的不匹配检测)。然而,应该指出的是,其他一些研究并没有发现场景背景存在与不存在时物体识别的促进作用(Davenport & Potter, 2004;Lauer et al, 2018;Roux-Sibilon等人,2019)。可能,在突出的前景物体或孤立的物体的情况下,简化效果并不总是强大的,因为图像-背景分割可以说是容易的。在一些范例中,基线(无上下文条件)中强大的分割优势也可能导致疏导效应的缺失(见Davenport & Potter, 2004)。

在更自然的条件下——当物体嵌入场景中,分割需求也存在于基线中(例如,通过提供目标周围的最小上下文)——促进作用被反复显示出来,特别是对于更难以解释的较小目标(有关广泛的演示,参见Zhang等人,2020;另见Brandman & Peelen, 2017)。除了在嵌入对象的情况下有不同的分割要求外,这些对象也不同于孤立的对象,因此上下文可以产生空间预测和目标大小的估计,潜在地增加了对象识别的上下文促进程度。

在最近的另一项研究中,物体被呈现在场景内或场景外的同一水平或垂直平面上(单侧或双侧)(Leroy et al, 2020)。在整个操作过程中,一致的对象和一致的场景分别比不一致的对象和场景被更准确地命名,这证实了对象-场景一致性效应的相互性质。考虑到即使物体和场景没有嵌入到同一感知中,情境调制也很强大,这些发现还表明,场景情境效应可能发生在视觉信息与先验知识匹配的阶段,而不是在物体处理的最早阶段产生。

4.2 Neurophysiological Work

在神经生理学研究中,使用脑电图也研究了环境对物体处理的影响。具体来说,事件相关电位(ERPs)提供了一种时间上精确的测量方法,可以在线跟踪刺激暴露期间的情境效应。研究最广泛的上下文敏感ERP成分是N400,这是一种负偏转,在刺激开始后400毫秒左右达到峰值,最初是在语言领域报道的:语义不一致的句子与语义一致的句子通常会引起集中分布的N400效应,表明语义获取的阻抗(Kutas & Hillyard, 1980, 1983;有关评论,请参见Kutas & Federmeier, 2011)。

在场景感知领域,场景中一致或不一致的物体(或叠加在场景上)已被证明可以在相当的时间过程和地形上唤起N400响应(Draschkow等人,2018;Ganis & Kutas, 2003;Lauer et al, 2018;Lauer等,2020a;Mudrik et al ., 2010, 2014;Truman & Mudrik, 2018;V ? & W o l f, 2013;Zucker & Mudrik, 2019),表明在语义不一致的场景环境中,对象的访问或集成受到阻碍(Mudrik等人,2010年,2014年)。此外,在那些使用场景刺激的研究中,语义一致性操作诱发了更早的负面情绪,有时更多的正面最大值被称为N300(但见Ganis & Kutas, 2003)。

有人认为,在完成对象识别之前,这一成分可以在更感性的层面上反映情境效应(例如,Mudrik等人,2010年,2014年)。具体来说,它可能反映了将目标的传入信息与不一致的场景上下文产生的(误导性的)预测相匹配的难度。虽然已经确定场景上下文可以在物体识别完成之前调制物体处理(Lauer等人,2020;Leroy等人,2020;Truman & Mudrik, 2018;另见Brandman & Peelen, 2017),就潜在过程而言,N300/N400组件是否实际上可区分仍然存在争议:在我们实验室最近的一项研究中,发现这两个组件在时间广义解码分析中广泛共享神经元活动模式(Draschkow等人,2018)。

与场景中的语义违规相反,句法违规(例如,浴室地板上的毛巾)不会引起N300/N400效应,而是随后的积极性,可与语言中经常报道的语法违规的P600相媲美(V? & Wolfe, 2013)。在漫画(Cohn et al ., 2014)和动作系列(Maffongelli et al ., 2015)中也发现了对结构、“句法”不一致的不同反应。因此,大脑似乎根据客体-场景关系的意义和结构性质来区分它们的处理。

场景意义在大脑的哪个部位被处理,它又在哪里影响对物体的感知?在功能性磁共振成像(fMRI)实验中,Brandman和Peelen(2017)向观察者展示了分离的退化(即。场景中退化的物体,或没有任何目标物体的场景,并在视觉皮层(特别是在枕侧和后梭状沟区域)中发现了上下文促进的迹象:影响对象搜索和感知的场景成分的解码精度15场景中退化的物体以超加性的方式超过了其他两种条件下的精度,也就是说,它大于这些条件下的精度之和。

有趣的是,情境促进的效果与对场景处理至关重要的区域(例如,海马体旁区和脾后皮层)的活动相关(关于场景选择区域及其功能的综述,请参见Epstein & Baker, 2019)。脑磁图(MEG)数据显示,超加性促进在刺激开始后320毫秒左右出现,与没有场景背景影响的前馈型物体处理相比,这是相对较晚的(Cichy等,2014)。值得注意的是,情境促进的程度似乎取决于目标的视觉特征:在行为层面上,物体检测的促进与物体的模糊性相关,更容易识别的完整物体的促进程度降低。

与先前的研究一致,这些发现表明上下文调制可以在感知层面上产生,并指出可能在视觉皮层中相互作用的单独的场景和物体处理途径。

最近的另一项研究补充了这些发现,在呈现带有完整物体的退化场景时,显示出场景选择区域的情境促进迹象(Brandman & Peelen, 2019)。除了相互类型的对象-场景促进外,还有证据表明通过听觉和语义线索对对象处理进行多模态促进(Brandman et al, 2019)。

综上所述,最近的行为和神经生理学研究表明,场景和物体处理在功能上并不是孤立的,而是相互影响的,促进了感知,尤其是当目标刺激难以解释时。

4.3 Which Scene Ingredients Affect Object Processing?

在过去的几十年里,大量的研究表明,场景环境影响物体感知,然而,很少有人问视觉系统实际利用哪些环境成分,以及它们在哪些时间点是相关的。下面概述了几个研究单个场景属性的研究,将其归类为采用全局或局部操作的研究(分别影响整个环境或部分环境)。

对对象处理的全局影响。

在一项行为研究中,Brady等人(2017)简要地向观察者展示了一个由灰度场景或具有相似方向和空间频率空间分布的纹理场景启动的物体,保留了场景的全局形状,但没有可识别的物体(Oliva和Torralba, 2006)(见图3)。由语义一致的场景启动的物体比由不一致的场景启动的物体更准确地命名。

关键是,在纹理化场景中发现了类似但较弱的场景-对象一致性效应,这表明即使在缺乏语义对象信息的情况下,全局场景属性(特别是空间布局信息)也可以调节对象识别。这一发现与强调用于快速场景理解和分类的全局场景属性要性的研究相一致(Greene & Oliva, 2009a, 2009b;Joubert et al, 2007;Oliva & Torralba, 2001,2006;Rousselet et al, 2005)。

在我们小组的一项相关研究中,我们展示了叠加在彩色场景、场景纹理或混乱场景(颜色控制)上的一致和不一致的缩略图对象(Lauer et al, 2018)。我们对场景纹理化的方式是不同的,我们保留了全局场景汇总统计(包括一阶到二阶统计以及幅度和相位相关);见Portilla & Simoncelli, 2000),同时丢弃对象语义和空间布局信息(见图3)。对于场景,我们发现了行为层面的一致性效应以及erp中的N300/N400效应。

对于纹理,我们在行为水平上发现了相同方向的不显著趋势,并且在相当的时间过程中发现了显著的N300/N400反应,尽管不那么明显。搅乱的场景,即保留了原始场景的色彩特征,并没有显示出这样的效果。因此,即使在没有空间布局信息的情况下,保存在纹理中的低级场景统计数据也可以调节物体的处理,而仅仅是颜色信息似乎是不够的。然而,应该指出的是,在影响对象搜索和感知的场景成分中,没有迹象表明在行为层面上有促进作用,无论是场景还是纹理,这表明在本研究中,情境效应可能是由干扰驱动的。

相比之下,Zhang等人(2020)发现对场景中嵌入的物体有很强的促进作用,但对纹理上的物体切割仍然没有促进作用:与具有全尺寸纹理上下文的条件相比,在基线(最小纹理上下文)下的准确性甚至略高。请注意,本研究中没有一致性操作。计算机视觉模型(详见5.2节)对于纹理上的物体能够达到比基线更高的精度,但只有在目标物体很小的情况下,并且简化效果明显弱于原始场景。

此外,我们实验室最近未发表的数据表明,物体在全局材料背景下(例如,木头上的椅子与水上的椅子)(见图3),而不是在混乱的材料(颜色控制)的背景下,在行为水平上产生边际一致性效应,以及N300/N400反应,这与在场景中发现的反应相当,尽管较弱。

在另一项研究中,我们探讨了物体和场景方向在场景一致性效应中的作用(Lauer et al, 2020a)。具体来说,我们使用了反转,这是一种保留低级图像属性(相位除外)但可能干扰语义处理的全局操作(见图3)。在行为和erp中,我们发现有迹象表明,直立场景调节直立和倒立物体的处理,但倒立场景仅调节倒立物体的处理。在倒置和直立场景中,ERP效应的出现较晚,我们认为场景倒置可能会干扰快速的场景列表识别,导致情境影响在物体处理中较晚出现。

此外,观察者可用的视觉上下文的数量(量化为没有目标的显示图像面积除以目标的大小)被证明强烈影响目标识别性能(如图3所示);在小的、难以感知的目标情况下,促进作用特别强(Zhang et al ., 2020)。此外,即使在图像中度模糊时(高斯分布,M = 0, SD≤8,图像大小= 1024 × 1280像素),全场景的上下文调制也具有鲁棒性(见图3),但当图像模糊程度较强时(SD > 8,见Zhang等人,2020),上下文效果并不依赖于高空间频率传达的精细细节。

此外,还研究了场景部件整体空间配置的作用。为此,整个场景被分成相等的部分(2 × 2、4 × 4或8 × 8的“拼图”),这些部分被随机重新排列,而包含目标的部分保持在其原始位置(见图3)。与最小背景(对照)条件相比,完整的配置有助于物体识别。与不一致的4 × 4和8 × 8配置相比,精度也有所提高;然而,不一致的2 × 2配置导致了类似的性能,这可能表明即使场景的全局配置不一致,大型场景部分也已经传达了足够的上下文信息。

RouxSibilon等人(2019)探讨了周边视觉在中央凹物体识别中的作用。被语义一致的周边场景环境包围(超过6度或8度)的物体比被包围的物体分类速度更快。V ?在有周边场景预览时被不一致的上下文所影响。

此外,改变目标的相位相干性导致一致目标的可见性阈值低于不一致目标的可见性阈值。在相位打乱的外围场景中,没有观察到上下文效应,保持了功率谱,但没有场景汇总统计或形状信息(见Brady等人,2017;Lauer et al, 2018)。

综上所述,这些研究表明,语境对对象处理有全局影响,这种影响不依赖于语境的选定部分,而是依赖于语境作为一个整体的粗略表征。在下文中,我们将探讨更多的局部影响在对象处理中的作用。

局部对对象处理的影响。

可能与对象处理相关的一种本地信息是其他对象的存在。许多研究已经在没有场景上下文的情况下操纵语义对象对对象关系,例如,通过用相关或不相关的对象启动目标对象,或同时向目标提供周围对象。在行为层面经常发现亲缘关系的影响(例如,Auckland等人,2007;Henderson等人,1987)以及在神经元层面(例如,Barrett & Rugg, 1990;Kovalenko等,2012;Li et al ., 2019;McPherson & Holcomb, 1999)。

除了语义关系外,空间对象关系也对对象加工具有调节作用。例如,如果两个相关的物体的空间排列是典型的,而不是非典型的(例如,桌子上的灯和桌子下的灯),那么它们的命名更准确或分类更快,因为两个物体都被人注意到了(Gronau & Shachar, 2014;Roberts & Humphreys, 2011;另见Gronau, 2020)。此外,有电生理学证据表明,语义相关性和空间关系在对象处理中相互作用(Quek & Peelen, 2020)。然而,这些对象对对象效应在场景背景下的作用——在其他视觉信息的存在下——还有待探索。

据我们所知,只有两项行为研究联合调查了场景背景和对象的影响。一项研究发现场景背景对物体检测有影响,但场景中(5)个物体之间的相关性没有影响(Boyce et al, 1989)。然而,正如达文波特(2007)指出的那样,本研究中缺少局部情境效应可能是由于刺激的特征(例如,带有小物体的场景的线条画)。

在最近的一项物体命名实验中,研究人员向观察者展示了两个前景物体,要么相关,要么不相关,在一个场景中,要么与两个物体一致,要么与一个物体一致,要么两者都不一致。场景到对象的一致性导致更高的准确性,对象到对象的相关性也是如此,没有两个变量的相互作用(Davenport, 2007)。

在我们实验室的一项相关研究中,我们利用脑电图(EEG)探索了这些类型的情境效应的时间动态(Lauer et al, 2020b)。与所有其他条件相比,只有当两个物体与场景无关或不一致时,我们才发现N300/N400 ERP响应;所有其他可能的比较都不显著,这表明一个对象与场景或邻近对象的一致关系足以消除这种类型范式中的N300/N400不一致效应。因此,根据场景感知的交互视图,我们发现了一些全局和局部上下文效应的迹象,在时间轴上没有明显(Davenport & Potter, 2004)。值得注意的是,在这些研究中,背景场景中包含的物体可能会产生背景效应。此外,在我们的研究中,关键对象是显著的,接近注视点。

未来的研究可能需要评估其他局部场景属性和观看条件的影响。

?5 Concluding Remarks and Future Directions

尽管视觉搜索和物体识别是典型的两个不同的研究领域,具有不同的实验设置,在下面,我们试图将本章概述的研究结果结合在一起,指出两个领域之间的一些相似之处和明显的差异。此外,我们将讨论上下文成分的相对贡献问题,并以人类和计算机视觉研究的互惠利益部分结束。

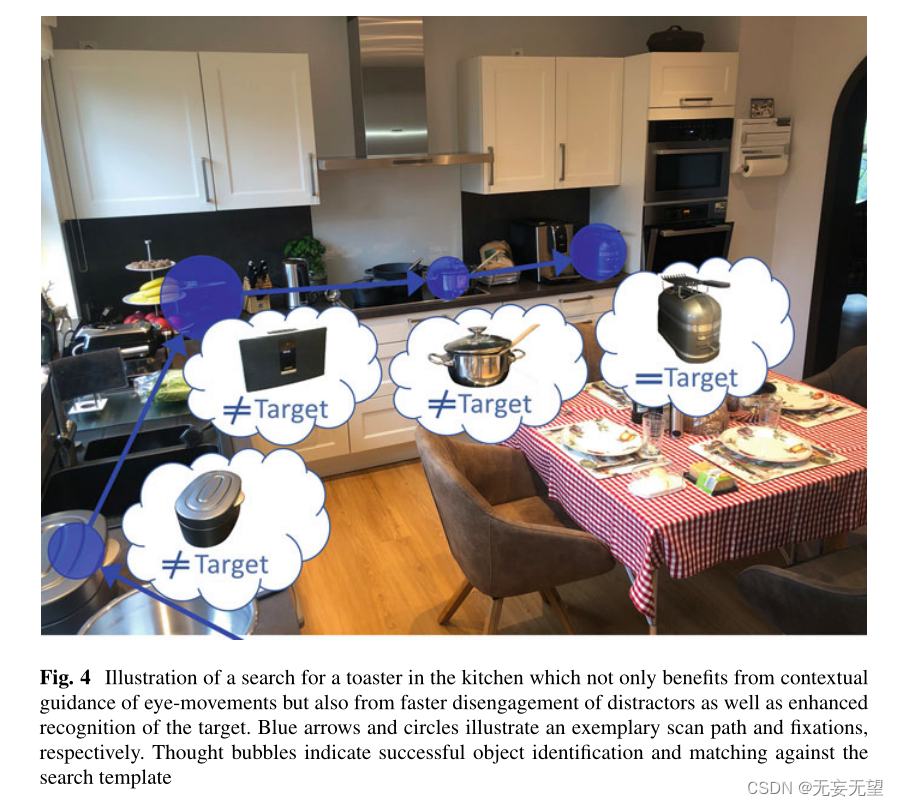

首先,视觉搜索通常包括不同阶段的目标识别。例如,每个干扰物都需要评估,以确定它是否是目标候选物。一旦锁定目标,就需要识别这个关键对象,并将其与搜索模板进行匹配。因此,场景上下文的好处不仅是由于场景语法更有效的引导,而且可能还由于改进的物体识别,导致更快地脱离干扰物和目标识别——后者通常以决策时间(即,从初始目标固定到按钮按下指示搜索终止的时间)来衡量。图4提供了在厨房中搜索烤面包机的示例。

因此,来自两篇文献的证据表明,场景主旨可以从场景的空间布局中推断出来(c.f. V? & Wolfe, 2015),可以很容易地调节搜索性能和对象处理。这种类型的上下文信息可以非常快速地获得,并且可以分别缩小搜索空间(例如,我们将在看起来像厨房的大水平表面上搜索烤面包机)或可能的对象标识的数量(例如,该项目可能是电子设备,而不是岩石)。事实上,即使是50毫秒的上下文暴露也足以影响搜索(V? & Henderson, 2010)以及对象识别(Zhang等人,2020)-在没有向后屏蔽的情况下,这个数字甚至可以更低(例如,在对象识别的情况下,25毫秒,Zhang等人,2020)。

此外,已经确定场景的局部属性,特别是共同发生的物体,是目标定位和识别的重要信息来源。为此,既利用了共同发生的局部对象的语义相关性,也利用了它们的空间依赖性。在我们实验室最近的一项虚拟现实研究中,与锚点被灰色长方体隐藏的情况相比,场景中的锚点物体不仅引导搜索,而且在目标物体被固定后显著缩短了决策时间(Helbing et al, 2020)。

5.1 Relative Contributions of Context Ingredients

虽然已经确定了几个调节搜索和/或对象处理的上下文成分,但对这些成分的相对贡献知之甚少,特别是随着时间的推移。一些工作集中于评估场景背景和对象内容在视觉搜索中的相对重要性,如下所述。虽然在没有物体的场景背景中短暂浏览有助于搜索,但当简短地显示局部物体而不是场景背景时,没有发现便利(V? & Schneider, 2010)。此外,有证据表明,当场景背景与对象内容在整个搜索过程中可用时,搜索性能更高;然而,这两种类型的信息被证明是相互作用的,以至于场景上下文为相关区域提供了粗略的指导,而对象内容则为特定区域提供了指导(Pereira & Castelhano, 2014)。

总之,这些发现可能表明全局场景属性总体上有更大的贡献,并且它们比局部属性更容易被利用——后者可能首先需要通过“选择”来解析,该路径将特征绑定到对象中(Wolfe et al, 2011)。然而,在其他一些研究中,物体的影响可以说更强:Koehler和Eckstein (2017a, 2017b)发现场景背景对搜索和感知决策的影响小于对象内容,对象内容分为共同发生的对象(靠近目标)和多对象配置(包含场景中的所有其他对象)。

虽然在早期的眼球运动中已经存在多物体配置的影响,但后来共同发生的物体信息被用于更细粒度的指导类型。这些发现与研究结果一致,研究表明,在没有场景主旨信息的情况下,对象内容会产生语义引导,但只有在对象的空间配置完整的情况下,而当有对象内容时,场景主旨不会增强对语义信息的利用(Wu et al ., 2014a)。

关于场景背景相对重要性的混合结果的一种解释可能是,场景背景在不同研究中对目标位置的信息并不相同。有趣的是,Koehler和Eckstein (2017a, 2017b)发现,每个情境成分对预期目标位置的判断预测了对该特定成分的眼动引导的大小——场景背景的贡献较低,这与发现场景背景是目标位置信息最少有关。在其他研究中,场景背景可能会提供更多信息,可能与场景背景和对象内容的定义方式有关。

例如,较大的元素(如床)有时被认为是物体,因为它们可以合理地移动(Koehler & Eckstein, 2017a, 2017b),而在其他情况下,它们被认为属于背景(V? & Schneider, 2010;另见Pereira & Castelhano, 2014)。

这些较大的物体不仅可以为局部物体提供表面(Castelhano & Krzy’s, 2020;Pereira & Castelhano, 2019),但也构成了场景中有意义的亚单位:最近有研究表明,锚定对象明显有助于搜索引导,比其他语义相关对象(Boettcher等人,2018)或类似大小的无意义长方体(Helbing等人,2020)产生更强的促进作用。

因此,上下文成分的相对贡献可能在很大程度上取决于它们产生的空间预测的精度(另见Eckstein, 2017),这可能因研究和概念化而异。换句话说,视觉搜索的目标是定位某些东西,我们可能会利用这些属性来精确地“告诉我们去哪里看”。当然,在视觉系统中什么时间、什么地点、以什么代价获得什么信息是有限制的。也就是说,一个属性可能非常有用,但还没有被选择和处理到可以指导搜索的程度(Wolfe et al, 2011b)。

虽然毫无疑问,空间预测也用于对象识别,但它们自然不是对象处理的上下文调制的先决条件。例如,即使目标的位置与其身份完全没有信息,也可以看到物体识别的便利性(见Lauer等人,2020a)。虽然物体识别文献提供了在场景中没有任何可识别物体的情况下上下文调制的明确证据(例如,Brady等人,2017),但在没有物体内容的情况下,这些基于场景(与基于物体)的成分的相对贡献尚未得到评估。目前有一些迹象表明,场景情境(包括对象)和对象共现都可以产生相当程度的情境效应(Davenport, 2007;Lauer et al, 2020b)和时间轴(Lauer et al, 2020b)。

综上所述,未来的工作可以旨在进一步梳理不同的全局场景属性的相对贡献,以及以各种类型共同发生的物体的形式提供更多的局部信息,同时还评估它们对目标的信息程度。测试不同类型的场景成分是如何随着时间的推移施加影响的,这一点尤为重要

5.2 Context in Human and Computer Vision

最近在更好地捕捉人类在现实世界中的目标搜索和感知效率方面取得的许多进展,都是由大规模数据库和计算模型促进的(例如,Boettcher等人,2018;Greene, 2013, 2016;Rosenholtz et al, 2012)——灵感来自于广泛的心理生理学、眼动追踪和神经生理学研究。有趣的是,近年来,计算机视觉算法在许多任务中已经达到(甚至超过)人类的表现水平。

研究计算解决方案如何完成这些任务可能对未来更好地理解人类视觉感知机制非常有用。也就是说,由视觉系统启发的计算模型,如果得到验证,可以用于以高度控制的方式测试关于人类视觉的假设(有关审查,请参阅Lindsay, 2020)。尽管存在一些挑战,但研究人员最近开始将dnn(特别是卷积神经网络,cnn)与视觉系统层次上的人类感知进行比较和联系。cnn通常能很好地预测腹侧流的活动,较高人工层的输出能更好地预测较高视觉区域的活动(见Lindsay, 2020)。

经过场景识别训练的网络能够预测枕地区域的活动,为导航功能的处理提供见解(Bonner & Epstein, 2018;c.f. Lindsay, 2020)。还有电生理学证据表明,人类和dnn之间存在共享的时空场景类别信息(Greene & Hansen, 2018)。在行为层面上,人们不仅可以比较基准分类精度(dnn通常为此进行优化),还可以比较人类和dnn可能共享或不共享的错误模式(Wichmann et al, 2017)。例如,为什么与深度神经网络不同,人类有时无法注意到场景中的巨大目标,即使它们是显著的和固定的(Eckstein等人,2017)?这些和其他的评估可能会为在场景环境中搜索和物体感知的机制提供进一步的见解。为了测试或生成新的假设,受生物学启发的人工网络可以通过多种方式进行改变,例如通过操纵其架构、训练集或训练程序(见Lindsay, 2020)。当然,仔细的比较和解释是重要的;人类和神经网络可能会实现非常相似的任务结果,但在计算上是以完全不同的方式完成的。

另一方面,对于计算机视觉社区的大部分人来说,神经网络不需要在生物学上是可信的;它们通常是为了在给定的任务(如对象识别)中实现最高的性能。然而,了解人类在物体感知方面的效率,可能有助于进一步优化计算机视觉算法。最先进的深度神经网络和人类视觉机器之间的一个关键区别是,深度神经网络仍然需要大量的标记训练数据,而人类可以从非常少量的示例中学习新的对象概念(Morgenstern等人,2019;Spiegel & Halberda, 2011)。

此外,虽然dnn在某些受控条件下达到基准性能,但它们有时会在轻微变化的条件下失败(例如,图像退化或对比度降低;Geirhos等人,2018;Wichmann et al, 2017),因此可能缺乏人类视觉的鲁棒性和灵活性。

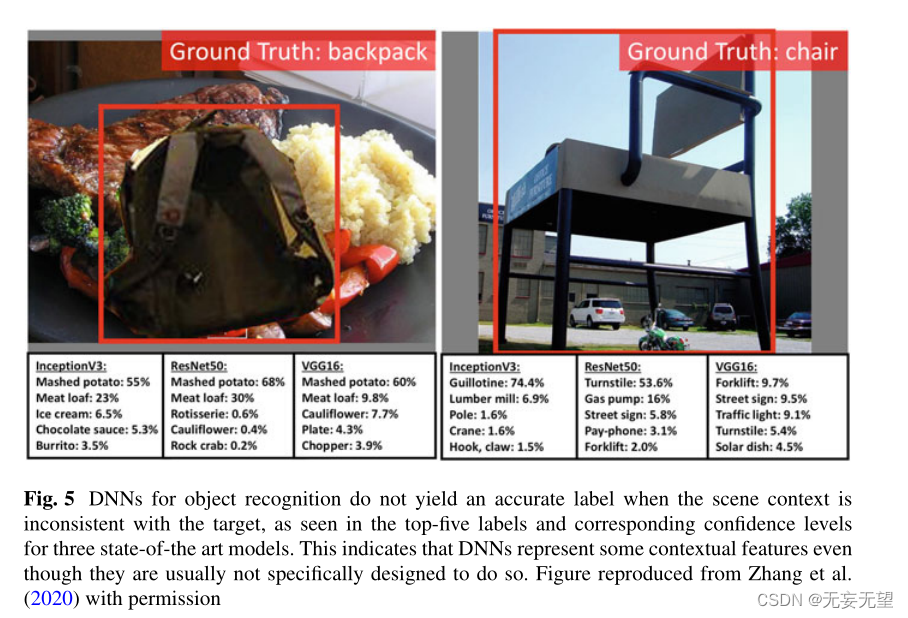

有趣的是,当目标以人眼无法察觉的方式改变时,甚至可能发生错误分类(参见“对抗性示例”,例如,Goodfellow et al, 2014)。在许多对象识别算法中,上下文信息仅被间接利用(Zhang等人,2020):例如,在自然场景中进行对象识别训练的dnn通常隐式地表示一些上下文特征,当它们被目标不一致的场景上下文愚弄时,这些特征就会变得明显(见图5)。

最近,Zhang等人(2020)引入了一种受生物学启发的模型,该模型建立在最先进的DNN特征提取的基础上,用于对象识别(VGG16),但更明确地融合了场景上下文;使用双流架构并行处理目标和上下文特征,并使用注意机制选择上下文的信息部分。

上下文感知双流注意网络(CA - TNet)与人类在各种物体识别实验中的表现高度相关(操纵上下文的数量、质量和动态),同时总体上也优于其他模型。然而,应该注意的是,当目标很小时,包括CA - TNet在内的所有测试模型的表现都比人类差得多。也就是说,自然图像中的可变对象尺寸仍然是计算机视觉中的一个挑战(Zhang et al ., 2020)。

另一个最近的双路径模型,gisnet,被设计成利用上下文的粗糙全局特征,灵感来自人类场景主旨感知(Wu et al, 2018)。研究表明,即使场景背景明显模糊,严重降低了可识别的物体,GistNet的表现也优于VGG16。作者还可视化了两个流实际使用的特征,并得出结论,中央凹路径使用“局部边缘和线条”,而全局路径找到“与列表样特征相对应的更全面的场景信息”(第5页)。

综上所述,类似于探索各种上下文成分对人类感知的影响,这些相同的成分也可以在计算机视觉应用中进行测试,从而在结合两个研究领域的方法和理论时进一步实现互惠互利。

6 Conclusion

我们在现实世界中寻找、识别物体并与之互动的方式在很大程度上是由它们发生的场景环境所塑造的。在本章中,我们概述了最近的努力,以确定哪些上下文信息(或“成分”)实际上被视觉系统用于有效的对象定位和识别。我们认为,在这两个领域中,可以从空间布局信息中推断出快速获得的场景的粗略全局表示,已经可以导致上下文调制。此外,至少室内场景倾向于分层组织,不同层次的上下文对对象搜索和感知都有很强的影响。虽然我们已经开始了解场景的哪些成分是重要的,但仍有许多工作要做,以更精确地评估各种上下文成分的相对贡献,特别是当它们在空间和时间上展开时。

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:veading@qq.com进行投诉反馈,一经查实,立即删除!