深度学习记录--神经网络表示及其向量化

2023-12-13 11:35:56

神经网络表示

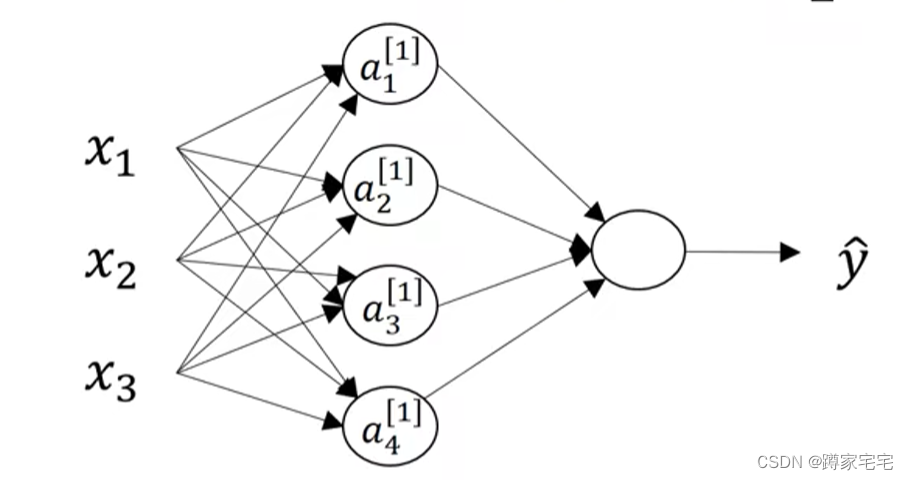

如下图

就这个神经网络图来说,它有三层,分别是输入层(Input layer),隐藏层(Hidden layer),输出层(Output layer)

对于其他的神经网络,隐藏层可以有很多层

一般来说,不把输入层算作一个标准的层,所以这是一个双层神经网络

神经网络的计算

对于每一层的每个节点,以logistic为例,每个节点会得出一个a值(y的预测值)

然后这个a值作为新的输入值进入下一层的节点,重复上一个过程

最终输出最终预测值

所以,每个节点都包含一个完整的logistic计算

如下图所示,第一层的a值代入到第二层的计算中

符号表示

从神经网络开始,出现了大量的符号,本弱鸡刚开始学也有点糊涂,经过好一番思考,才明白了每个符号的表示

层的表示

从输入层开始,每一层都需要被表示,一般用方括号上标表示第几层,注意,输入层为第0层

?

这个符号表示第i层的x值

样本表示

对于多份样本数据,一般用圆括号上标表示第几份样本数据

这个表示第i份样本数据,注意,每份样本数据包含了所有的特征变量(它的表示见下)

每份样本中特征变量的表示

上面说了每份样本数据包含了所有特征变量,特征变量如何表示

一般用下标表示第几个特征变量

这个表示某层第i个特征变量,nx为特征变量的总数

完整表示

这个表示第1层第3份样本数据中的第2个特征变量

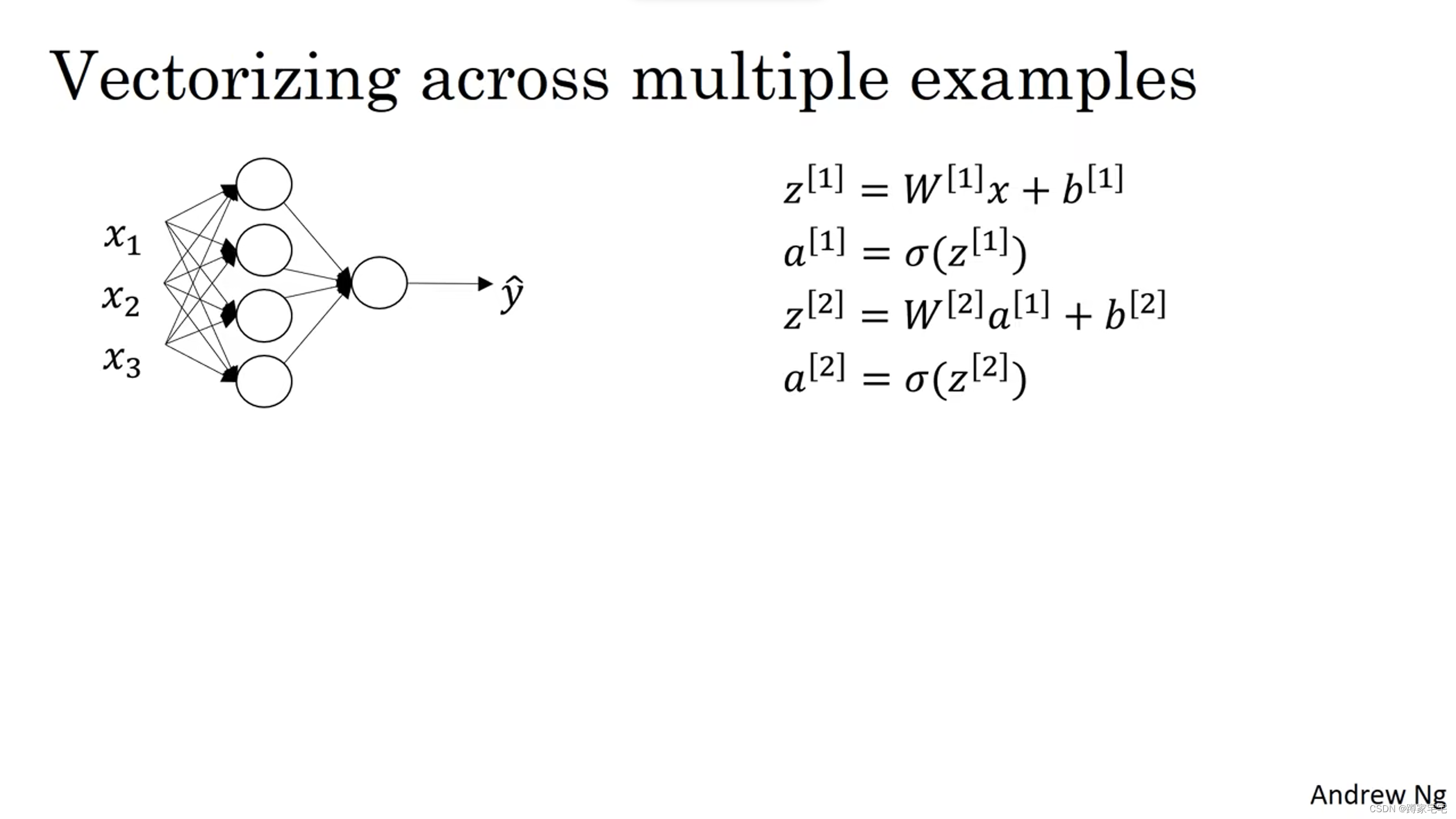

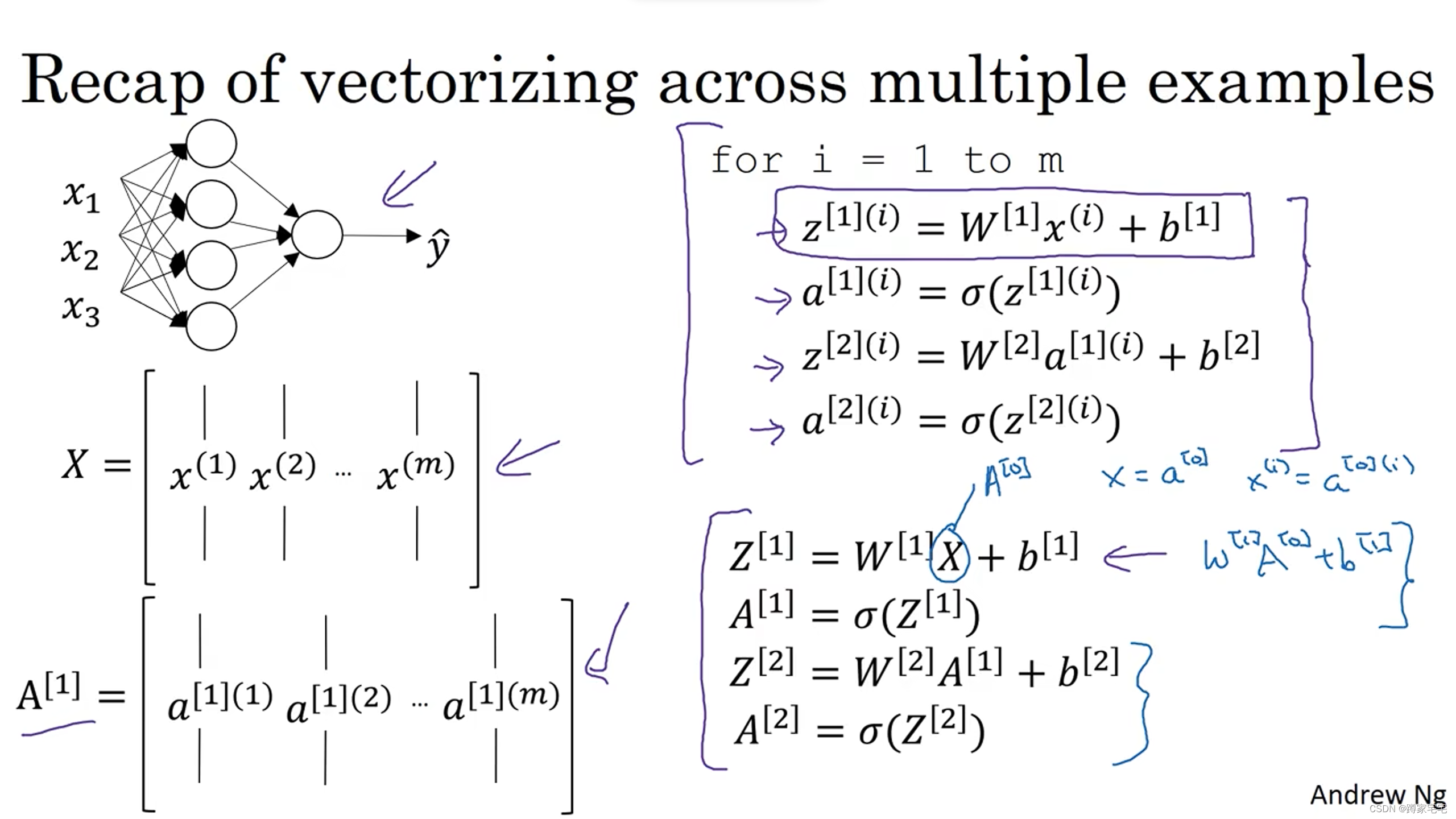

向量化实现神经网络

之前谈了向量化,现在用完整符号表示神经网络的向量化实现,见下图

以X举例,每个大X表示每层的X数据,大X中每列表示某份样本数据,自上而下是特征变量

其他符号同理,都是用矩阵实现

文章来源:https://blog.csdn.net/Xudong_12345/article/details/134893941

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:veading@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:veading@qq.com进行投诉反馈,一经查实,立即删除!