启动hadoop集群,发现只有一个namenode,子节点的namenode未启动

2023-12-13 05:47:10

问题描述

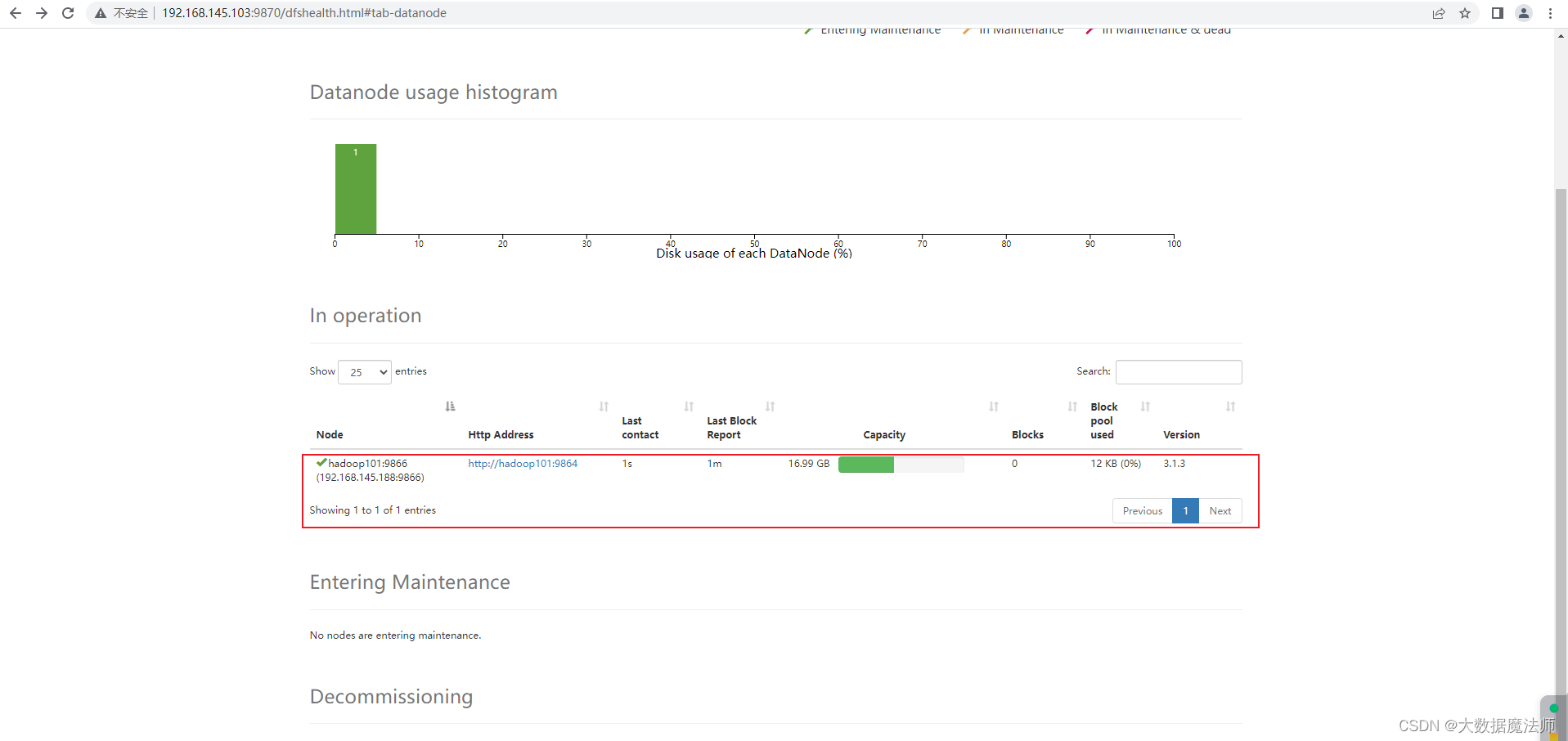

搭建好hadoop集群,然后启动hadoop集群后,发现只有一个datanode,正常应该是3个。

原因分析:

在配置hadoop时,没有设置hadoop的工作节点文件workers,所以默认是localhost。

解决方案:

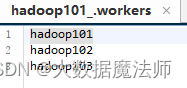

需要修改每个节点/opt/module/hadoop/hadoop-3.1.3/etc/hadoop/workers文件的内容。

vim /opt/module/hadoop/hadoop-3.1.3/etc/hadoop/workers

然后添加hadoop集群的节点,如下图:

再使用scp命令分发到其他两个节点。

点击链接查看scp命令介绍及其使用:linux常用命令-find命令与scp命令详解(超详细)

cd /opt/module/hadoop/hadoop-3.1.3/etc/hadoop

scp workers hadoop102:$pwd

scp workers hadoop103:$pwd

如下图:

然后重启hadoop集群,namenode变为了三个,如下图:

文章来源:https://blog.csdn.net/zcs2312852665/article/details/134836504

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:veading@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:veading@qq.com进行投诉反馈,一经查实,立即删除!