CSPNet: A New Backbone that can Enhance Learning Capability of CNN(2019)

文章目录

原文链接

源代码

-

梯度信息重用(有别于冗余的梯度信息)可以减少计算量和内存占用提高效率,但会降低精度(可能是因为重用梯度信息带来的近似误差)

Abstract

神经网络使最先进的方法在计算机视觉任务(如物体检测)上取得了令人难以置信的结果。然而,这种成功在很大程度上依赖于昂贵的计算资源,这阻碍了拥有廉价设备的人们欣赏先进技术。在本文中,我们提出了跨阶段部分网络(CSPNet),以缓解以往的工作需要从网络架构的角度进行大量推理计算的问题。我们将此问题归因于网络优化中梯度信息的重复。所提出的网络通过集成网络阶段开始和结束的特征映射来尊重梯度的可变性,在我们的实验中,在ImageNet数据集上以同等甚至更高的精度减少了20%的计算量,并且在MS COCO目标检测数据集上的AP 50方面显著优于最先进的方法。CSPNet很容易实现,并且足够通用,可以处理基于ResNet、ResNeXt和DenseNet的架构

1 Introduction

当神经网络变得更深[7,39,11]和更宽[40]时,神经网络表现得尤为强大。然而,扩展神经网络的架构通常会带来更多的计算量,这使得像目标检测这样的计算量很大的任务对大多数人来说是负担不起的。由于实际应用通常需要在小型设备上进行较短的推理时间,因此轻量化计算逐渐受到越来越多的关注,这对计算机视觉算法提出了严峻的挑战。尽管一些方法是专门为移动CPU设计的[9,31,8,33,43,24],但它们采用的深度可分离卷积技术与工业IC设计(如边缘计算系统的专用集成电路(ASIC))不兼容

在这项工作中,我们研究了最先进的方法(如ResNet, ResNeXt和DenseNet)的计算负担,我们进一步开发计算效率高的组件,使上述网络能够同时部署在cpu和移动gpu上,而不会牺牲性能

在本研究中,我们介绍了跨阶段部分网络(CSPNet)。设计CSPNet的主要目的是使该体系结构能够实现更丰富的梯度组合,同时减少计算量。这一目标是通过将基础层的特征映射划分为两个部分,然后通过提出的跨阶段层次结构将它们合并来实现的。我们的主要概念是通过拆分梯度流,使梯度流在不同的网络路径上传播。通过这种方式,我们证实了通过切换拼接和转换步骤,传播的梯度信息可以有很大的相关差异。此外,CSPNet可以大大减少计算量,提高推理速度和精度,如图1所示

提出的CSPNet可以应用于ResNet[7]、ResNeXt[39]、DenseNet[11]等。它不仅降低了网络的计算成本和内存占用,而且有利于提高推理速度和准确性

本文提出的基于CSPNet的目标检测器解决了以下三个问题:

1)加强CNN的学习能力:现有的CNN在轻量化后精度大大降低,所以我们希望加强CNN的学习能力,使其在轻量化的同时保持足够的精度。所提出的CSPNet可以很容易地应用于ResNet、ResNeXt和DenseNet。在上述网络上应用CSPNet后,计算量可以从10%减少到20%,但在ImageNet[2]上进行图像分类任务时,其准确率优于ResNet[7]、ResNeXt[39]、DenseNet[11]、HarDNet[1]、Elastic[36]和Res2Net[5]

2)消除计算瓶颈:过高的计算瓶颈将导致更多的周期来完成推理过程,或者一些算术单元经常会闲置。因此,我们希望能够将CNN的计算量均匀地分布在每一层,这样可以有效地提升每个计算单元的利用率,从而减少不必要的能耗。值得注意的是,提出的CSPNet使PeleeNet[37]的计算瓶颈减半。此外,在基于MS COCO[18]数据集的目标检测实验中,我们提出的模型在基于yolov3的模型上进行测试时,可以有效减少80%的计算瓶颈

3)降低内存成本:动态随机存取存储器(DRAM)的晶圆制造成本非常昂贵,并且占用大量空间。如果能有效降低内存成本,就能大大降低ASIC的成本。此外,小面积晶圆可用于各种边缘计算设备。为了减少内存的使用,我们在特征金字塔生成过程中采用了跨通道池化[6]来压缩特征映射。这样,在生成特征金字塔时,使用目标检测器的CSPNet可以减少PeleeNet 75%的内存使用

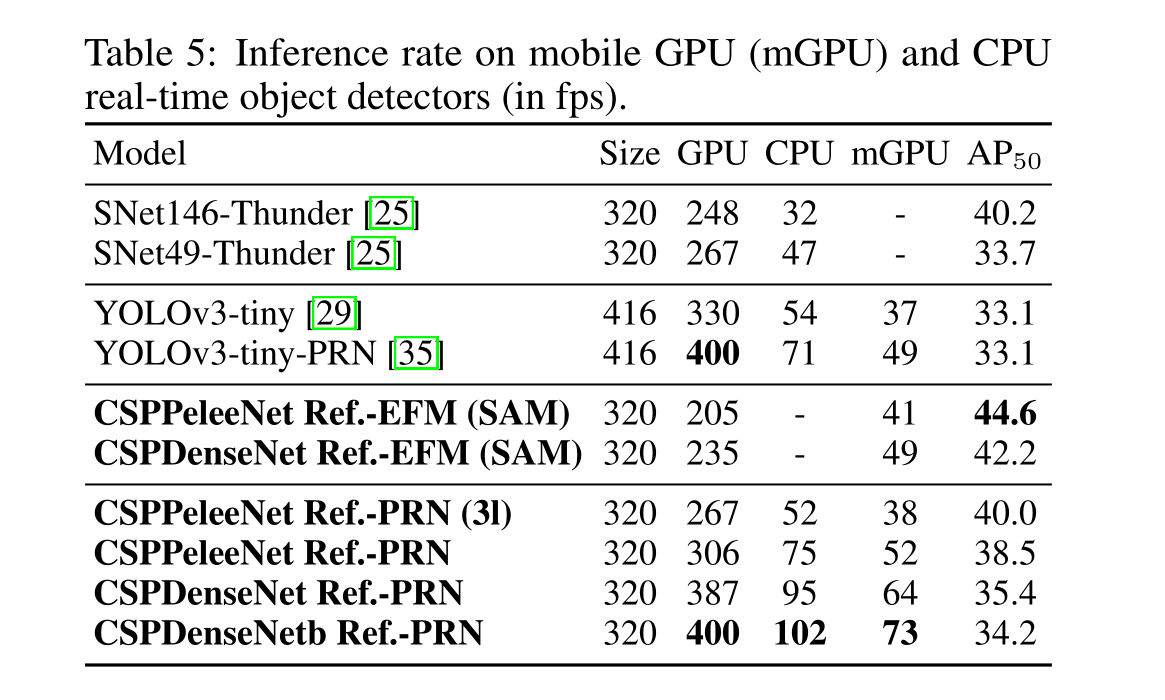

由于CSPNet能够提高CNN的学习能力,因此我们使用更小的模型来获得更好的精度。我们提出的模型可以在GTX 1080ti上以109 fps的速度实现50%的COCO AP 50。由于CSPNet可以有效地减少大量的内存流量,我们提出的方法可以在英特尔酷睿i9-9900K上以52 fps的速度实现40%的COCO AP 50。此外,由于CSPNet可以显著降低计算瓶颈和精确融合模型(EFM)可以有效降低所需的内存带宽,我们提出的方法可以在Nvidia Jetson TX2上以49 fps的速度实现42%的COCO AP 50

2 Related work

former work

CNN architectures design. :在ResNeXt[39]中,Xie等人首先证明了基数可以比宽度和深度的维度更有效。DenseNet[11]由于采用大量重用特征的策略,可以显著减少参数和计算的数量。它将前面所有层的输出特征连接起来作为下一个输入,这可以被认为是最大化基数的方法。SparseNet[46]将密集连接调整为指数间隔连接,可以有效提高参数利用率,从而获得更好的结果。Wang等人通过梯度组合的概念进一步解释了为什么高基数和稀疏连接可以提高网络的学习能力,并开发了partial ResNet (PRN)[35]。为了提高CNN的推理速度,Ma等[24]引入了四条需要遵循的准则,并设计了ShuffleNet-v2。Chao等人[1]提出了一种低内存流量CNN,称为Harmonic DenseNet (HarDNet)和一种度量卷积输入/输出(CIO),它是与实际DRAM流量测量成比例的近似DRAM流量

Real-time object detector.最著名的两种实时目标检测器是YOLOv3[29]和SSD[21]。基于SSD的LRF[38]和RFBNet[19]可以在GPU上实现最先进的实时目标检测性能。近年来,基于无锚点的目标检测器[3,45,13,14,42]已成为主流的目标检测系统。这种类型的两个对象检测器是CenterNet[45]和CornerNet-Lite[14],它们在效率和功效方面都表现得非常好。对于CPU或移动GPU上的实时目标检测,基于ssd的Pelee[37]、基于yolov3的PRN[35]和基于Light-Head RCNN[17]的ThunderNet[25]在目标检测方面都有很好的表现。

3 Method

3.1 Cross Stage Partial Network

DenseNet.

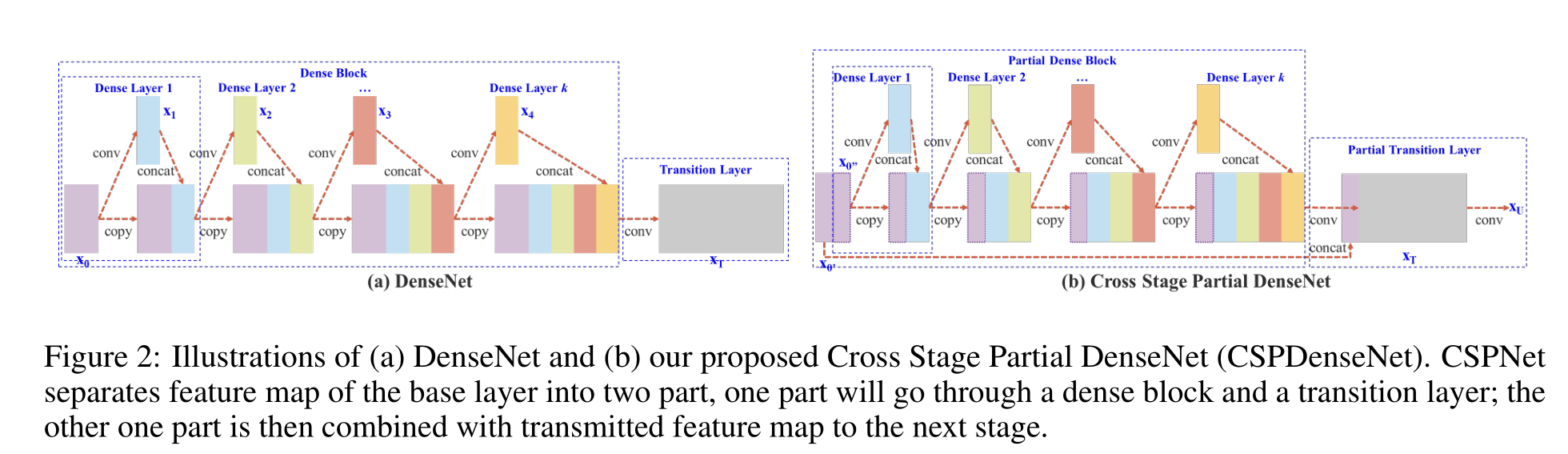

图2 (a)显示了Huang等人[11]提出的DenseNet的一级详细结构。DenseNet的每个阶段包含一个密集块和一个过渡层,每个密集块由k个密集层组成。第i个密集层的输出将与第i个密集层的输入进行连接,连接后的结果将成为第(i + 1)个密集层的输入。表示上述机理的方程可表示为:

其中*表示卷积算子,[x 0,x 1,…]表示连接x 0,x 1,…, w I和x I分别是第I层的权值和输出

如果使用反向传播算法更新权值,则权值更新方程为:

式中,f为权值更新函数,gI表示传播到第I层的梯度。我们可以发现,在更新不同密度层的权重时,大量的梯度信息被重用。这将导致不同的密集层反复学习复制的梯度信息

Cross Stage Partial DenseNet.

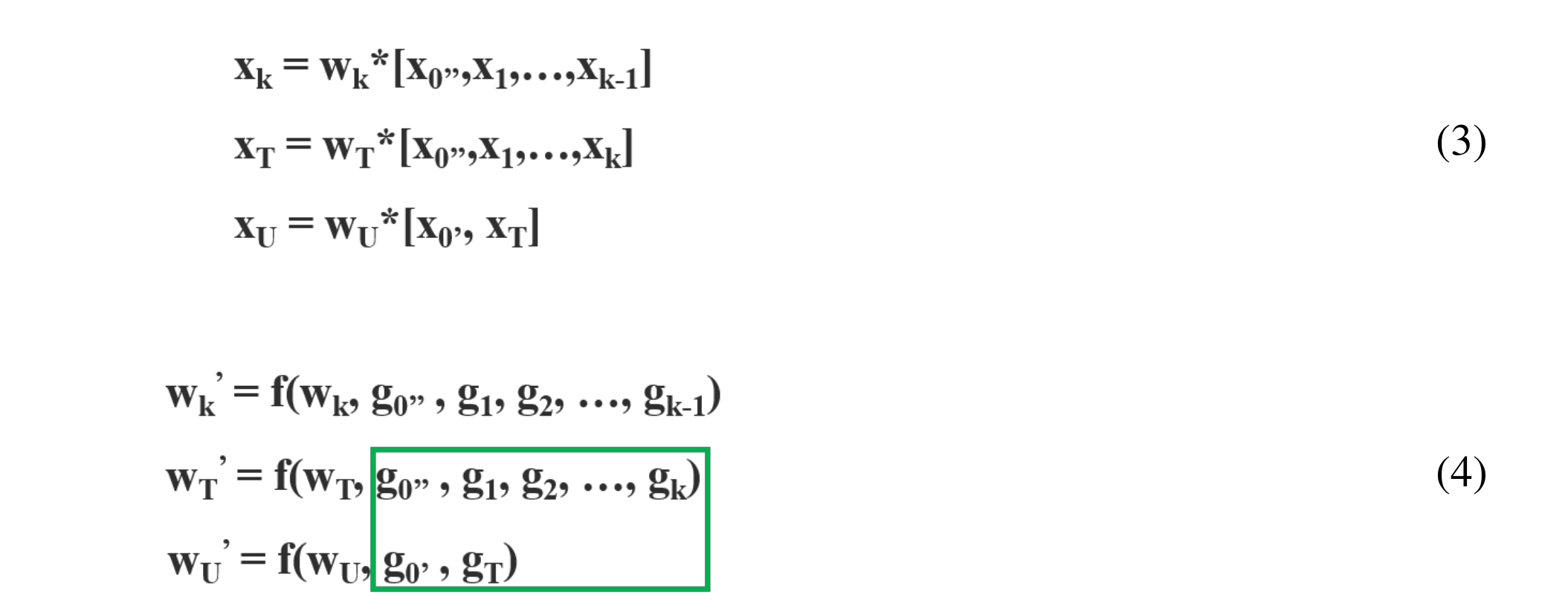

CSPDenseNet的一级架构如图2 (b)所示。CSPDenseNet的一级由部分密集块和部分过渡层组成。在部分密集块中,通过通道x 0 = [x0’,x0’']将一个阶段中底层的特征映射分成两部分。在x0’和x0‘’之间,前者直接连接到关卡的终点,而后者则会经过一个密密麻麻的街区。部分过渡层所涉及的所有步骤如下:首先,密集层的输出,[x‘’0,x 1,…,x k],将经历一个过渡层。其次,这个过渡层的输出,x T,将与x ‘’0,再经过一个过渡层,然后产生输出x U。CSPDenseNet的前馈传递和权值更新方程分别如式3和式4所示

我们可以看到,来自密集层的梯度是单独积分的。另一方面,未经过密集层的特征映射x 0′也单独积分。对于更新权值的梯度信息,两边不包含属于其他边的重复梯度信息。

总的来说,提出的CSPDenseNet保留了DenseNet的特征重用特性的优点,同时通过截断梯度流防止了过多的重复梯度信息。该思想通过设计分层特征融合策略实现,并应用于局部过渡层

Partial Dense Block.

设计部分密集块的目的是:1)增加梯度路径:通过拆分合并策略,可以使梯度路径的数量增加一倍。由于跨阶段策略,可以减轻使用显式特征映射复制进行连接所带来的缺点

2)每层的平衡计算:通常,DenseNet的基础层通道数远大于增长率。由于局部密集块中涉及密集层操作的基础层通道仅占原始数量的一半,因此可以有效解决近一半的计算瓶颈

3.)减少内存流量:假设DenseNet中一个密集块的基本特征图大小为w × h × c,增长率为d,总共有m个密集层。则该密集块的CIO为**(c × m) + ((m^2 + m) × d)/2**,部分密集块的CIO为**((c × m) + (m 2 + m) × d)/2**。m和d通常远小于c,部分密集块最多可以节省网络内存流量的一半

Partial Transition Layer.

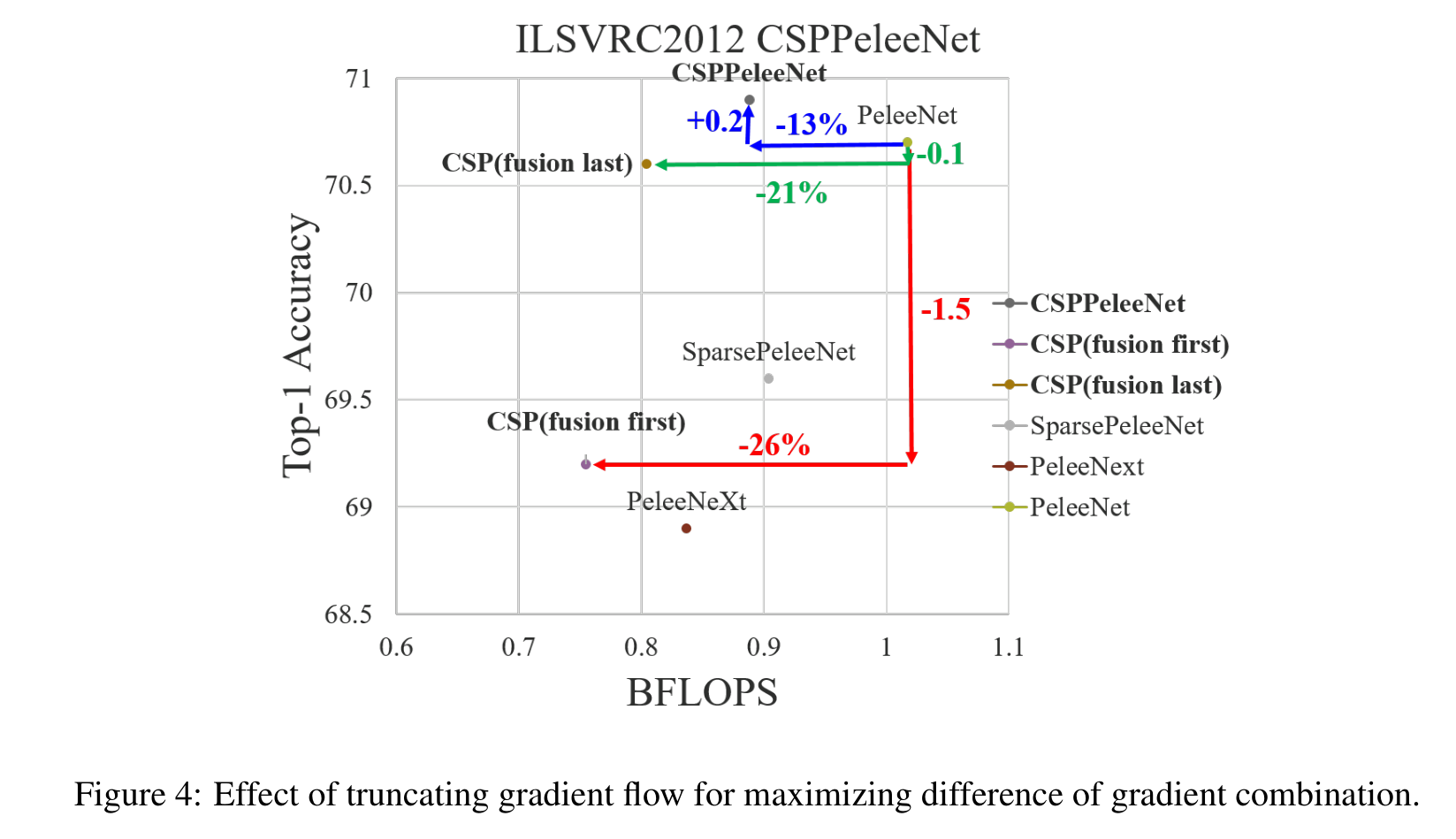

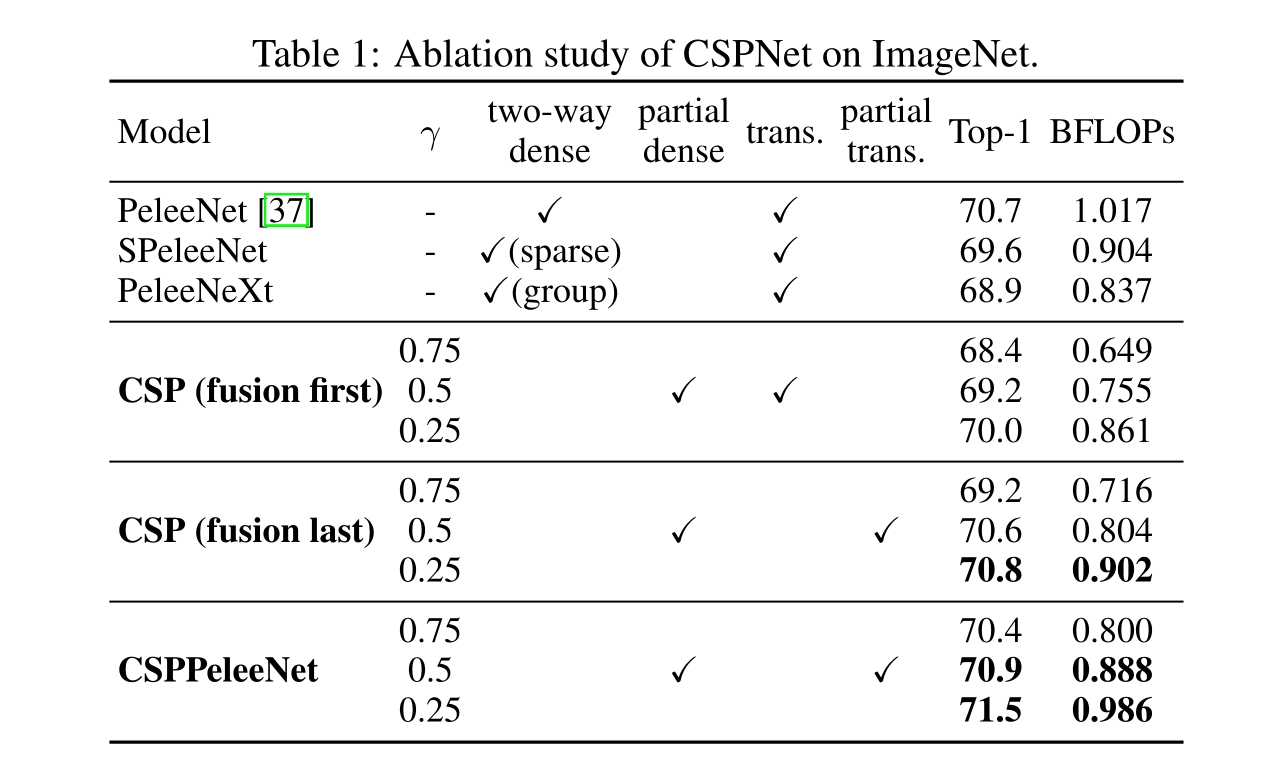

设计部分过渡层的目的是为了使梯度组合的差异最大化。部分过渡层是一种分层特征融合机制,采用截断梯度流的策略,防止不同层学习到重复的梯度信息。在这里,我们设计了CSPDenseNet的两个变体,以展示这种梯度流截断如何影响网络的学习能力。3 ?和3 (d)显示了两种不同的融合策略。CSP (fusion first)是指将两部分生成的特征图进行拼接,然后进行转换操作。如果采用这种策略,将会有大量的梯度信息被重用。对于CSP (fusion last)策略,密集块的输出将通过过渡层,然后与来自第1部分的特征映射进行拼接。如果使用CSP(最后融合)策略,梯度信息将不会被重用,因为梯度流被截断了。如果我们使用3中所示的四种架构进行图像分类,相应的结果如图4所示。可以看出,如果采用CSP (fusion last)策略进行图像分类,计算成本明显下降,但前1的准确率仅下降0.1%。另一方面,CSP(融合优先)策略确实有助于显著降低计算成本,但前1名的准确率显著下降1.5%。通过跨阶段使用拆分合并策略,可以有效地减少信息集成过程中重复的可能性。从图4的结果可以明显看出,如果能够有效地减少重复的梯度信息,网络的学习能力将会大大提高

Apply CSPNet to Other Architectures.

CSPNet也可以很容易地应用于ResNet和ResNeXt,架构如图5所示。由于只有一半的特征通道通过Res(X)块,因此不再需要引入瓶颈层。这使得当浮点操作(FLOPs)固定时,内存访问成本(MAC)的理论下限是固定的

3.2 Exact Fusion Model

Looking Exactly to predict perfectly.

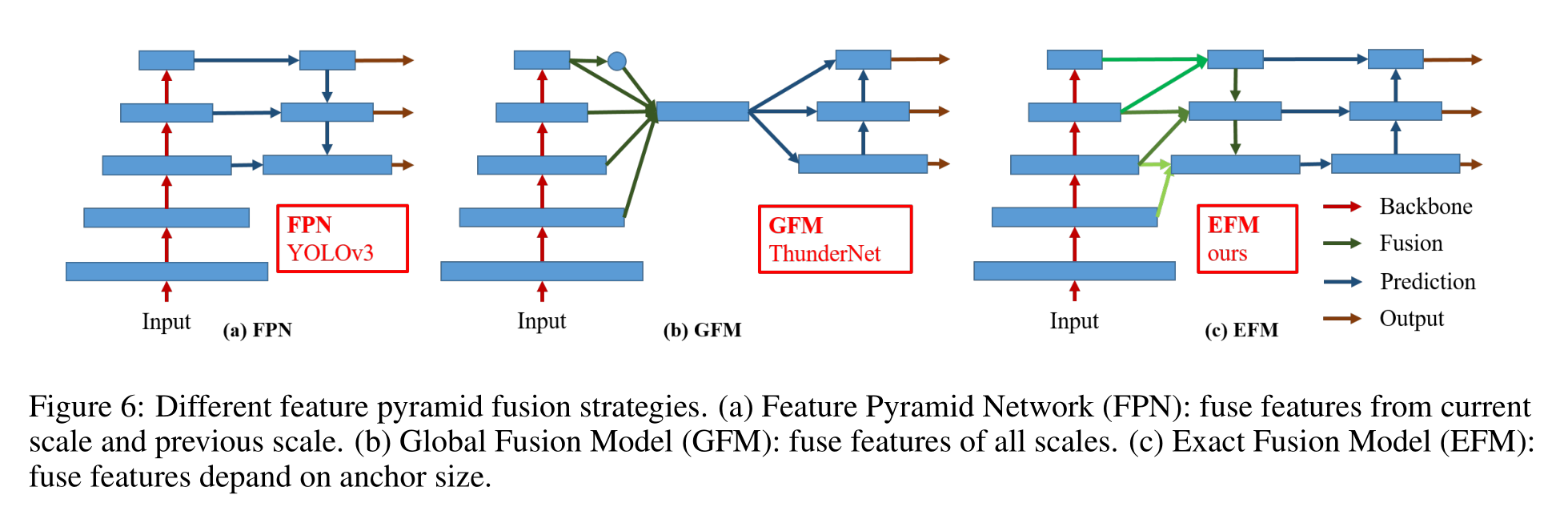

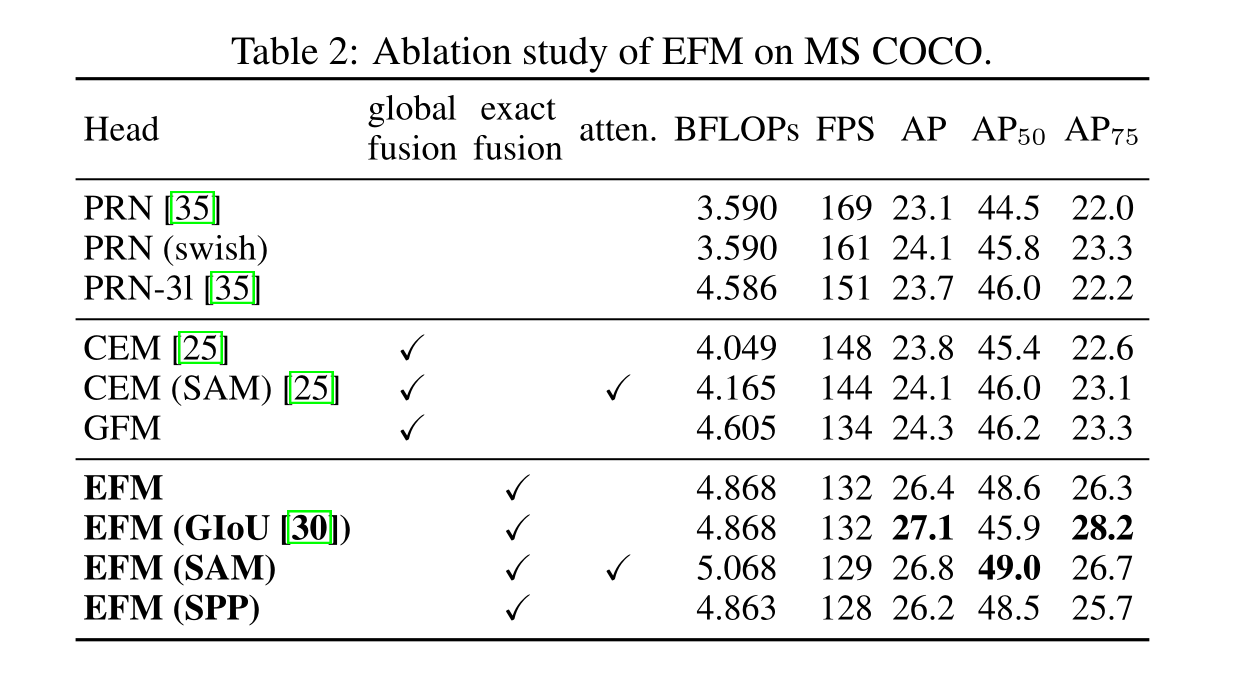

我们提出了一种捕获每个锚点适当视野(FoV)的EFM方法,提高了单级目标检测器的精度。对于分割任务,由于像素级标签通常不包含全局信息,因此为了更好地检索信息,通常更倾向于考虑更大的补丁[22]。然而,对于像图像分类和目标检测这样的任务,从图像级和边界框级标签中观察到的一些关键信息可能是模糊的。Li等人[15]发现CNN在从图像级标签中学习时经常会分心,并得出结论,这是两阶段目标检测器优于一阶段目标检测器的主要原因之一

Aggregate Feature Pyramid.

所提出的EFM能够更好地聚合初始特征金字塔。EFM基于YOLOv3[29],它在每个基础真值对象之前精确地分配了一个边界框。每个接地真相边界盒对应一个超过阈值IoU的锚定盒。如果锚框的大小等于网格单元的FoV,那么对于第s个尺度的网格单元,对应的边界框的下界是(s - 1)个尺度,上界是(s+1)个尺度。因此,EFM集合了三个尺度的特征

Balance Computation.

由于特征金字塔中连接的特征映射是巨大的,它引入了大量的内存和计算成本。为了缓解这个问题,我们引入了Maxout技术来压缩特征映射

4 Experiments

5 Conclusion

我们已经提出了CSPNet,使最先进的方法,如ResNet, ResNeXt和DenseNet是轻量级的移动gpu或cpu。其中一个主要的贡献是我们已经认识到冗余的梯度信息问题,导致低效的优化和昂贵的推理计算。我们提出利用跨阶段特征融合策略和截断梯度流来增强学习到的特征在不同层内的可变性。此外,我们提出了结合Maxout操作的EFM来压缩特征金字塔生成的特征映射,这大大降低了所需的内存带宽,从而使推理足够高效,可以与边缘计算设备兼容。实验表明,基于EFM的CSPNet在移动GPU和CPU上的实时目标检测任务的准确率和推理率显著优于竞争对手

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:veading@qq.com进行投诉反馈,一经查实,立即删除!