Hadoop安装笔记_单机/伪分布式配置_Hadoop3.1.3——备赛笔记——2024全国职业院校技能大赛“大数据应用开发”赛项——任务2:离线数据处理

?将下发的ds_db01.sql数据库文件放置mysql中

12、编写Scala代码,使用Spark将MySQL的ds_db01库中表user_info的全量数据抽取到Hive的ods库中表user_info。字段名称、类型不变,同时添加静态分区,分区字段为etl_date,类型为String,且值为当前日期的前一天日期(分区字段格式为yyyyMMdd)。使用hive cli执行show partitions ods.user_info命令,将结果截图粘贴至答案表.docx中对应的任务序号下;

13、?编写Scala代码,使用Spark将MySQL的ds_db01库中表sku_info的全量数据抽取到Hive的ods库中表sku_info。字段名称、类型不变,同时添加静态分区,分区字段为etl_date,类型为String,且值为当前日期的前一天日期(分区字段格式为yyyyMMdd)。使用hive cli执行show partitions ods.sku_info命令,将结果截图粘贴至答案表.docx中对应的任务序号下;

| 软件名称 | 版本 |

| ubuntu | 18.04 ???64 位 |

| Hadoop:hadoop-3.1.3.tar.gz | 3.1.3 |

| Jdk:jdk-8u212-linux-x64.tar.gz | 1.8 |

| Spark:spark-3.1.1-bin-hadoop3.2.tgz | 3.1.1 |

| Hive:apache-hive-3.1.2-bin.tar.gz | 3.1.2 |

| MySQL | 5.7 |

| Scala:scala-2.12.x.tgz | 2.12 |

| Vue.js | 3.2 |

| ECharts | 5.1 |

| JDBC驱动: ??mysql-connector-java-5.1.37.jar | |

| 集成开发工具:IDEA 2022 社区版 | |

这篇笔记适合于原生 Hadoop3.1.3,主要参考了官方安装教程,步骤详细,辅以适当说明,相信按照步骤来,都能顺利安装并运行Hadoop。另外有Hadoop安装配置简略版方便有基础的读者快速完成安装。此外,小北希望友友们能多去了解一些 Linux 的知识,以后出现问题时才能自行解决。

为了方便学习,请友友们利用Linux系统中自带的firefox浏览器打开本指南进行学习。

Hadoop安装文件,可以到Hadoop官网下载hadoop-3.1.3.tar.gz。

也可以直接点击这里从百度云盘下载软件(提取码:ziyu),进入百度网盘后,进入“软件”目录,找到hadoop-3.1.3.tar.gz文件下载到本地。

一、环境

本教程使用?Ubuntu 18.04 64位?作为系统环境(或者Ubuntu 14.04,Ubuntu16.04 也行,32位、64位均可),请自行安装系统(可参考小北的这篇博客~)ubuntu18.04 64 位安装笔记——备赛笔记——2024全国职业院校技能大赛“大数据应用开发”赛项——任务2:离线数据处理_failed to open image 'd:\programdata\master\ubuntu-CSDN博客![]() https://blog.csdn.net/Zhiyilang/article/details/135069233?spm=1001.2014.3001.5502装好了 Ubuntu 系统之后,在安装 Hadoop 前还需要做一些必备工作。

https://blog.csdn.net/Zhiyilang/article/details/135069233?spm=1001.2014.3001.5502装好了 Ubuntu 系统之后,在安装 Hadoop 前还需要做一些必备工作。

二、创建hadoop用户

装好了Ubuntu系统之后,在安装Hadoop前还需要做一些必备工作。

1.创建hadoop用户

如果你安装 Ubuntu 的时候不是用的 hadoop 用户,那么最好增加一个名为 hadoop 的用户,密码随意指定。首先打开终端,输入如下命令创建新用户 :

sudo useradd -m hadoop -s /bin/bash

这条命令创建了可以登陆的?hadoop?用户,并使用 /bin/bash 作为shell。

接着使用如下命令修改密码,按提示输入两次密码

完整的运行情况如下:

sudo命令: 本文中会大量使用到sudo命令。sudo是ubuntu中一种权限管理机制,管理员可以授权给一些普通用户去执行一些需要root权限执行的操作。当使用sudo命令时,就需要输入您当前用户的密码.

密码:在Linux的终端中输入密码,终端是不会显示任何你当前输入的密码,也不会提示你已经输入了多少字符密码。而在windows系统中,输入密码一般都会以“*”表示你输入的密码字符

输入法中英文切换: ubuntu中终端输入的命令一般都是使用英文输入。linux中英文的切换方式是使用键盘“shift”键来切换,也可以点击顶部菜单的输入法按钮进行切换。ubuntu自带的Sunpinyin中文输入法已经足够读者使用。

Ubuntu终端复制粘贴快捷键: 在Ubuntu终端窗口中,复制粘贴的快捷键需要加上 shift,即粘贴是 ctrl+shift+v。

接着使用如下命令设置密码,可简单设置为 hadoop,按提示输入两次密码:

sudo passwd hadoop可为 hadoop 用户增加管理员权限,方便部署,避免一些对新手来说比较棘手的权限问题:

sudo adduser hadoop sudo

最后注销当前用户(点击屏幕右上角的齿轮,选择注销),返回登陆界面。在登陆界面中选择刚创建的 hadoop 用户进行登陆。

2、遇到问题:

登录出现“Sorry, that didn‘t work. Please try again.”

3、尝试过的方法

方法1:(不可以)

$ sudo -i

密码:

# cd /etc

# chown root:shadow shadow

# chmod u=r,g=r shadow

# exit方法2:(还是不可以,逐渐暴躁)

(ssh登录)

# vim /etc/pam.d/gdm-autologi

注释行 "auth requied pam_succeed_if.so user != root quiet success"

# vim /etc/pam.d/gdm-password

注释行 "auth requied pam_succeed_if.so user != root quiet success"方法3:(可以了!天哪没想到最简单的就是解决办法!我人都傻了)

(ssh登录)

修改界面登录用户的密码

(界面登录)

输入刚改的密码,成功!nice!

三、更新apt

用 hadoop 用户登录后,我们先更新一下 apt,后续我们使用 apt 安装软件,如果没更新可能有一些软件安装不了。按 ctrl+alt+t 打开终端窗口,执行如下命令:

sudo apt-get update若出现如下 "Hash校验和不符" 的提示,可通过更改软件源来解决。若没有该问题,则不需要更改。从软件源下载某些软件的过程中,可能由于网络方面的原因出现没法下载的情况,那么建议更改软件源。在学习Hadoop过程中,即使出现“Hash校验和不符”的提示,也不会影响Hadoop的安装。

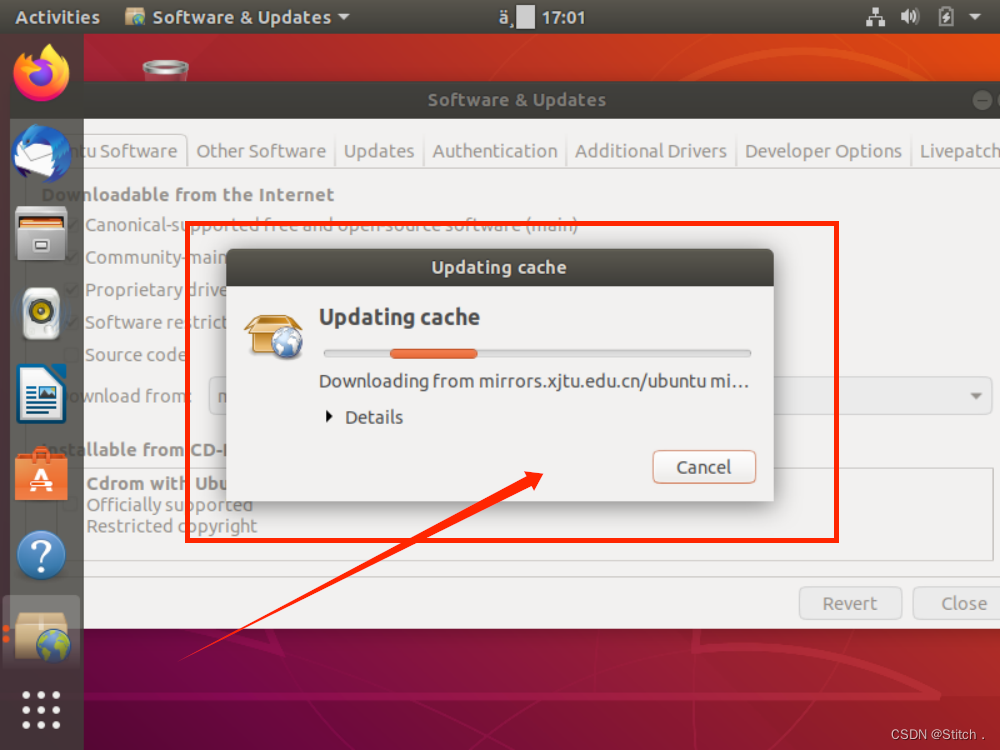

首先点击左侧任务栏的【系统设置】(齿轮图标),选择【软件和更新】

点击 “下载自” 右侧的方框,选择【其他节点】

在列表中选中【mirrors.ubuntu.com】,并点击右下角的【选择服务器】,会要求输入用户密码,输入即可。

接着点击关闭。

此时会提示列表信息过时,点击【重新载入】,

最后耐心等待更新缓存即可。更新完成会自动关闭【软件和更新】这个窗口。如果还是提示错误,请选择其他服务器节点如 mirrors.163.com 再次进行尝试。更新成功后,再次执行?sudo apt-get update?就正常了。

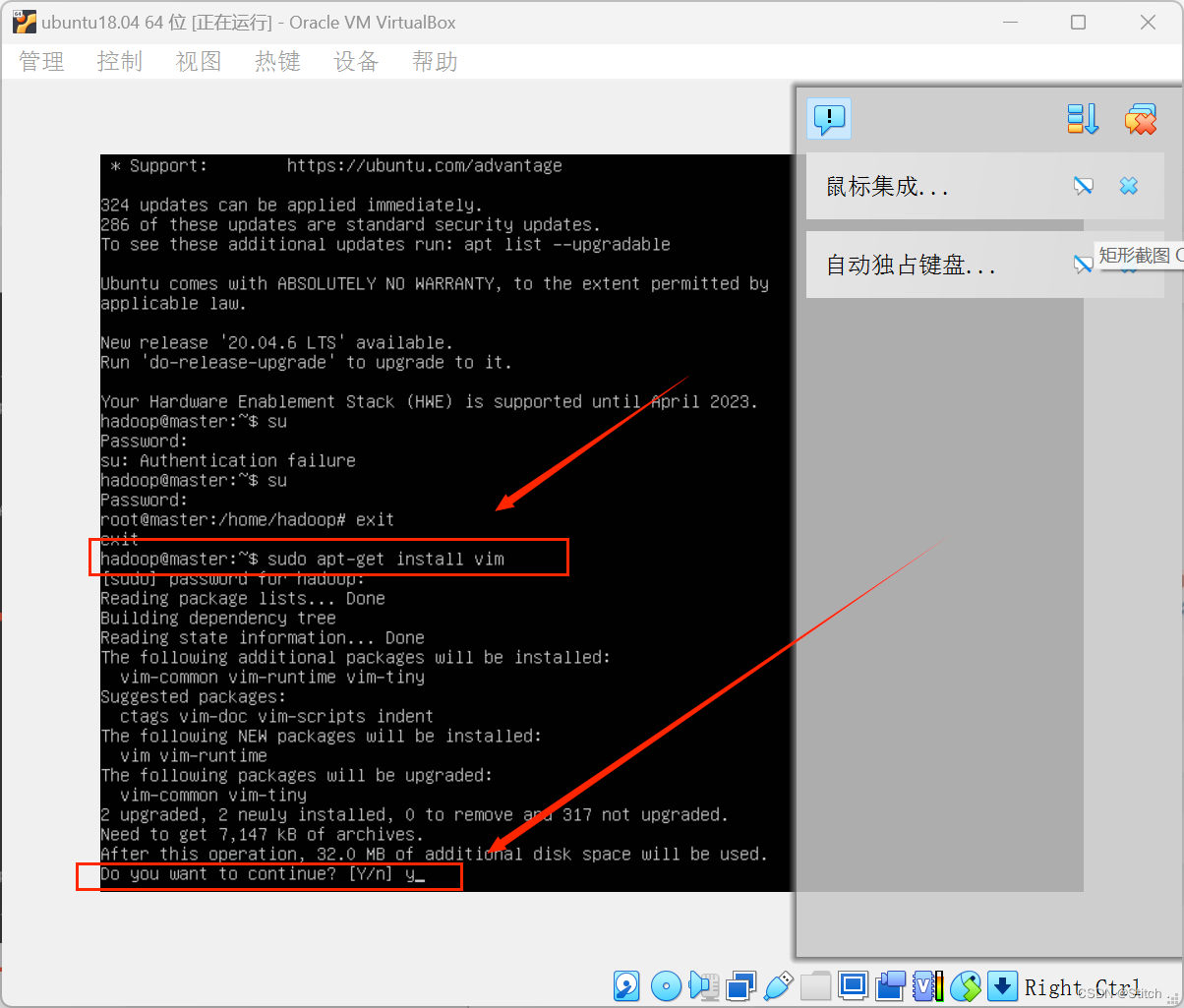

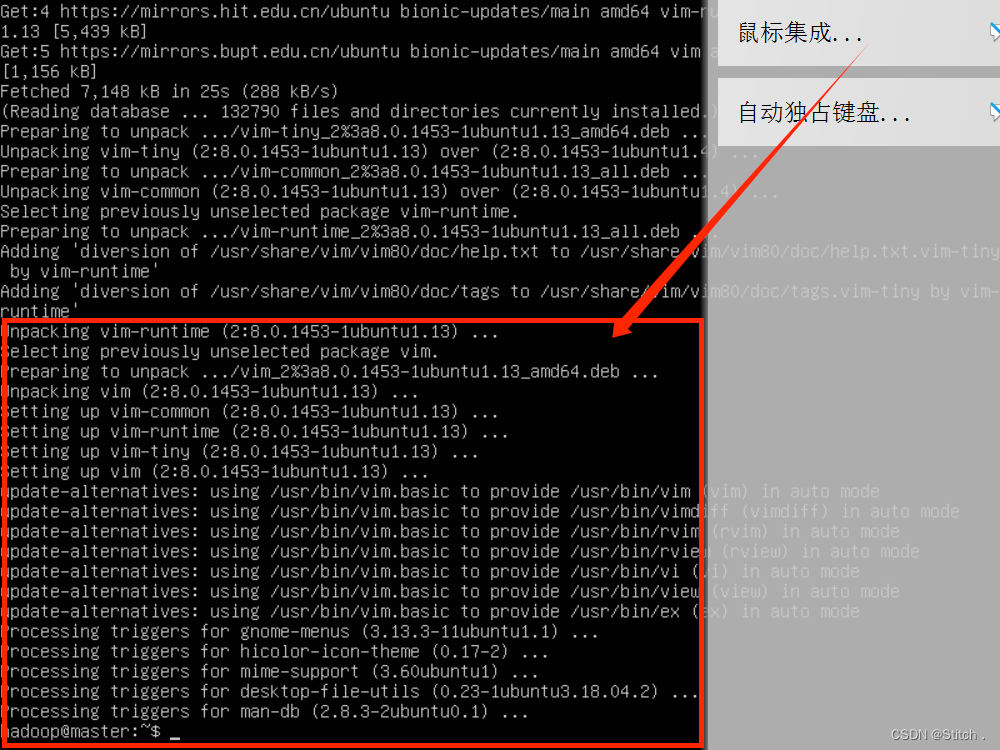

后续需要更改一些配置文件,我比较喜欢用的是 vim(vi增强版,基本用法相同),建议安装一下(如果你实在还不会用 vi/vim 的,请将后面用到 vim 的地方改为 gedit,这样可以使用文本编辑器进行修改,并且每次文件更改完成后请关闭整个 gedit 程序,否则会占用终端):

sudo apt-get install vim安装软件时若需要确认,在提示处输入 y 即可。

vim的常用模式有分为命令模式,插入模式,可视模式,正常模式。本教程中,只需要用到正常模式和插入模式。二者间的切换即可以帮助你完成本指南的学习。

- 正常模式

正常模式主要用来浏览文本内容。一开始打开vim都是正常模式。在任何模式下按下Esc键就可以返回正常模式 - 插入编辑模式

插入编辑模式则用来向文本中添加内容的。在正常模式下,输入i键即可进入插入编辑模式 - 退出vim

如果有利用vim修改任何的文本,一定要记得保存。Esc键退回到正常模式中,然后输入:wq即可保存文本并退出vim

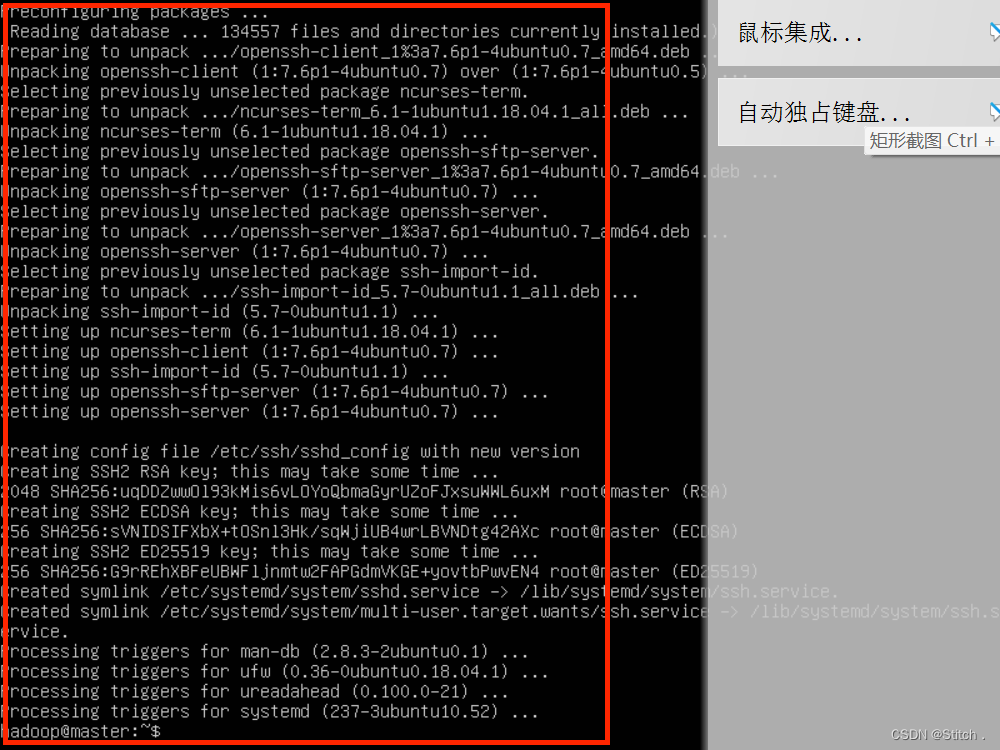

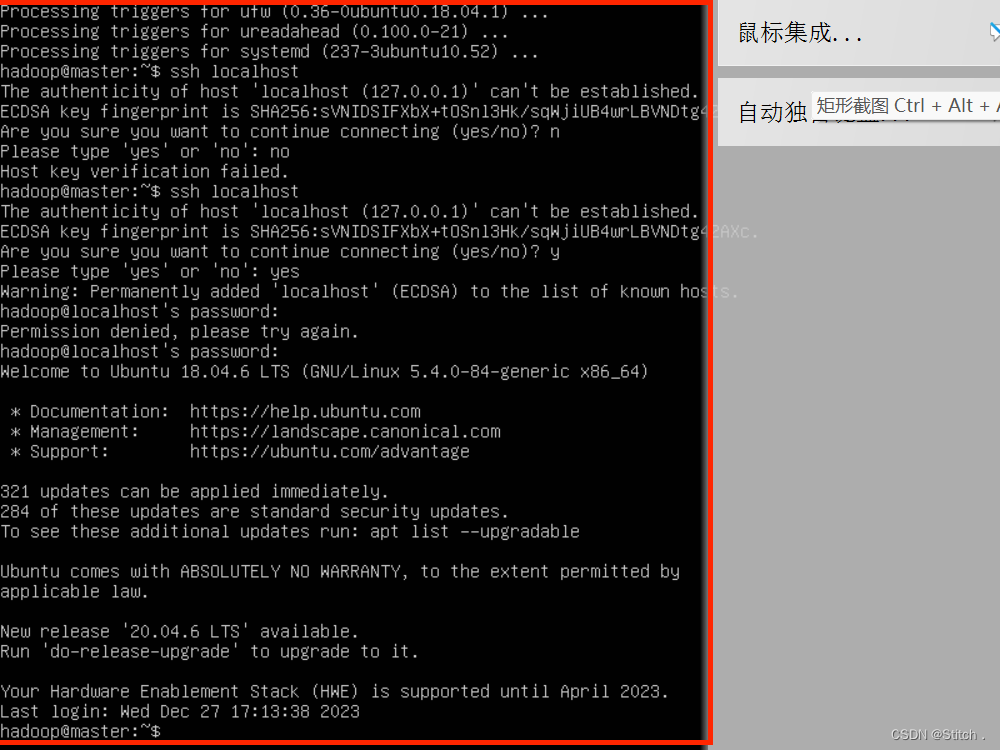

四、安装SSH、配置SSH无密码登陆

集群、单节点模式都需要用到 SSH 登陆(类似于远程登陆,你可以登录某台 Linux 主机,并且在上面运行命令),Ubuntu 默认已安装了 SSH client,此外还需要安装 SSH server:

sudo apt-get install openssh-server

安装后,可以使用如下命令登陆本机:

ssh localhost此时会有如下提示(SSH首次登陆提示),输入 yes 。然后按提示输入密码 hadoop,这样就登陆到本机了。

但这样登陆是需要每次输入密码的,我们需要配置成SSH无密码登陆比较方便。

首先退出刚才的 ssh,就回到了我们原先的终端窗口,然后利用 ssh-keygen 生成密钥,并将密钥加入到授权中:

exit # 退出刚才的 ssh localhost

cd ~/.ssh/ # 若没有该目录,请先执行一次ssh localhost

ssh-keygen -t rsa # 会有提示,都按回车就可以

cat ./id_rsa.pub >> ./authorized_keys # 加入授权

~的含义: 在 Linux 系统中,~ 代表的是用户的主文件夹,即 "/home/用户名" 这个目录,如你的用户名为 hadoop,则 ~ 就代表 "/home/hadoop/"。 此外,命令中的 # 后面的文字是注释,只需要输入前面命令即可。

此时再用?ssh localhost?命令,无需输入密码就可以直接登陆了,如下图所示。

五、安装Java环境

手动安装,推荐采用本方式

Hadoop3.1.3需要JDK版本在1.8及以上。需要按照下面步骤来自己手动安装JDK1.8。

把JDK1.8的安装包jdk-8u212-linux-x64.tar.gz,

下载到本地电脑,从宿主机/opt目录下将文件hadoop-3.1.3.tar.gz、jdk-8u212-linux-x64.tar.gz复制到容器Master中的/opt/software路径中(若路径不存在,则需新建),将Master节点JDK安装包解压到/opt/module路径中(若路径不存在,则需新建)目录下。

开发软件:Oracle VM VitrualBox

Oracle?VM VirtualBox虚拟机与实体机文件的互传,是不能复制粘贴的。此时实体机与虚拟机里面的文件如何实现相互传输呢?下面是小北收集整理的OracleVirtualBox虚拟机如何实现文件夹共享,希望对大家有帮助~

OracleVirtualBox虚拟机如何实现文件夹共享

工具/原料

运行正常的Oracle VM VirtualBox虚拟机

运行正常的实体机(电脑)

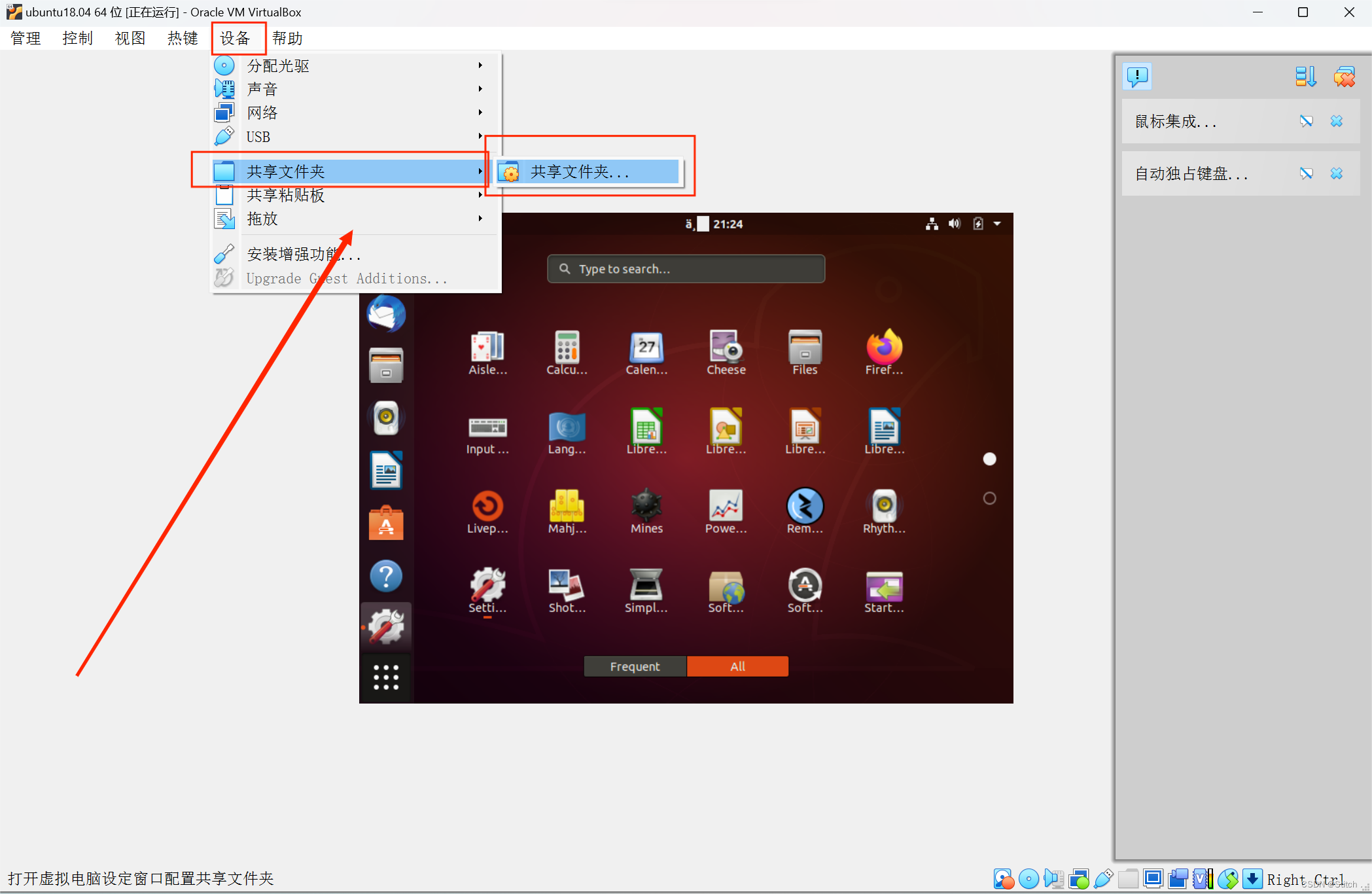

方法/步骤1

1、首先在自己的实体机(电脑)上的磁盘上新建一个文件夹,例如在G盘新建“虚拟机共享文件夹”--------------------------------------------“Oracle VM VirtualBox”

2、打开Oracle VM VirtualBox虚拟机 ,点击“启动”,打开虚拟机

3、安装虚拟机的“安装增强功能”,安装完成之后。就开始在实体机和虚拟机之间建立文件的共享了。安装增强功能后,需要重启虚拟机。(小北之前的博客有具体操作详解)

方法/步骤2

1、在虚拟机中分配指定共享文件夹,点击菜单栏上的设备,选择共享文件夹

2、在弹出“设置”窗口中,点击左边共享文件夹页签,点击右边添加文件夹的按钮,在弹出的“添加共享文件”窗口中,添加共享文件夹路径,找到实体机新建的虚拟机共享文件夹,然后把固定分配,打钩,点击确定。然后就可以看到设置界面的设置情况。点击确定。

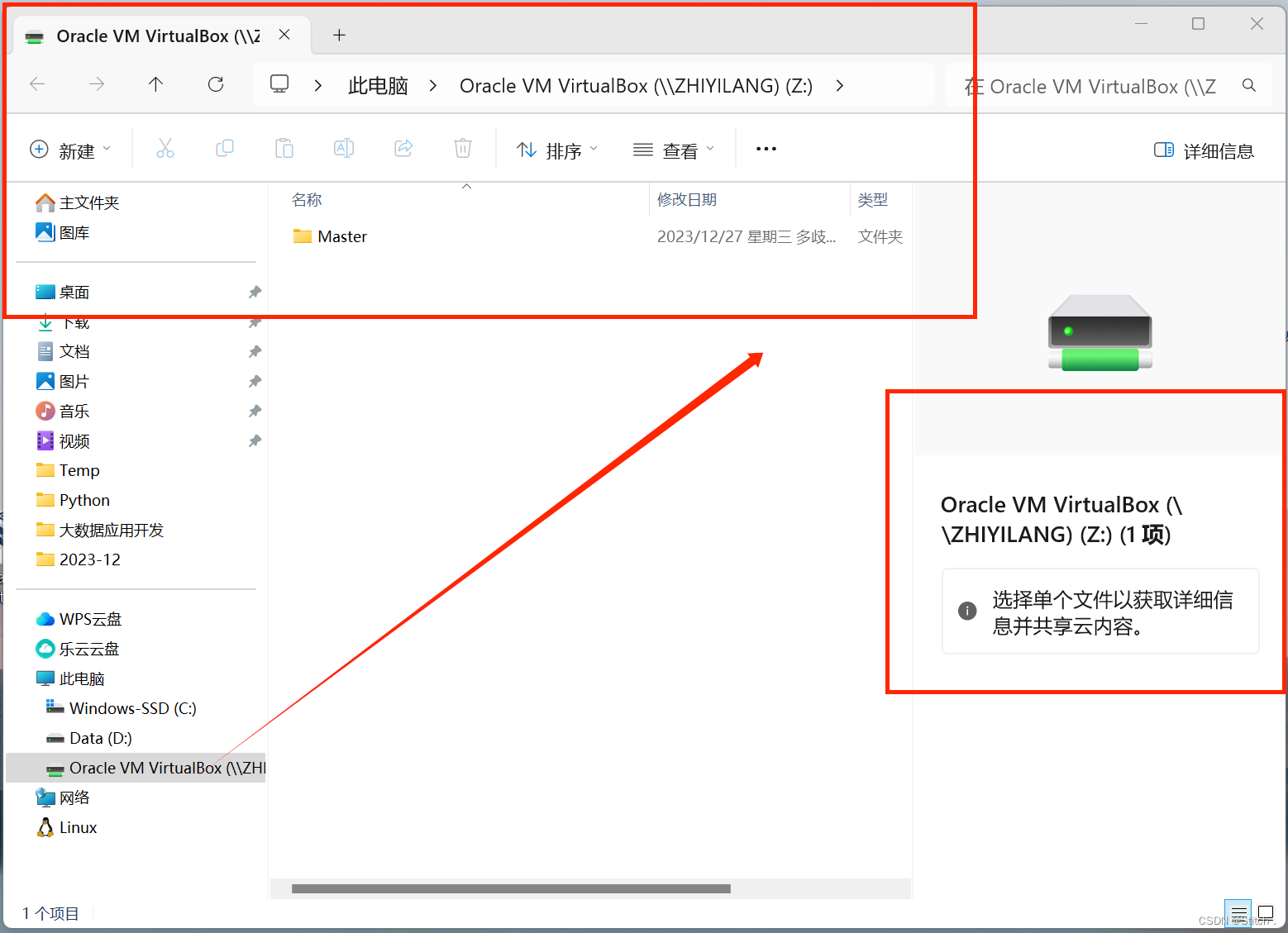

方法/步骤3

1、映射网络驱动器。共享文件夹添加成功后,就是映射网络驱动器了。选中我的电脑,右键,选择映射网络驱动器:

2、选择驱动器号,然后点击文件夹的浏览,在弹出的浏览文件窗口中,选择 我们的共享文件Oracle?VM VirtualBox ,选择新建的虚拟机及共享文件夹,点击确定。然后点击完成。(先去Oracle?VM VirtualBox 文件属性里共享一下)

3、此时,实体机和虚拟机之间的共享文件夹就做好了,打开我的电脑,就可以看到磁盘下面有一个新建的网络驱动器。双击打开,就可在在这个文件夹里面共享文件了!

没有安装"rpm",代码如下:

sudo apt-get install rpm

1. 检测虚拟机是否存在JDK

rpm -qa | grep -i java

(没有显示其他版本的jdk,表示不用输入下一段代码,不然会宕机,需要重新进入,很难退出)

如果存在使用该命令卸载

xargs?-n1 sudo rpm -e --nodeps2. 上传安装包

之前提过在虚拟机的opt目录下建两个文件夹分别是software和module

这里用的jdk是?jdk-8u212-linux-x64.tar.gz

平时我们都是在windows下安装jdk,都比较简单,今天我们在linux系统下来安装下jdk8,首先需要下载jdk8,下载链接:jdk-8u212-linux-x64.tar.gz_免费高速下载|百度网盘-分享无限制 (baidu.com)![]() https://pan.baidu.com/s/1Lb-k1D1_h3YDZrP_d-L2Pg提取码:0706

https://pan.baidu.com/s/1Lb-k1D1_h3YDZrP_d-L2Pg提取码:0706

复制这段内容后打开百度网盘,操作更方便哦~

将压缩包上传到/opt/software文件夹下面

?

?

将安装包解压到 /opt/module

在Linux命令行界面中,执行如下Shell命令(注意:当前登录用户名是hadoop):

cd /opt/software

sudo mkdir jvm #创建/opt/software/jvm目录用来存放JDK文件

cd ~ #进入hadoop用户的主目录

cd Downloads #注意区分大小写字母,刚才已经通过FTP软件把JDK安装包jdk-8u162-linux-x64.tar.gz上传到该目录下

sudo tar -zxvf ./jdk-8u162-linux-x64.tar.gz -C /usr/lib/jvm #把JDK文件解压到/usr/lib/jvm目录下

Shell 命令

上面使用了解压缩命令tar,如果对Linux命令不熟悉,可以参考常用的Linux命令用法。

JDK文件解压缩以后,可以执行如下命令到/usr/lib/jvm目录查看一下:

cd /usr/lib/jvm

lsShell 命令

可以看到,在/usr/lib/jvm目录下有个jdk1.8.0_162目录。

下面继续执行如下命令,设置环境变量:

cd ~

vim ~/.bashrcShell 命令

上面命令使用vim编辑器(查看vim编辑器使用方法)打开了hadoop这个用户的环境变量配置文件,请在这个文件的开头位置,添加如下几行内容:

export JAVA_HOME=/usr/lib/jvm/jdk1.8.0_162

export JRE_HOME=${JAVA_HOME}/jre

export CLASSPATH=.:${JAVA_HOME}/lib:${JRE_HOME}/lib

export PATH=${JAVA_HOME}/bin:$PATH

保存.bashrc文件并退出vim编辑器。然后,继续执行如下命令让.bashrc文件的配置立即生效:

source ~/.bashrcShell 命令

这时,可以使用如下命令查看是否安装成功:

java -versionShell 命令

如果能够在屏幕上返回如下信息,则说明安装成功:

hadoop@ubuntu:~$ java -version

java version "1.8.0_162"

Java(TM) SE Runtime Environment (build 1.8.0_162-b12)

Java HotSpot(TM) 64-Bit Server VM (build 25.162-b12, mixed mode)

至此,就成功安装了Java环境。下面就可以进入Hadoop的安装。

安装 Hadoop3.1.3

Hadoop安装文件,可以到Hadoop官网下载hadoop-3.1.3.tar.gz。

也可以直接点击这里从百度云盘下载软件(提取码:lnwl),进入百度网盘后,进入“软件”目录,找到hadoop-3.1.3.tar.gz文件,下载到本地。

我们选择将 Hadoop 安装至 /usr/local/ 中:

sudo tar -zxf ~/下载/hadoop-3.1.3.tar.gz -C /usr/local # 解压到/usr/local中

cd /usr/local/

sudo mv ./hadoop-3.1.3/ ./hadoop # 将文件夹名改为hadoop

sudo chown -R hadoop ./hadoop # 修改文件权限Shell 命令

Hadoop 解压后即可使用。输入如下命令来检查 Hadoop 是否可用,成功则会显示 Hadoop 版本信息:

cd /usr/local/hadoop

./bin/hadoop versionShell 命令

相对路径与绝对路径: 请务必注意命令中的相对路径与绝对路径,本文后续出现的?./bin/...,./etc/...?等包含 ./ 的路径,均为相对路径,以 /usr/local/hadoop 为当前目录。例如在 /usr/local/hadoop 目录中执行?./bin/hadoop version?等同于执行?/usr/local/hadoop/bin/hadoop version。可以将相对路径改成绝对路径来执行,但如果你是在主文件夹 ~ 中执行?./bin/hadoop version,执行的会是?/home/hadoop/bin/hadoop version,就不是我们所想要的了。

Hadoop单机配置(非分布式)

Hadoop 默认模式为非分布式模式(本地模式),无需进行其他配置即可运行。非分布式即单 Java 进程,方便进行调试。

现在我们可以执行例子来感受下 Hadoop 的运行。Hadoop 附带了丰富的例子(运行?./bin/hadoop jar ./share/hadoop/mapreduce/hadoop-mapreduce-examples-3.1.3.jar?可以看到所有例子),包括 wordcount、terasort、join、grep 等。

在此我们选择运行 grep 例子,我们将 input 文件夹中的所有文件作为输入,筛选当中符合正则表达式 dfs[a-z.]+ 的单词并统计出现的次数,最后输出结果到 output 文件夹中。

cd /usr/local/hadoop

mkdir ./input

cp ./etc/hadoop/*.xml ./input # 将配置文件作为输入文件

./bin/hadoop jar ./share/hadoop/mapreduce/hadoop-mapreduce-examples-3.1.3.jar grep ./input ./output 'dfs[a-z.]+'

cat ./output/* # 查看运行结果Shell 命令

执行成功后如下所示,输出了作业的相关信息,输出的结果是符合正则的单词 dfsadmin 出现了1次

?

?

注意,Hadoop 默认不会覆盖结果文件,因此再次运行上面实例会提示出错,需要先将?./output?删除。

rm -r ./outputShell 命令

Hadoop伪分布式配置

Hadoop 可以在单节点上以伪分布式的方式运行,Hadoop 进程以分离的 Java 进程来运行,节点既作为 NameNode 也作为 DataNode,同时,读取的是 HDFS 中的文件。

Hadoop 的配置文件位于 /usr/local/hadoop/etc/hadoop/ 中,伪分布式需要修改2个配置文件?core-site.xml?和?hdfs-site.xml?。Hadoop的配置文件是 xml 格式,每个配置以声明 property 的 name 和 value 的方式来实现。

修改配置文件?core-site.xml?(通过 gedit 编辑会比较方便:?gedit ./etc/hadoop/core-site.xml),将当中的

<configuration>

</configuration>XML

修改为下面配置:

<configuration>

<property>

<name>hadoop.tmp.dir</name>

<value>file:/usr/local/hadoop/tmp</value>

<description>Abase for other temporary directories.</description>

</property>

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

</configuration>XML

同样的,修改配置文件?hdfs-site.xml:

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/usr/local/hadoop/tmp/dfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/usr/local/hadoop/tmp/dfs/data</value>

</property>

</configuration>XML

Hadoop配置文件说明:

Hadoop 的运行方式是由配置文件决定的(运行 Hadoop 时会读取配置文件),因此如果需要从伪分布式模式切换回非分布式模式,需要删除 core-site.xml 中的配置项。

此外,伪分布式虽然只需要配置 fs.defaultFS 和 dfs.replication 就可以运行(官方教程如此),不过若没有配置 hadoop.tmp.dir 参数,则默认使用的临时目录为 /tmp/hadoo-hadoop,而这个目录在重启时有可能被系统清理掉,导致必须重新执行 format 才行。所以我们进行了设置,同时也指定 dfs.namenode.name.dir 和 dfs.datanode.data.dir,否则在接下来的步骤中可能会出错。

配置完成后,执行 NameNode 的格式化:

cd /usr/local/hadoop

./bin/hdfs namenode -formatShell 命令

成功的话,会看到 "successfully formatted" 的提示,具体返回信息类似如下:

2020-01-08 15:31:31,560 INFO namenode.NameNode: STARTUP_MSG:

/************************************************************

STARTUP_MSG: Starting NameNode

STARTUP_MSG: host = hadoop/127.0.1.1

STARTUP_MSG: args = [-format]

STARTUP_MSG: version = 3.1.3

*************************************************************/

......

2020-01-08 15:31:35,677 INFO common.Storage: Storage directory /usr/local/hadoop/tmp/dfs/name **has been successfully formatted**.

2020-01-08 15:31:35,700 INFO namenode.FSImageFormatProtobuf: Saving image file /usr/local/hadoop/tmp/dfs/name/current/fsimage.ckpt_0000000000000000000 using no compression

2020-01-08 15:31:35,770 INFO namenode.FSImageFormatProtobuf: Image file /usr/local/hadoop/tmp/dfs/name/current/fsimage.ckpt_0000000000000000000 of size 393 bytes saved in 0 seconds .

2020-01-08 15:31:35,810 INFO namenode.NNStorageRetentionManager: Going to retain 1 images with txid >= 0

2020-01-08 15:31:35,816 INFO namenode.FSImage: FSImageSaver clean checkpoint: txid = 0 when meet shutdown.

2020-01-08 15:31:35,816 INFO namenode.NameNode: SHUTDOWN_MSG:

/************************************************************

SHUTDOWN_MSG: Shutting down NameNode at hadoop/127.0.1.1

*************************************************************/

如果在这一步时提示?Error: JAVA_HOME is not set and could not be found.?的错误,则说明之前设置 JAVA_HOME 环境变量那边就没设置好,请按教程先设置好 JAVA_HOME 变量,否则后面的过程都是进行不下去的。如果已经按照前面教程在.bashrc文件中设置了JAVA_HOME,还是出现?Error: JAVA_HOME is not set and could not be found.?的错误,那么,请到hadoop的安装目录修改配置文件“/usr/local/hadoop/etc/hadoop/hadoop-env.sh”,在里面找到“export JAVA_HOME=${JAVA_HOME}”这行,然后,把它修改成JAVA安装路径的具体地址,比如,“export JAVA_HOME=/usr/lib/jvm/default-java”,然后,再次启动Hadoop。

接着开启 NameNode 和 DataNode 守护进程。

cd /usr/local/hadoop

./sbin/start-dfs.sh #start-dfs.sh是个完整的可执行文件,中间没有空格Shell 命令

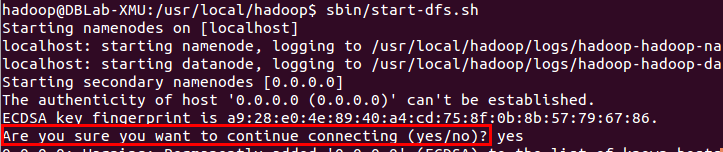

若出现如下SSH提示,输入yes即可。

?

?

启动时可能会出现如下 WARN 提示:WARN util.NativeCodeLoader: Unable to load native-hadoop library for your platform... using builtin-java classes where applicable WARN 提示可以忽略,并不会影响正常使用。

启动 Hadoop 时提示 Could not resolve hostname:

如果启动 Hadoop 时遇到输出非常多“ssh: Could not resolve hostname xxx”的异常情况,如下图所示:

?

?

这个并不是 ssh 的问题,可通过设置 Hadoop 环境变量来解决。首先按键盘的?ctrl + c?中断启动,然后在 ~/.bashrc 中,增加如下两行内容(设置过程与 JAVA_HOME 变量一样,其中 HADOOP_HOME 为 Hadoop 的安装目录):

export HADOOP_HOME=/usr/local/hadoop

export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/nativeShell

保存后,务必执行?source ~/.bashrc?使变量设置生效,然后再次执行?./sbin/start-dfs.sh?启动 Hadoop。

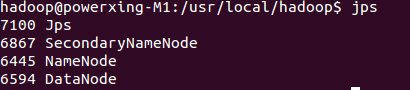

启动完成后,可以通过命令?jps?来判断是否成功启动,若成功启动则会列出如下进程: "NameNode"、"DataNode" 和 "SecondaryNameNode"(如果 SecondaryNameNode 没有启动,请运行 sbin/stop-dfs.sh 关闭进程,然后再次尝试启动尝试)。如果没有 NameNode 或 DataNode ,那就是配置不成功,请仔细检查之前步骤,或通过查看启动日志排查原因。

?

?

Hadoop无法正常启动的解决方法: 一般可以查看启动日志来排查原因,注意几点:

- 启动时会提示形如 "DBLab-XMU: starting namenode, logging to /usr/local/hadoop/logs/hadoop-hadoop-namenode-DBLab-XMU.out",其中 DBLab-XMU 对应你的机器名,但其实启动日志信息是记录在 /usr/local/hadoop/logs/hadoop-hadoop-namenode-DBLab-XMU.log 中,所以应该查看这个后缀为?.log?的文件;

- 每一次的启动日志都是追加在日志文件之后,所以得拉到最后面看,对比下记录的时间就知道了。

- 一般出错的提示在最后面,通常是写着 Fatal、Error、Warning 或者 Java Exception 的地方。

- 可以在网上搜索一下出错信息,看能否找到一些相关的解决方法。

此外,若是 DataNode 没有启动,可尝试如下的方法(注意这会删除 HDFS 中原有的所有数据,如果原有的数据很重要请不要这样做):

# 针对 DataNode 没法启动的解决方法

cd /usr/local/hadoop

./sbin/stop-dfs.sh # 关闭

rm -r ./tmp # 删除 tmp 文件,注意这会删除 HDFS 中原有的所有数据

./bin/hdfs namenode -format # 重新格式化 NameNode

./sbin/start-dfs.sh # 重启Shell 命令

成功启动后,可以访问 Web 界面?http://localhost:9870?查看 NameNode 和 Datanode 信息,还可以在线查看 HDFS 中的文件。

运行Hadoop伪分布式实例

上面的单机模式,grep 例子读取的是本地数据,伪分布式读取的则是 HDFS 上的数据。要使用 HDFS,首先需要在 HDFS 中创建用户目录:

./bin/hdfs dfs -mkdir -p /user/hadoopShell 命令

注意: 教材《大数据技术原理与应用》的命令是以"./bin/hadoop dfs"开头的Shell命令方式,实际上有三种shell命令方式。

1. hadoop fs

2. hadoop dfs

3. hdfs dfs

hadoop fs适用于任何不同的文件系统,比如本地文件系统和HDFS文件系统

hadoop dfs只能适用于HDFS文件系统

hdfs dfs跟hadoop dfs的命令作用一样,也只能适用于HDFS文件系统

接着将 ./etc/hadoop 中的 xml 文件作为输入文件复制到分布式文件系统中,即将 /usr/local/hadoop/etc/hadoop 复制到分布式文件系统中的 /user/hadoop/input 中。我们使用的是 hadoop 用户,并且已创建相应的用户目录 /user/hadoop ,因此在命令中就可以使用相对路径如 input,其对应的绝对路径就是 /user/hadoop/input:

./bin/hdfs dfs -mkdir input

./bin/hdfs dfs -put ./etc/hadoop/*.xml inputShell 命令

复制完成后,可以通过如下命令查看文件列表:

./bin/hdfs dfs -ls inputShell 命令

伪分布式运行 MapReduce 作业的方式跟单机模式相同,区别在于伪分布式读取的是HDFS中的文件(可以将单机步骤中创建的本地 input 文件夹,输出结果 output 文件夹都删掉来验证这一点)。

./bin/hadoop jar ./share/hadoop/mapreduce/hadoop-mapreduce-examples-3.1.3.jar grep input output 'dfs[a-z.]+'Shell 命令

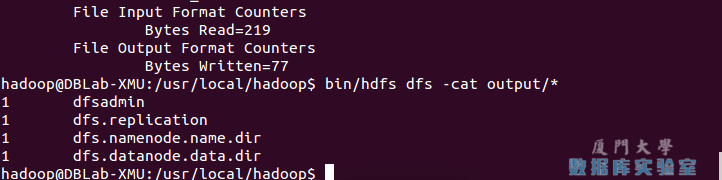

查看运行结果的命令(查看的是位于 HDFS 中的输出结果):

./bin/hdfs dfs -cat output/*Shell 命令

结果如下,注意到刚才我们已经更改了配置文件,所以运行结果不同。

?

?

我们也可以将运行结果取回到本地:

rm -r ./output # 先删除本地的 output 文件夹(如果存在)

./bin/hdfs dfs -get output ./output # 将 HDFS 上的 output 文件夹拷贝到本机

cat ./output/*Shell 命令

Hadoop 运行程序时,输出目录不能存在,否则会提示错误 "org.apache.hadoop.mapred.FileAlreadyExistsException: Output directory hdfs://localhost:9000/user/hadoop/output already exists" ,因此若要再次执行,需要执行如下命令删除 output 文件夹:

./bin/hdfs dfs -rm -r output # 删除 output 文件夹Shell 命令

运行程序时,输出目录不能存在: 运行 Hadoop 程序时,为了防止覆盖结果,程序指定的输出目录(如 output)不能存在,否则会提示错误,因此运行前需要先删除输出目录。在实际开发应用程序时,可考虑在程序中加上如下代码,能在每次运行时自动删除输出目录,避免繁琐的命令行操作:

Configuration conf = new Configuration();

Job job = new Job(conf);

/* 删除输出目录 */

Path outputPath = new Path(args[1]);

outputPath.getFileSystem(conf).delete(outputPath, true);Java

若要关闭 Hadoop,则运行

./sbin/stop-dfs.shShell 命令

注意: 下次启动 hadoop 时,无需进行 NameNode 的初始化,只需要运行?./sbin/start-dfs.sh?就可以!

安装Hadoop集群

在平时的学习中,我们使用伪分布式就足够了。如果需要安装 Hadoop 集群,请查看Hadoop集群安装配置教程(Hadoop3.1.3)。

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:veading@qq.com进行投诉反馈,一经查实,立即删除!