黄仁勋打造「核弹工厂」/ 大模型背后的决胜关键 / ChatGPT“幻觉”是否会褪去 | 魔法半周报

我有魔法?为你劈开信息大海?

高效获取AIGC的热门事件🔥,更新AIGC的最新动态,生成相应的魔法简报,节省阅读时间👻

🔥资讯预览

-

黄仁勋打造「核弹工厂」,让人人拥有创造力的 AI

-

大模型背后的决胜关键:价值观、资金双重挑战

-

快手TWIN:挖掘历史兴趣,入选KDD 2023

-

斯坦福研发强劲游戏引擎,单GPU轻松运行800万步模拟,仅需3秒

-

OpenAI爬虫发布:GPT-5训练利器,可自由屏蔽

-

ChatGPT“幻觉”是否会褪去?

🪄魔法简报

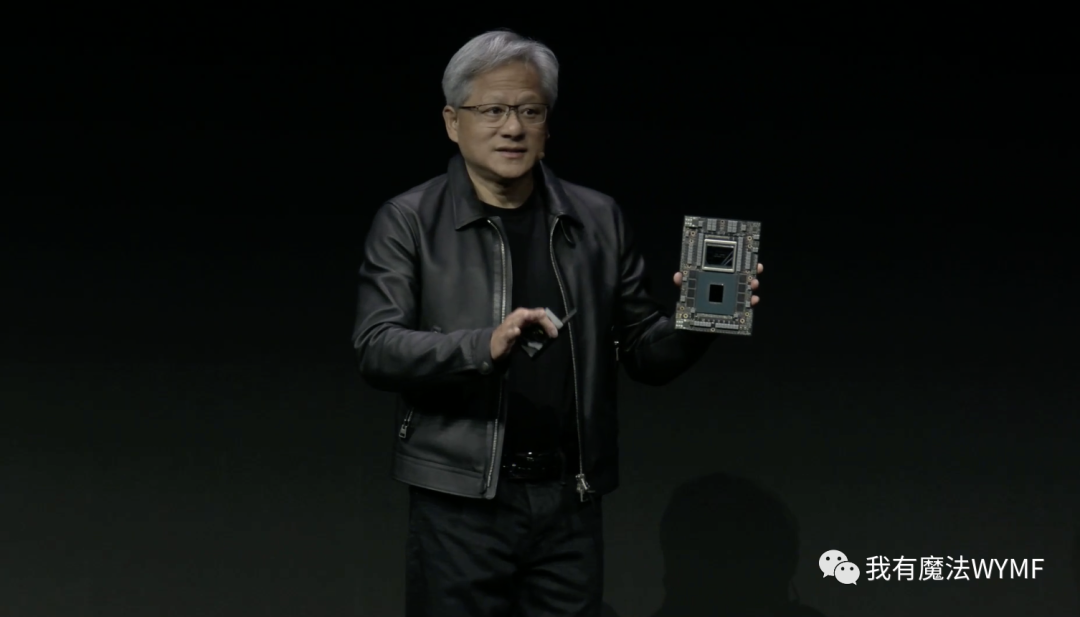

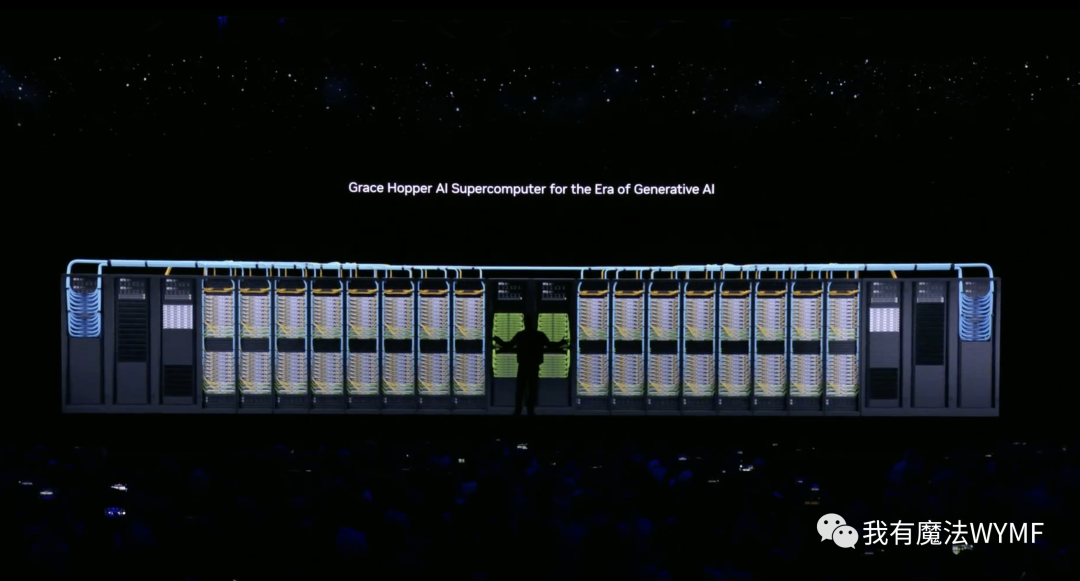

黄仁勋打造「核弹工厂」,让人人拥有创造力的 AI

在世界计算机图形会议上,英伟达创始人黄仁勋展示了用于生成式AI的GH200 Grace Hopper超级芯片以及其他相关产品,如NVIDIA AI Workbench和NVIDIA Omniverse。

他还宣布与AI开源社区Hugging Face合作,为开发者构建大型语言模型和AI应用提供支持。通过这些新的硬件和平台,黄仁勋希望普及生成式AI,并将其应用于各个领域。

此外,黄仁勋还介绍了OpenUSD联盟的成立,该联盟旨在推动生成式AI和3D技术的发展。黄仁勋强调,将生成式AI纳入工业生产和办公中是实现AI普惠的关键。

目前,英伟达的股价已经暴涨200%,显示出市场对其在生成式AI领域的领先地位的认可。总之,通过提供先进的硬件和平台,英伟达致力于推动生成式AI的发展和应用,为开发者和用户带来更多的机会和便利。

大模型背后的决胜关键:价值观、资金双重挑战

百川智能发布了最新的大模型baichuan-53B,参数量达到530亿。与之前的两个大模型不同,baichuan-53B不开源。

百川智能表示,他们的模型在中文开源模型中效果领先,并且在英文效果也不错。新模型具有较好的写作能力和博学的文科知识,其中一个重要原因是模型在底层应用了搜索能力。

另外,百川智能表示他们计划在年底发布一个面向消费者的超级应用。对于大模型行业整体状态,王小川认为钱很重要,但决定胜负的是人才团队。他还表示,中国的大模型行业还在分型复刻阶段,同质化问题是正常现象。而对于开源和闭源,他认为在B端市场,开源和闭源都有需求,不同场景有互补关系。关于百川智能的商业化计划,他表示他们会在商业化方向上开始开展工作,并且计划发布一个ToC的超级应用。?

快手TWIN:挖掘历史兴趣,入选KDD 2023

本文介绍了快手社区科学线自研论文《TWIN: TWo-stage Interest Network for Lifelong User Behavior Modeling in CTR Prediction at Kuaishou》被选为KDD 2023的应用数据科学领域论文。

该论文旨在解决传统的超长行为建模中的问题,提升超长行为建模的精准度。通过介绍行为序列建模方法的发展和现有两阶段建模方法存在的问题,提出了TWIN算法作为解决方案。TWIN算法通过一致的距离度量标准和注意力机制来提高超长行为建模模块的表现力,提高CTR预估的精准度。实验结果验证了TWIN算法的有效性。

斯坦福研发强劲游戏引擎,单GPU轻松运行800万步模拟,仅需3秒

斯坦福大学等机构的研究者开发了一款名为Madrona的强化学习游戏引擎,可以在单个GPU上并行运行数千个环境实例,并且以极高的吞吐量执行。该引擎可以大大减少智能体训练的时间,从数天缩短到几分钟。

该引擎使用了批量模拟的思想,在单个模拟器引擎内同时执行多个独立的环境。研究者通过该引擎实现了多个学习环境,并发现相较于使用CPU的基线,使用GPU的速度提升了两到三个数量级。这项研究的结果为进一步加速人工智能训练提供了新的可能性。

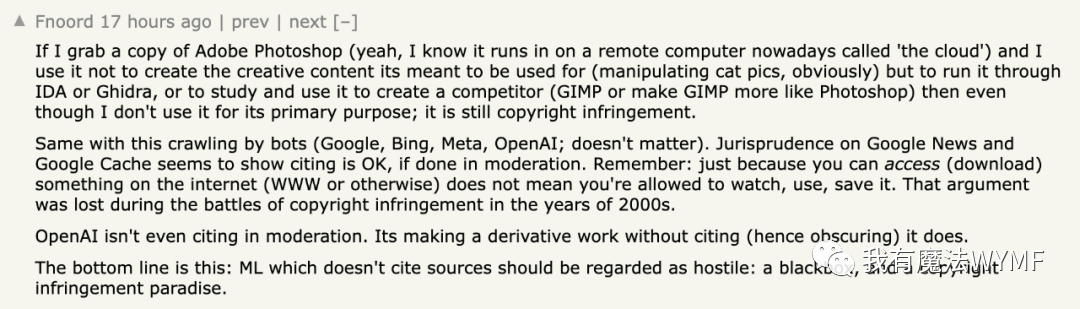

OpenAI爬虫发布:GPT-5训练利器,可自由屏蔽

OpenAI公布了名为GPTBot的官方爬虫,用于获取网络数据来训练GPT-4和GPT-5等AI模型。据OpenAI表示,爬取的内容不包括侵犯隐私和需要付费的内容。为了避免侵犯版权和保护隐私,网站所有者可以通过添加指定规则到robots.txt文件来控制GPTBot的访问权限。这一举动引发了关于使用公开数据训练AI模型的道德和合法性争议。

一些人认为使用公开数据来改进模型是合理的,但也有人担心数据的使用是否会侵犯版权和隐私。整个问题涉及到数据使用的所有权、合理使用和内容创建者的激励机制等复杂问题。最终,讨论焦点将转向AI产品使用数据的透明度和规范。

ChatGPT“幻觉”是否会褪去?

ChatGPT等人工智能聊天机器人在长时间交流中会产生幻觉现象,即快速说谎。这种现象已经引起了企业、机构和中学生等各个领域的关注。从心理治疗到研究和撰写法律摘要,有人将其用于可能产生严重后果的任务上。

Anthropic的联合创始人兼总裁丹妮拉·阿莫代表示,“我认为,如今没有一种模型不会产生幻觉。”Anthropic、OpenAI和其他主要开发商正在努力提高这些模型的准确性。然而,这需要一段时间来观察,看它们是否能够准确无误地提供医疗建议。语言学教授艾米丽·本德表示:“这是无法解决的,是技术与拟议用例不匹配的通病。

作为OpenAI的合作伙伴之一,美联社也在探索使用这项技术,而OpenAI正在付费使用美联社的部分存档文本来改进其人工智能系统。计算机科学家加内什·巴格拉与印度的酒店管理机构合作多年,一直致力于让人工智能系统(包括ChatGPT)创新南亚菜肴,如新颖的印度比什尼(以米饭为主)。某种“引起幻觉”的配料可能决定了菜肴的美味。

今年6月,在访问印度时,OpenAI首席执行官山姆·奥特曼遭到了印度信息技术研究所(IIT Delhi)的教授的质询,他们提出了一些尖锐的问题。巴格拉对奥特曼说:“我认为ChatGPT产生幻觉仍然可以接受,但当食谱出现幻觉时,问题就严重了。”奥特曼在这所美国科技领导之地回答道:“你如何看待这个问题?”巴格拉笑着在他所在的大学里对听众说:“我可能是全世界最不相信ChatGPT给出答案的人了。

如果对AIGC感兴趣,请关注我们的微信公众号“我有魔法WYMF”,我们会定期分享AIGC最新资讯和经典论文精读分享,让我们一起交流学习!!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:veading@qq.com进行投诉反馈,一经查实,立即删除!