实习生笔记-ChatGPT入门扫盲

前言

在古典老师的204年跨年演讲里,再次说明了AI对现在有创意的工作者的挤压。明白地说,取代工作者的不是AI,而是会借助AI完成生产力跃迁的另一些工作者。“降本增效”,是要做”本“还是”效“,取决于行动。我在工作中常使用ChatGPT,平时的课设、文稿等都会借助于它,而对它的了解,我扪心自问还是不够的,所以我在极客时间看了李佳芮老师的公开课进行学习,总的时间不算长,以下是一些笔记。

GPT逐字解释

GPT的全称是Generative Pre-trained Transformer。直译为?成式 预训练 变换模型。

生成式,简单说就是输入后可以输出新的内容,这不同于搜索引擎,百度之后找到的是网页答案,生成式相当于回答这个问题。

P是预训练,简单说就是这个模型不用自己训练,拿来即可用。用专业术语来说,预训练是指在大规模数据集上进行无监督学习,学习到一些通用的特征或知识,并将这些特征或知识迁移到其他任务上,用于增强模型的泛化能力和表现。

T是变换模型,拿中英文互译来说,输入中文机器翻译,通过变换模型就能输出:machine translation。可以看做一个黑盒。用专业术语说,变换模型是一种自注意力机制的神经网络结构。

监督学习/无监督学习/强化学习

| 监督学习 | 无监督学习 | 强化学习 |

|---|---|---|

| 有标签数据 | 无标签/目标 | 决策过程 |

| 直接反馈 | 无反馈 | 奖励机制 |

| 预测结果/未来 | 寻找数据中隐藏的结构 | 学习一系列行动 |

什么是注意力机制

以下是ChatGPT用通俗易懂的语言来解释的。

在变换模型(就是我所属的模型)中,注意力机制就像是你在做作业时专心看老师讲解的内容一样。当你在解决一个问题时,有些部分可能更重要,你会更专注在这些部分。在变换模型中,注意力机制就是让模型能够专注于输入中的不同部分,以便更好地理解和处理信息。这样就可以更好地完成任务,就像你专心听老师讲解一样。

ChatGPT是猜概率游戏?

现阶段所有的 NLP 任务,都不意味着机器真正理解这个世界,它只是在玩?字游戏,进??次??次的概率解谜,本质上和我们玩报纸上的填字游戏是?个逻辑。只是我们靠知识和智慧,AI 靠概率计算。

?在?前的“猜概率”游戏环境下,基于?型语?模型(LLM,Large Language Model)演进出了最主流的两个?向: 即 BERT 和 GPT。 其中 BERT 是之前最流?的?向,?乎统治了所有 NLP 领域,并在?然语?理解类任务中发挥出?(例如?本分类、情感倾向判断 等)。 ? GPT ?向则较为薄弱,最知名的玩家就是 OpenAI 了,事实上在 GPT3.0 发布前,GPT ?向?直是弱于 BERT 的(GPT3.0 是 ChatGPT 背后模型 GPT3.5 的前身)。

| BERT | GPT |

|---|---|

| 双向语言模型 | 单向语言模型 |

| 猜中间的字,就像完形填空 | 猜下一个字,就像写作文 |

| 我_20号回家 | 我打算20号_ |

Fine-tuning VS Prompt

GPT-3 的论?定义:如果需要对模型参数进?更新,基于梯度下降为主的算法对模型进?更新,就是 Fine-tuning。

如果不需要修改模型和参数,只要给模型?些提示和样例,就让模型符合我们的要求完成?些任务就叫 in-context learning,后??家开始叫 Prompt。

ChatGPT既可以使用fine-tuning(相关的API),也可以使用prompt,后者居多。后者比前者简单。

Zero-shot prompt VS Few-shot prompt

字面意思就可以看出来区别,前者是给少量关键字,后者是给关键字加上相关的事实描述。ChatGPT两种都支持,前者正是它惊艳世人之处。比如让它写一首诗歌,它能直接写出来,这就是前者。让它写一首诗歌,还要告诉它诗歌的一些特点,结构特征、遣词造句规律等,它才写出来,这就是后者。

Prompt的结构

好的prompt等于清晰的任务描述+足够的样例。

ChatGPT的前世今生

之前分析型AI大行其道,应用比如抖音,分析偏好后推送,实现“信息找人”。如今生成式AI如火如荼,应用比如说AI绘画,ChatGPT。生成式AI包括文本、代码、图片、音视频等。ChatGPT就属于文本类型的。

早起的聊天机器人,要给出内容分类,意图和提示词,才能出答案。ChatGPT是基于大语言模型+prompting的通用人工智能,意味着很多中间任务的消亡。

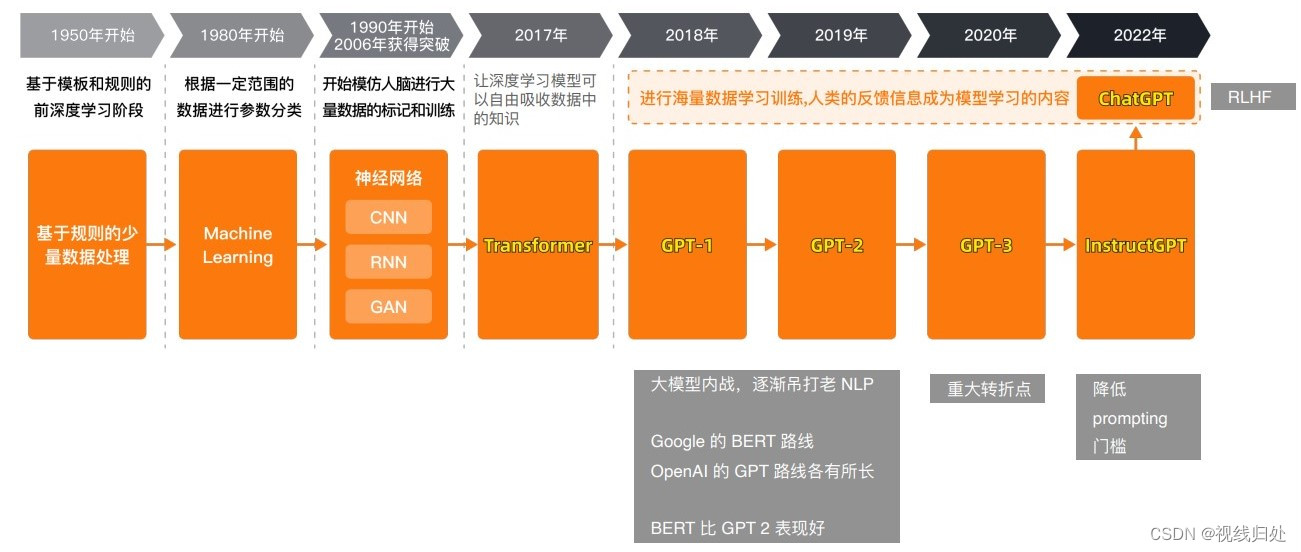

技术路线

RLHF算法

简单说就是训练模型生成的内容更加受人类喜欢。

RLHF算法是一种用于解决复杂问题的算法。它的全称是Reinforcement Learning with Human Feedback,意思是通过人类的反馈来进行强化学习。简单来说,就是让计算机通过不断地尝试和得到人类的指导,来学习如何解决问题。就像小朋友在学习做数学题一样,一开始可能会犯错误,但通过老师的指导和不断的练习,就能越来越好地解决问题。RLHF算法就是通过这种方式让计算机学习如何更好地解决问题。

OpenAI

OpenAI是一家人工智能研究实验室,成立于2015年,总部位于美国加州。该公司旨在推动人工智能的发展,并且致力于开发和推广开放、安全和利于人类的人工智能技术。OpenAI的研究团队致力于开发先进的人工智能技术,并且在人工智能领域进行了许多重要的研究和创新。该公司也是一些知名人工智能项目的发起者和支持者,例如GPT-3和OpenAI Gym等。OpenAI的目标是通过开放合作和研究,为全球社会带来更加智能和有益的人工智能技术。

OpenAI的联合创始人和董事会成员包括伊隆·马斯克(Elon Musk)、萨姆·阿尔特曼(Sam Altman)、格雷格·布洛克曼(Greg Brockman)等。

ChatGPT的应用场景

以下是ChatGPT(GPT-3.5)的一些可能应用场景:

智能聊天机器人

语言翻译

文本摘要

内容生成

情感分析

客户服务支持

问答系统

信息检索

虚拟助手

个性化推荐系统

自动文档生成

编程辅助

医疗咨询

技术支持

写作辅助工具

语言学习支持

艺术创作

情感对话系统

金融分析

娱乐和游戏

智能广告推荐

新闻摘要

电子邮件自动回复

人际关系辅助

产品推荐

自动化写作

营销内容生成

情感支持和心理咨询

法律文件起草

旅行建议

餐饮推荐

个性化新闻推送

人才招聘

职业规划建议

情感日记

社交媒体自动回复

个性化健身计划

自动化代码生成

情感诗歌生成

虚拟情感宠物

语音助手

语言辅助治疗

情感音乐生成

职业技能培训

情感小说创作

智能家居控制

情感日程安排

个性化电影推荐

情感绘画生成

情感教育辅导

这些仅仅是ChatGPT可能的应用场景的一部分,它的潜在应用领域非常广泛。

写提示词prompt

1、适当的提示可以引导模型生成有用的输出。

2、用多种方式表达以达到最佳结果。

3、描述具体的事情并给出相关的背景信息

4、想模型展示你希望看到的内容,引导模型生成你想要的输出。

以我的经验来看,写提示词语的套路:预设角色,要做什么,怎么做,做成什么样/不做成什么样。

比如说:假如你是一名Java开发工程师,现在要设计一个面向大学生的图书管理系统,要做基本的数据表设计,你要做出来结构合理的、冗余度低的设计,使用MySQL数据库表的建表语句进行创建。

写提示词能力的提升,还是那句话,“我亦无他,唯手熟尔”。

工具FlowGPT

学习如何写提示词的。

后记

借助AI这项工具,能让我们做事情的效率大大提高,值得充分了解并花时间实践。

莫道桑榆晚,为霞尚满天。

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:veading@qq.com进行投诉反馈,一经查实,立即删除!