GRU算法

2024-01-02 05:52:07

前置知识:RNN,LSTM

LSTM需要训练的参数很多,极消耗计算资源。GRU是一种LSTM的改进算法,参数更少,更容易训练。

它将忘记门和输入门合并成为一个单一的更新门,同时合并了数据单元状态和隐藏状态,使得模型结构比之于LSTM更为简单。

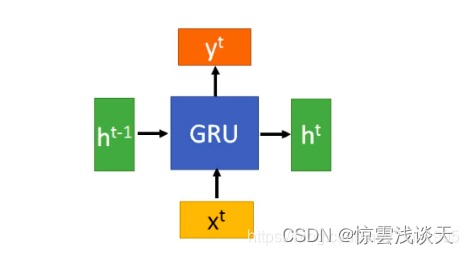

结构

GRU的整体结构图与RNN没有区别

reset重置门

rt就是重置门,得到rt后,将rt与上一时刻传入的ht-1进行点乘,得到重置之后的数据,并与xt进行拼接。

h'包含了输入信息xt,经过选择后的上一时刻的信息h't-1,

update更新门

-

z*ht-1:表示对隐藏状态选择性的遗忘;

-

(1-z)*h':表示对包含当前节点信息的h'选择性的记忆

文章来源:https://blog.csdn.net/lty1392309506/article/details/135329813

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:veading@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:veading@qq.com进行投诉反馈,一经查实,立即删除!