书生·浦语大模型--第一节课

2024-01-09 20:34:56

目标:掌握大语言模型开发和应用技能

引言

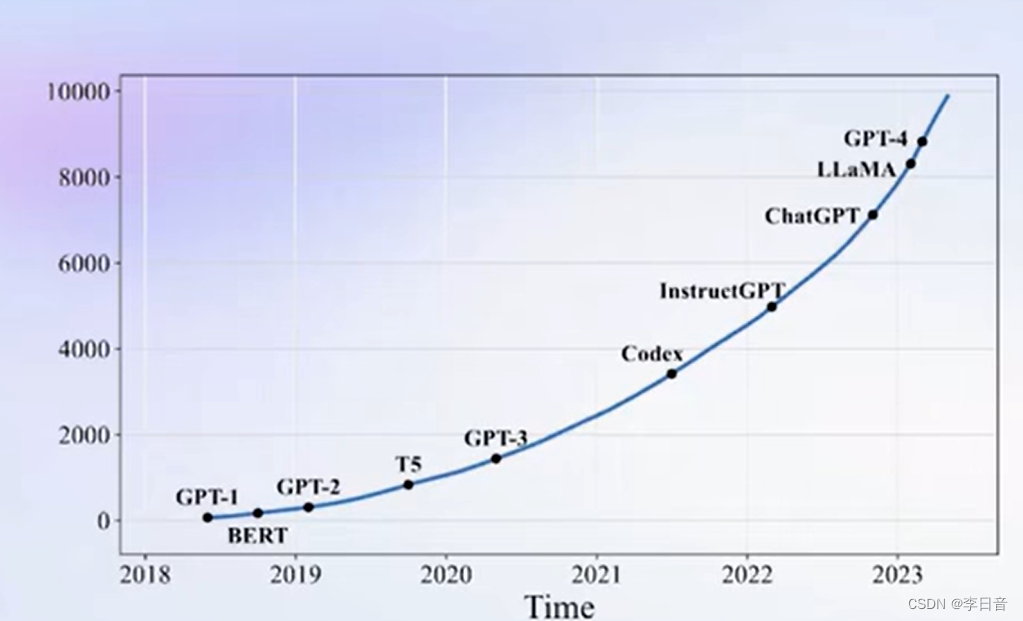

大语言模型成为学术界和工业界的热门话题。

起源于2018年的GPT-1。

大模型是发展通用人工智能的重要途径,可以应对多任务、多模态。

书生·浦语大模型

发展历程

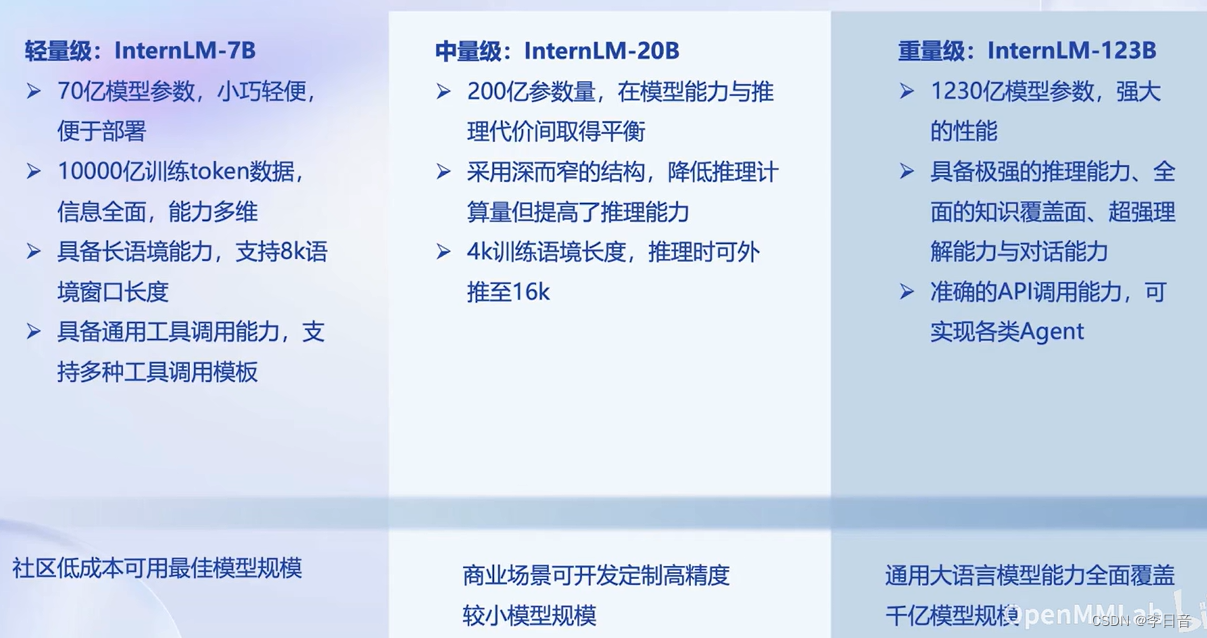

覆盖轻量级、中量级、重量级的应用。7B、20B已开源可用

20B性能比较,值得一提的是参数量小,可以达到Llama2-70B水平

大模型的应用

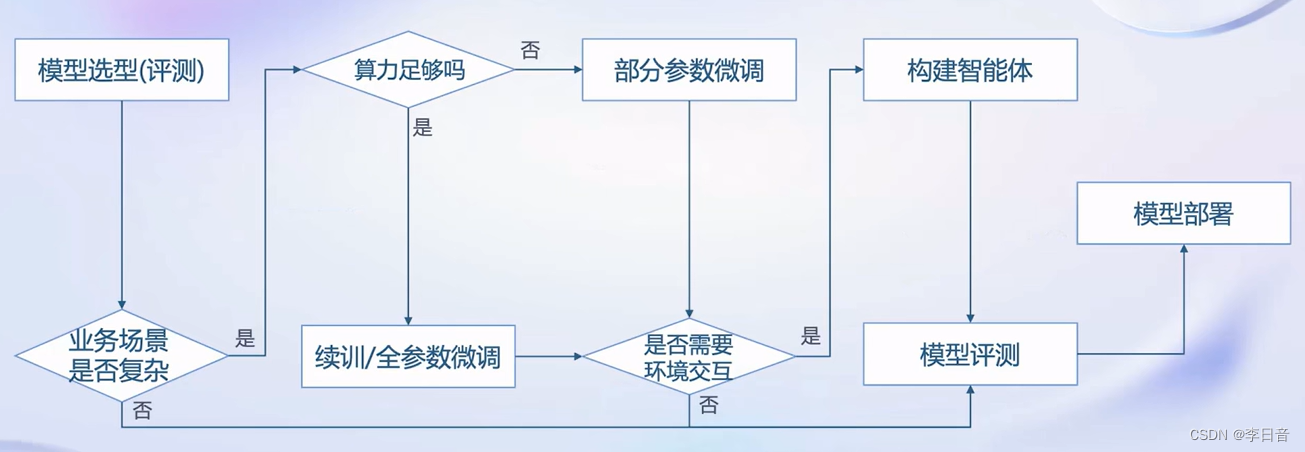

需要考虑业务场景、算力、环境交互的因素

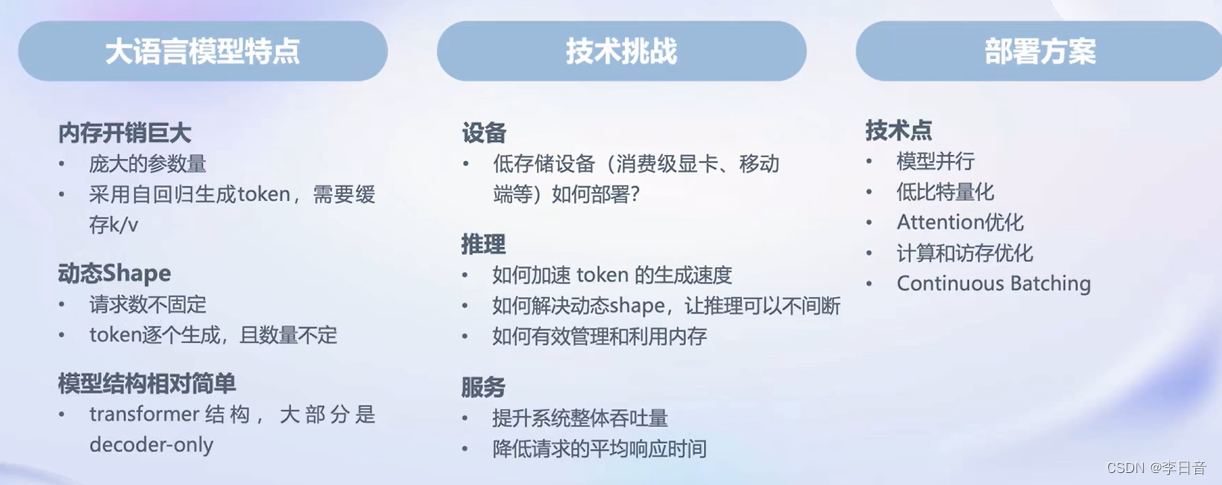

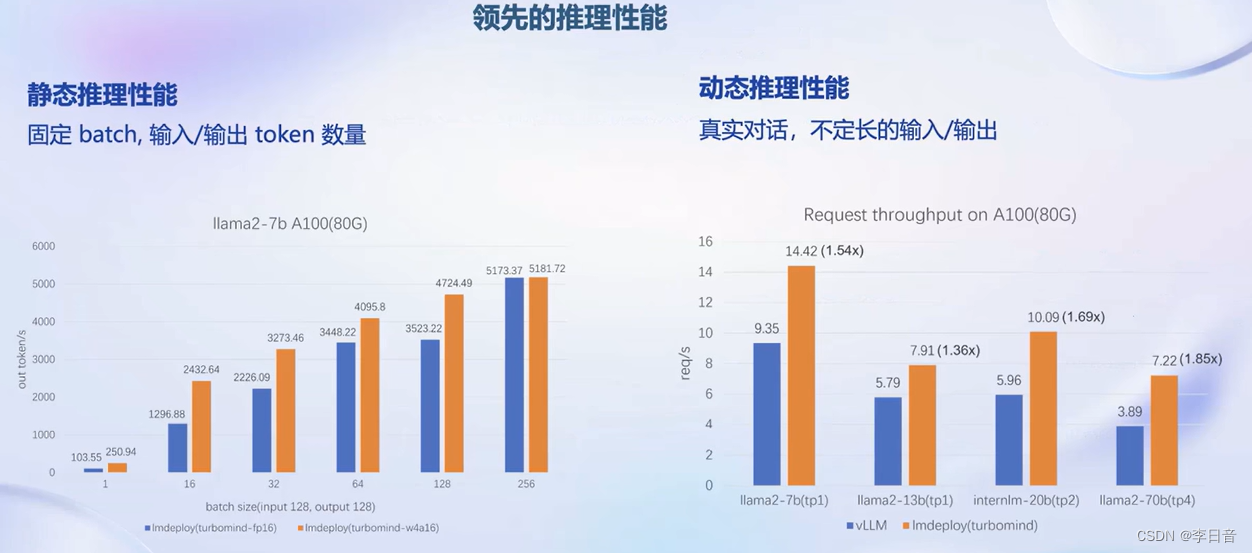

模型部署:更少的资源、提升吞吐量

全链条开放体系

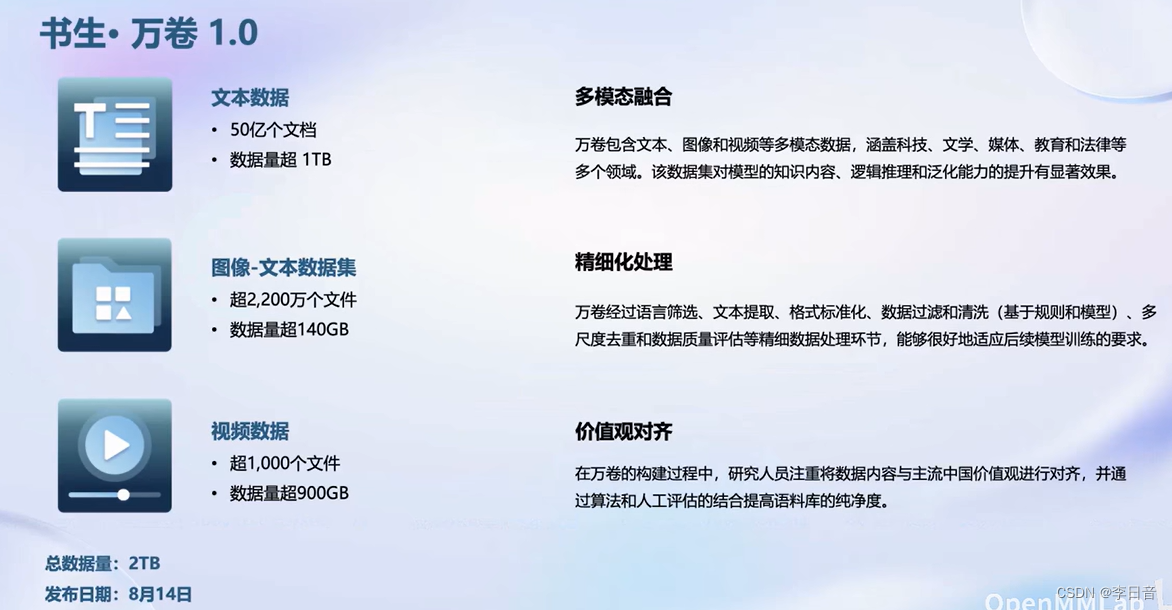

数据开源

涵盖不同领域,包含积累的技术和数据。对齐中国主流价值观

开放的数据平台

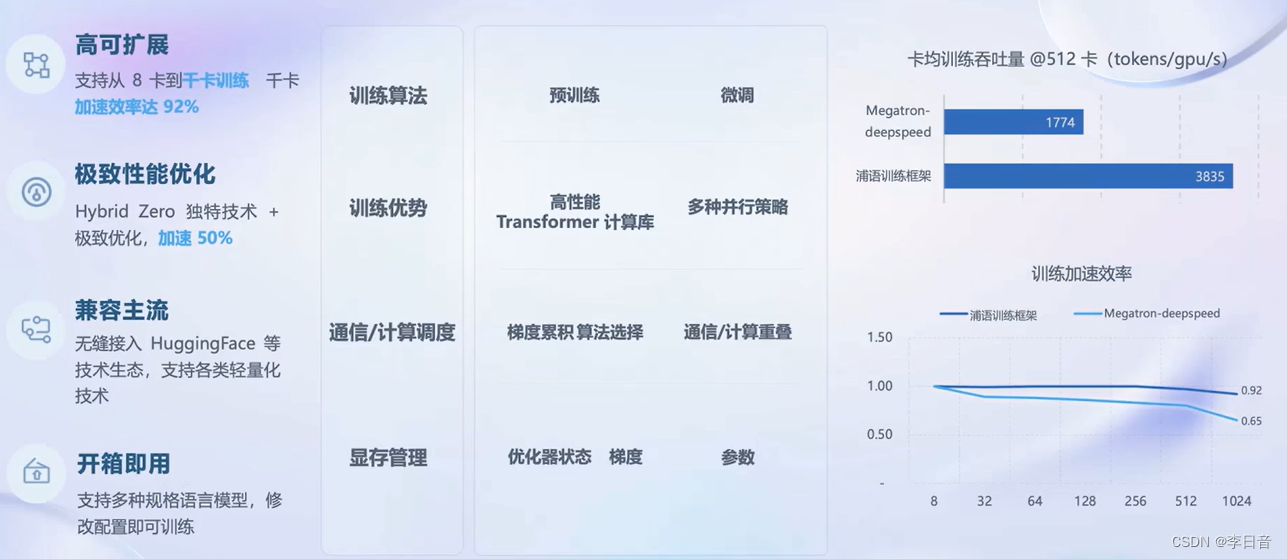

预训练工具

微调

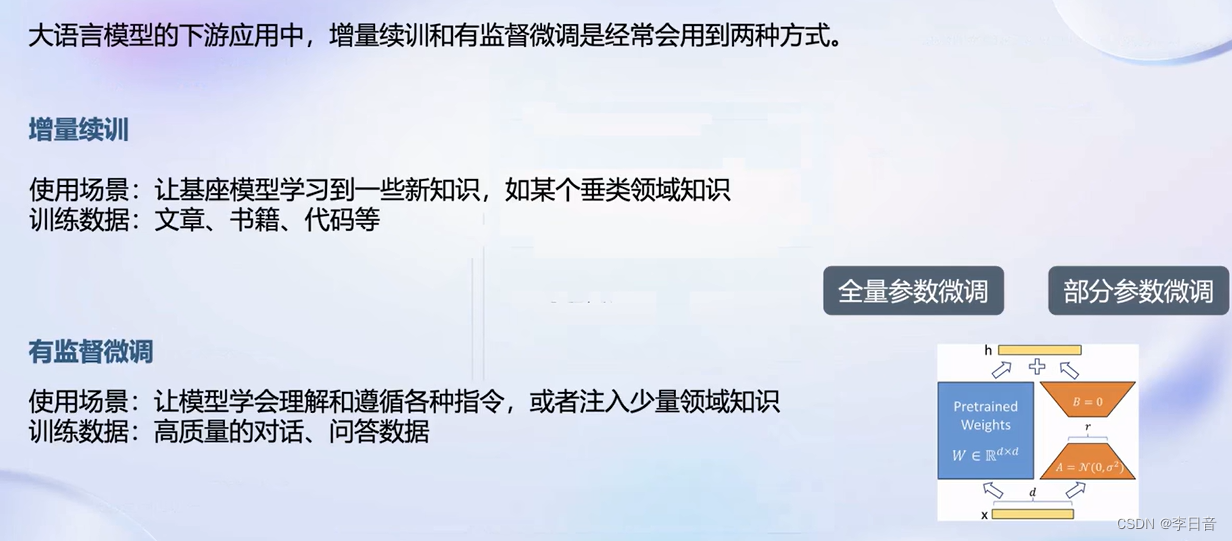

增量续训和有监督微调。

增量续训:垂直领域、文章、数据、代码

有监督微调:数据量更少

微调框架

只需要8G显存即可训练。第一个可以做到8G显卡训练。

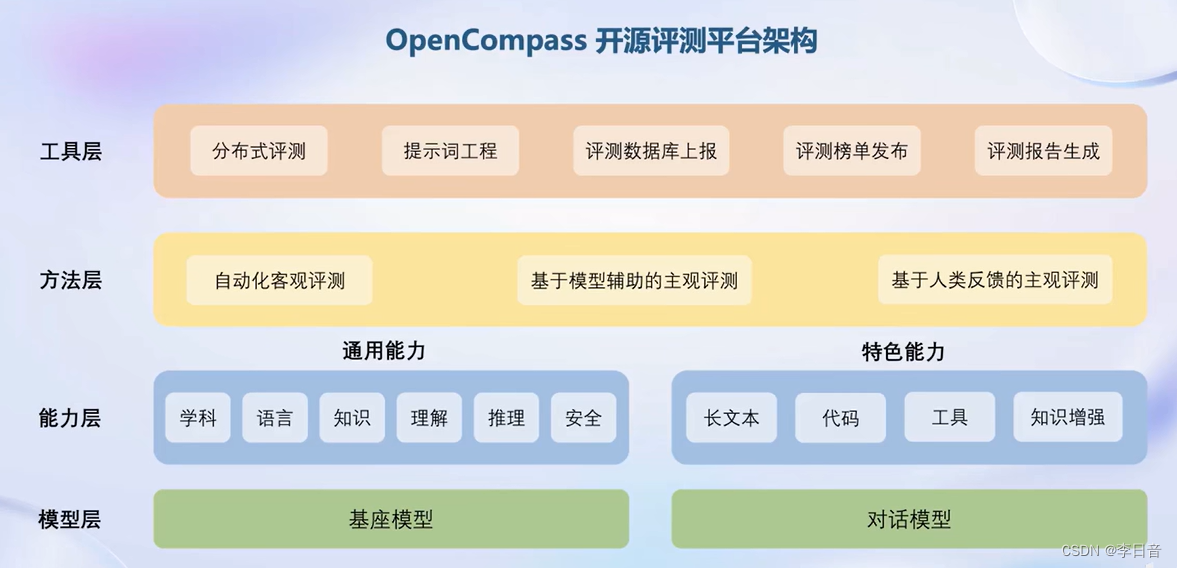

评测工具

主要还是考试做题,全面性不够

大维度评测,更全面

评测架构

优势:

部署:

参数巨大、内存开销

开源部署框架:全流程解决方案

性能

智能体应用

局限性:

- 最新信息和知识的获取

- 回复的可靠性

- 数学计算

- 工具使用和交互

框架

工具箱

提供工具集合

总结

参考链接

文章来源:https://blog.csdn.net/lalala12ll/article/details/135487885

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:veading@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:veading@qq.com进行投诉反馈,一经查实,立即删除!