深度学习记录--激活函数

2023-12-13 04:26:54

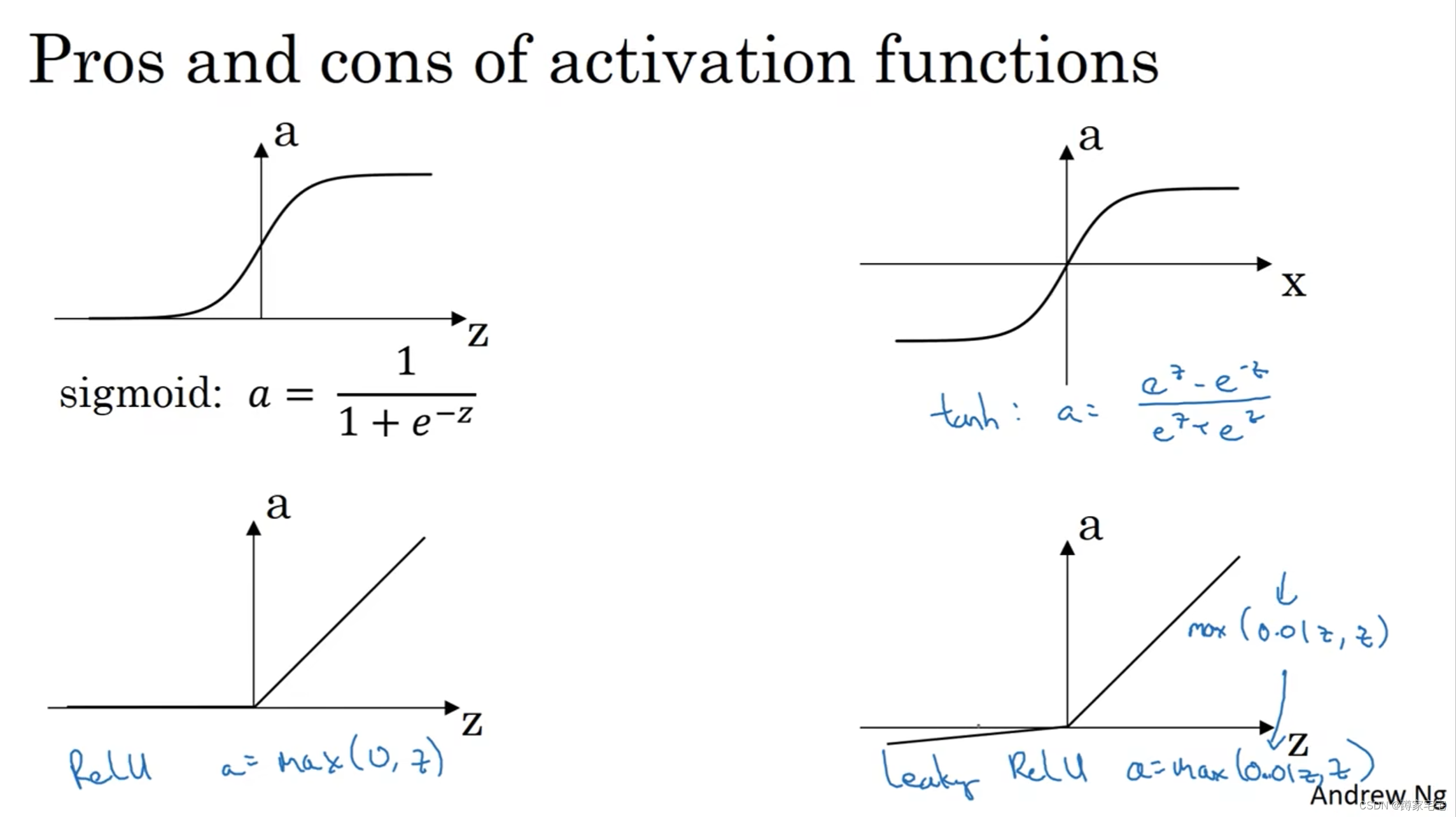

激活函数的种类

对于激活函数的选择,通常有以下几种

sigmoid,tanh,ReLU,leaky ReLU

激活函数的选择

激活函数的选择

之前logistic回归一直使用的激活函数都是sigmoid函数,但一般来说,tanh函数是比sigmoid函数更加好的选择

tanh函数会将预测值稳定在0值上下(数据中心化),而sigmoid函数输出值在0-1间变化,数据中心化对于往后的迭代更加方便

但无论是sigmoid函数,还是tanh函数,都有很明显的缺点,当z很大或者很小,a的斜率将会趋于0,这将导致学习迭代的速率大大下降

所以ReLU(rectified linear unit)--修正线性单元,是更好的选择,它保持斜率为1(当z大于0时),当z小于0时,斜率为0

对于负区间的改进,leaky ReLU在负区间的斜率变为k(k为学习率)

一般来说,没有固定的激活函数选择,要根据模型选择,比如对于二元分类,sigmoid函数反而更加常用(因为在0-1区间),只是通常ReLU会更加方便一点

为什么需要非线性的激活函数

如果使用线性激活函数或者不使用激活函数,那么神经网络实际上只是在计算线性激活函数,隐藏层也没有必要了,更详细的解释之后补充

文章来源:https://blog.csdn.net/Xudong_12345/article/details/134894425

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:veading@qq.com进行投诉反馈,一经查实,立即删除!

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。 如若内容造成侵权/违法违规/事实不符,请联系我的编程经验分享网邮箱:veading@qq.com进行投诉反馈,一经查实,立即删除!